Illustration: Marcelle Louw for GIJN

Recursos Guía

Guía para periodistas que investigan salud y medicina

Recursos Guía Capítulo

Guía de GIJN sobre investigación periodística en salud y medicina – Prefacio

Recursos Guía Capítulo

Guía de GIJN sobre investigación periodística en salud y medicina: Capítulo 1

Recursos Guía Capítulo

Guía de GIJN sobre investigación periodística en salud y medicina: Capítulo 2

Recursos Guía Capítulo

Guía de GIJN sobre investigación periodística en salud y medicina: Capítulo 3

Recursos Guía Capítulo

Guía de GIJN sobre investigación periodística en salud y medicina: Capítulo 4

Recursos Guía Capítulo

Guía de GIJN sobre investigación periodística en salud y medicina: Capítulo 5

Recursos Guía Capítulo

Guía de GIJN sobre investigación periodística en salud y medicina: Apéndice

Un estudio no es solo un estudio. Aclara tus números.

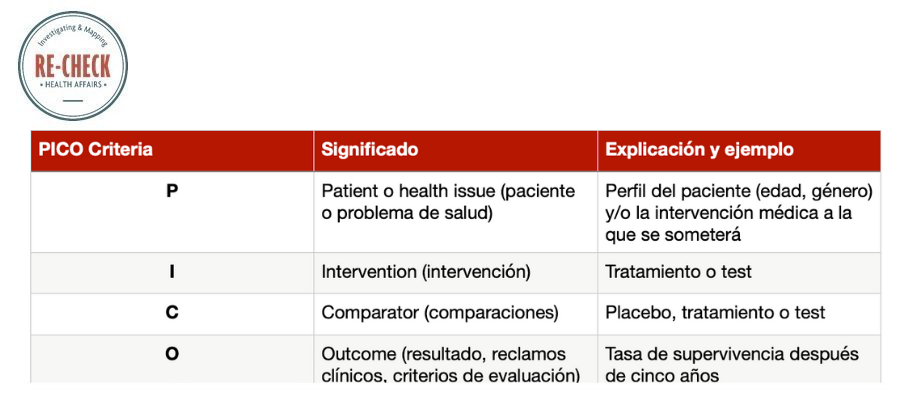

Primera sugerencia: utiliza la medicina basada en la evidencia (MBE) y los criterios PICO

Como dijimos en la introducción, usar la medicina basada en evidencia (MBE) – definida como “el uso escrupuloso, explícito y sensato de la mejor evidencia en la toma de decisiones sobre el cuidado de los pacientes”– supone un método de investigación que puede ser costoso, pero altamente efectivo.

Los métodos de la MBE son una buena forma de cuestionar lo que escuchas y oyes, buscar la mejor evidencia disponible y evaluar la calidad de manera independiente. Algunos de los principios de la MBE pueden ser muy eficaces en la investigación, como aplicar la valoración crítica (en inglés critical appraisal) y adaptar los criterios PICO a las publicaciones.

La MBE propone que para realizar una investigación en la literatura y analizar la relación riesgo-beneficio, las preguntas clínicas se pueden dividir en cuatro dimensiones usando los criterios PICO. Esta metodología ayuda a observar si faltan datos o son erróneos, por ejemplo: si un comparador es inadecuado o si un resultado ha sido mencionado con anterioridad.

Segunda sugerencia: un estudio no es sólo un estudio

“Un estudio ha mostrado…” pero, ¿qué tipo de estudio fue? El autor Gary Schwitzer, en su guía esencial Covering Medical Research, afirma: “No todos los estudios son iguales. Y no deberían ser tratados como si lo fueran”. Ser consciente de esto puede suponer una gran diferencia en la investigación. Si el trabajo está basado en una débil evidencia científica, no se obtendrá un estudio sólido y es alta la posibilidad de que existan fallos.

Para trabajar como investigador en el área de salud y medicina, es importante notar que los defectos metodológicos suelen ser una señal de que hay que profundizar en el análisis. La curva de aprendizaje suele ser difícil, pero se puede empezar revisando una amplia gama de estudios, tal como se sugiere en el artículo Tipos de estudios en investigación médica: parte 3 de una serie sobre evaluación de publicaciones científicas (Types of Study in Medical Research: Part 3 of a Series on Evaluation of Scientific Publications), publicado durante 2009 en la revista Deutches Ärteblatt International.

Comprender las diferencias entre los distintos tipos de estudios ayuda a evitar muchos errores. En pocas palabras, debes hacer dos grandes preguntas:

La primera: ¿es un estudio efectuado en humanos?, o ¿está realizado en animales o en células? La investigación con humanos se llama investigación clínica. Cuando se trata de evaluar el efecto de un fármaco o una medida sanitaria, los únicos resultados verdaderamente significativos se obtienen a través de humanos.

Los tanteos en ratones pueden ser interesantes, pero es especulativa cualquier conclusión sobre la eficacia de un tratamiento en humanos extraído de animales. En este caso, los estudios se encuentran en la denominada etapa “preclínica” de desarrollo de un nuevo fármaco. Hay que recordar que, a lo largo de la historia de la medicina, ha habido muchos medicamentos que parecían muy prometedores cuando se probaron en animales, pero que tuvieron que ser retirados cuando se hizo evidente que eran ineficaces o incluso tóxicos para humanos.

Si el estudio se ha realizado en humanos, debes preguntarte la segunda cuestión importante: ¿fue un ensayo experimental (también llamado intervencionista) o epidemiológico (conocido como observacional)?

Sobre este tema, Health News Review refiere lo siguiente: “con los estudios epidemiológicos/observacionales se analiza la asociación entre lo que es conocido en la jerga epidemiológica como una exposición (una comida, un fármaco, algún factor ambiental o de comportamiento) y el resultado (normalmente una enfermedad o la muerte). Las exposiciones que ocurren de forma simultánea en las complejas vidas de los humanos nunca se pueden explicar por completo, por lo que dichos estudios no pueden proporcionar evidencia sobre las causas y los efectos; solamente pueden proporcionar evidencia de algunas relaciones (entre exposición y resultado) que un diseño más sólido podría explorar”.

En un estudio experimental, los investigadores en cambio pueden demostrar si la intervención A (por ejemplo, un fármaco o una vacuna) conduce al resultado B (por ejemplo, una cura o prevención de una enfermedad).

Entre los estudios experimentales, el único diseño que puede demostrar la relación entre una causa y un efecto es el del ensayo clínico aleatorizado (ECA o en inglés RCT, de randomized controlled trial), donde los sujetos del estudio son asignados de forma aleatoria a una intervención (una vacuna o un fármaco, un consejo) o a un control (un placebo, otro fármaco, entre otros).

La aleatorización hace que ambos grupos sean comparables: la única diferencia entre el grupo de intervención y el de control es si los participantes han recibido la intervención del estudio o del control. Esta configuración nos permite concluir que la diferencia del resultado entre el grupo de intervención y el grupo de control es probablemente atribuible al fármaco, vacuna o intervención ensayado.

Los ensayos clínicos aleatorizados multicéntricos se realizan en varios lugares al mismo tiempo, como hospitales, poblaciones, entre otros. Los ensayos pueden ser simple enmascarado (los sujetos de estudio no saben si participan en el grupo control o placebo, pues la intervención es de apariencia similar), doble enmascarado (ni los participantes ni los investigadores saben quién pertenece a qué grupo) o triple enmascarado (quien analiza los datos tampoco sabe quién pertenece a qué grupo).

Al respecto, Health News Review concluye: “puesto que en los estudios observacionales (no aleatorizados) no se pueden controlar todas las variables y factores, normalmente inconmensurables, que podrían influir en los resultados, cualquier relación entre la causa y el efecto en los estudios observacionales es especulativa, en el mejor de los casos”.

Por tanto, ten cuidado: en ninguna circunstancia los estudios observacionales llevan a una conclusión sobre la eficacia de una medida, incluso cuando se establezca una asociación estadísticamente significativa. Solo un estudio experimental, tipo ECA, puede establecer si existe una relación causal entre la intervención estudiada y el efecto observado.

También debes tener en cuenta que los estudios observacionales son más fáciles de manipular. La estadística puede usarse por los investigadores o los patrocinadores para modificar los resultados. De modo que cuando se analizan los números, se debe tener en cuenta lo que Darrel Duff, mejor conocido por su libro How to Lie with Statistics, escribió en 1954: “La estadística puede sacar del sombrero casi cualquier cosa que se desee”. Ronald H. Coase, Premio Nobel de Economía de 1991, sentenció: “Si torturas los datos durante mucho tiempo, terminarán confesando”.

Los ensayos multicéntricos doble enmascarado son considerados el patrón oro para determinar la eficacia de una intervención. Este diseño es superior en el control de parámetros, que pueden distorsionar los resultados (los llamados factores de confusión y sesgos). Dos fuentes valiosas para aprender estos principios son: Students 4 Best Evidence y Types of Clinical Study Designs de la Universidad de Georgia.

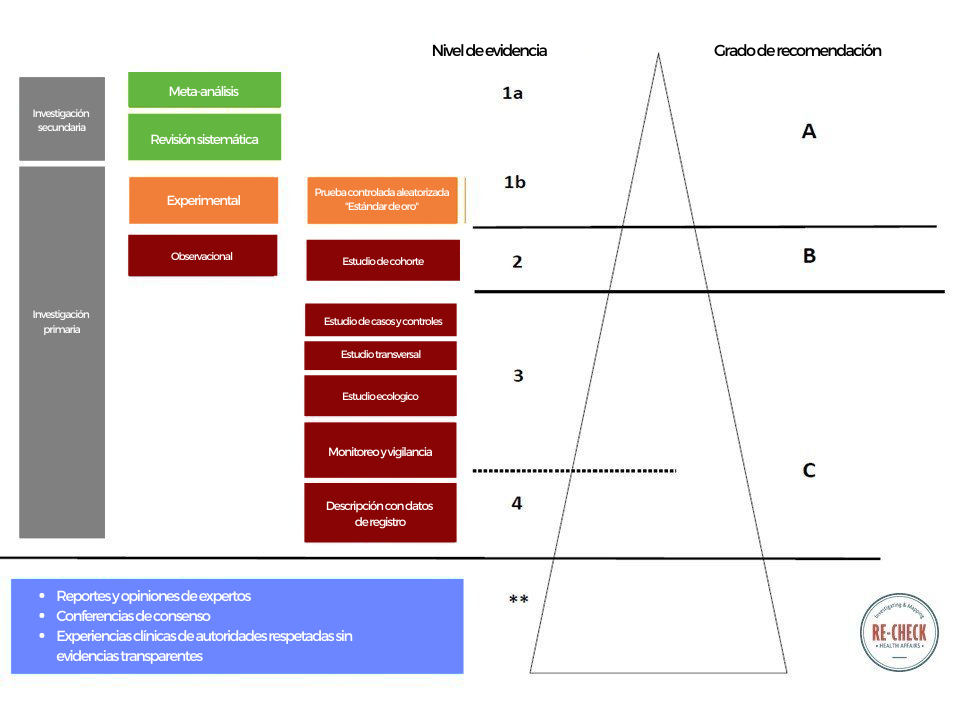

La ilustración de abajo muestra las mejores prácticas para evaluar la fuerza de evidencia. Toma en cuenta que la opinión de los expertos está en la base de la pirámide.

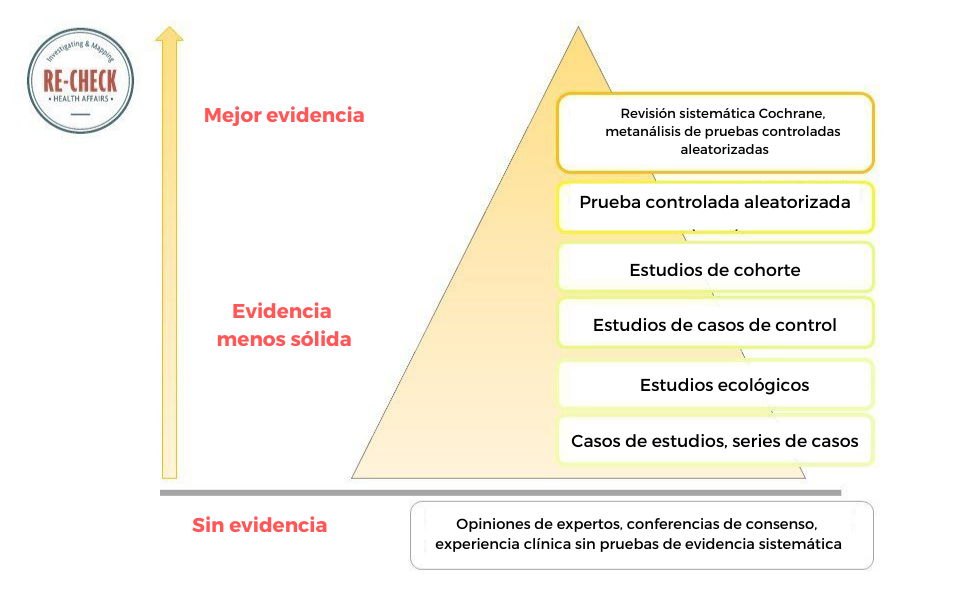

Aquí puedes ver una versión más simple:

Recuerda que esta pirámide es también cuestionable. Los ensayos clínicos aleatorizados producen las pruebas más sólidas respecto a relaciones causales y la síntesis de varios, y el meta-análisis genera la evidencia más segura. Pero pueden tener problemas y no ser fiables. Algunos meta-análisis tipo Cochrane concluyen con “no hay conclusión definitiva”, lo que es muy frustrante para los periodistas.

Dar noticias sobre salud también significa hacer que se conozcan los defectos en los ensayos clínicos. Por lo general, se publican aquellos que muestran un resultado con la “significación estadística positiva” deseada, pero no ocurre igual con los estudios “negativos”. Algunas evaluaciones son más proclives a los sesgos, que, según el Manual Cochrane, se definen como “errores sistemáticos o una desviación de la verdad en los resultados”. Un recurso útil para entender esta materia es el Catálogo de sesgos, un proyecto colaborativo que cartografia los errores que afectan a la investigación en salud.

Una falla típica de los periodistas es confundir correlación con causalidad. Es tentador ver una correlación entre dos fenómenos, pero primero debe preguntarse si esa relación es causal. El matemático Robert Mattews dio un divertido ejemplo al demostrar en Europa una alta y significativa correlación estadística entre la población de cigüeñas y las tasas de nacimientos humanos.

Pocos son conscientes de las fraudulentas prácticas que a veces ocurren en el campo de los estudios de salud. Hay investigaciones basadas en pacientes que no existen o registrados por escritores “fantasma”. Hay mucha literatura sobre estas prácticas y vale la pena que nos familiaricemos con ella.

Por ejemplo, habría que leer Retraction Watch, el estudio realizado por un investigador de cáncer fallecido y galardonado que se retracta porque algunos pacientes fueron «inventados» (Retraction Watch, Study by Deceased Award-Winning Cancer Researcher Retracted Because Some Patients Were ‘Invented,’) y los ejemplos revelados por Ivan Oransky en su entrevista con The Irish Times: “Los oscuros callejones de la publicación científica” (The shady backstreets of scientific publishing).

El error más común de la mayoría de los periodistas es llegar a conclusiones erróneas a partir de una débil evidencia científica. Para evitarlo te sugerimos hacer el curso virtual (online) gratuito en inglés del Eberly College of Science de la Universidad del Estado de Pennsylvania: Métodos de Investigación Epidemiológica.

Tercera sugerencia: valores absolutos y frecuencias naturales

No todo el mundo es experto en estadística. Sin embargo, los números son clave en cualquier investigación sobre salud. No temas valorar tu analfabetismo estadístico (test disponible en inglés, alemán, francés, holandés y español) y mantén en mente que se pone el foco en los beneficios cuando se lanza o promueve un nuevo fármaco, política o intervención sanitaria. Sin embargo, también deberíamos mencionar los riesgos de la ecuación.

Es necesario comprender la relación entre beneficio y riesgo y esto no es algo sencillo. Nuestra capacidad de razonar está gobernada por el pensamiento “heurístico”, lo que da como resultado una racionalidad limitada. A causa de estos fenómenos bien estudiados, tendemos a tener problemas con las probabilidades, especialmente con los porcentajes.

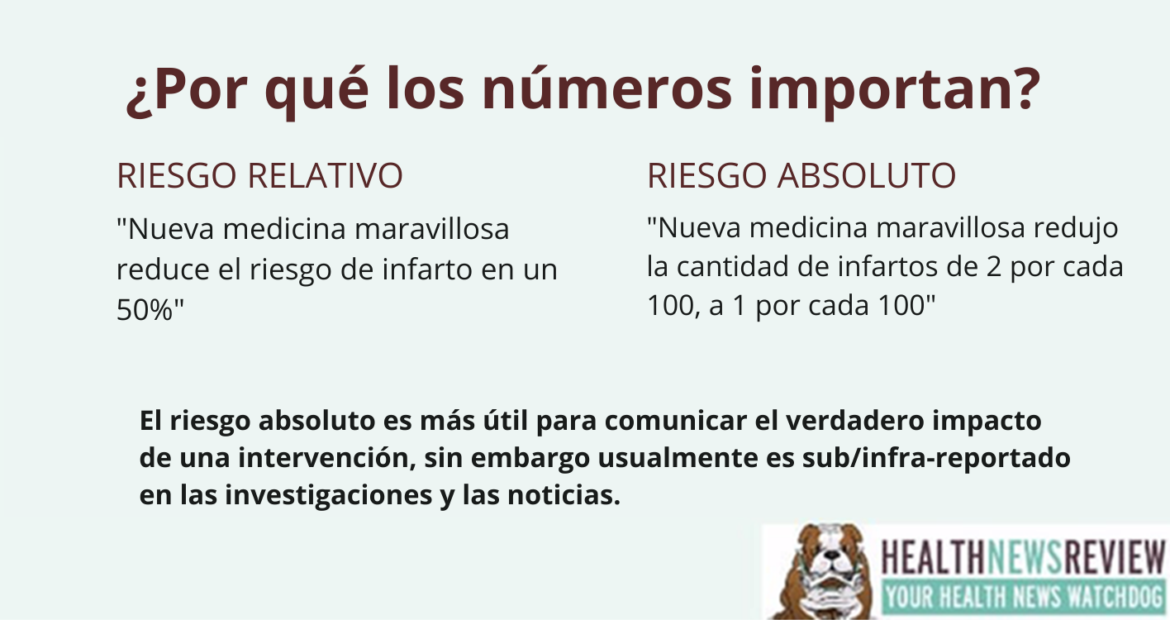

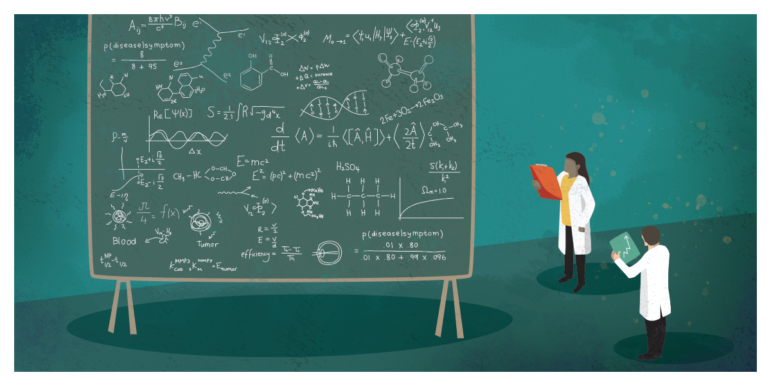

¿Confuso? Echa un vistazo a la ilustración más abajo. Los mismos números. ¿Cuál es más fácil de captar?

Ilustración: Gerd Gigerenzer, Ulrich Hoffrage. How to Improve Bayesian Reasoning Without Instruction: Frequency Formats. Psychological Review, 1995, VoTl02, No. 4,684-704

Hay que poner atención en la manera como se presentan los datos. Quien promueve un resultado concreto puede mostrar la información como un porcentaje (términos relativos) y difundir los resultados más comprometidos (como efectos adversos) en números absolutos. Los números absolutos son más representativos que los porcentajes.

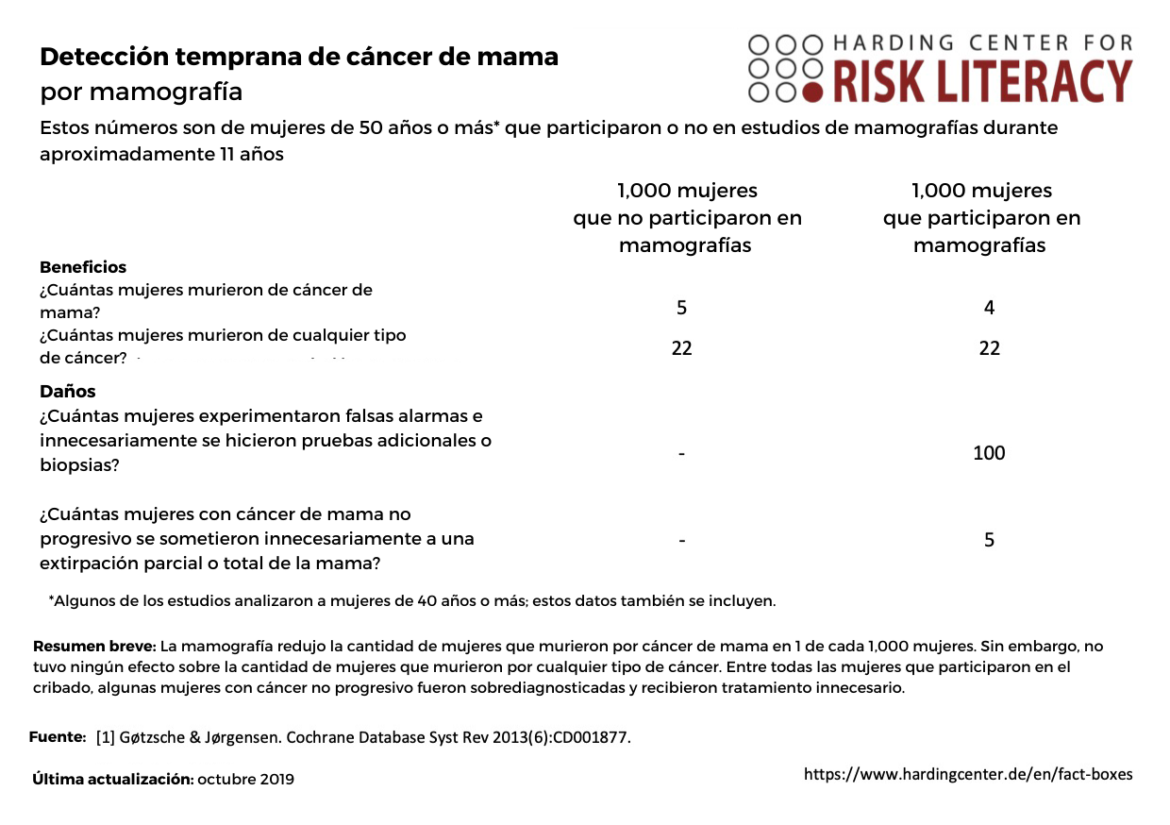

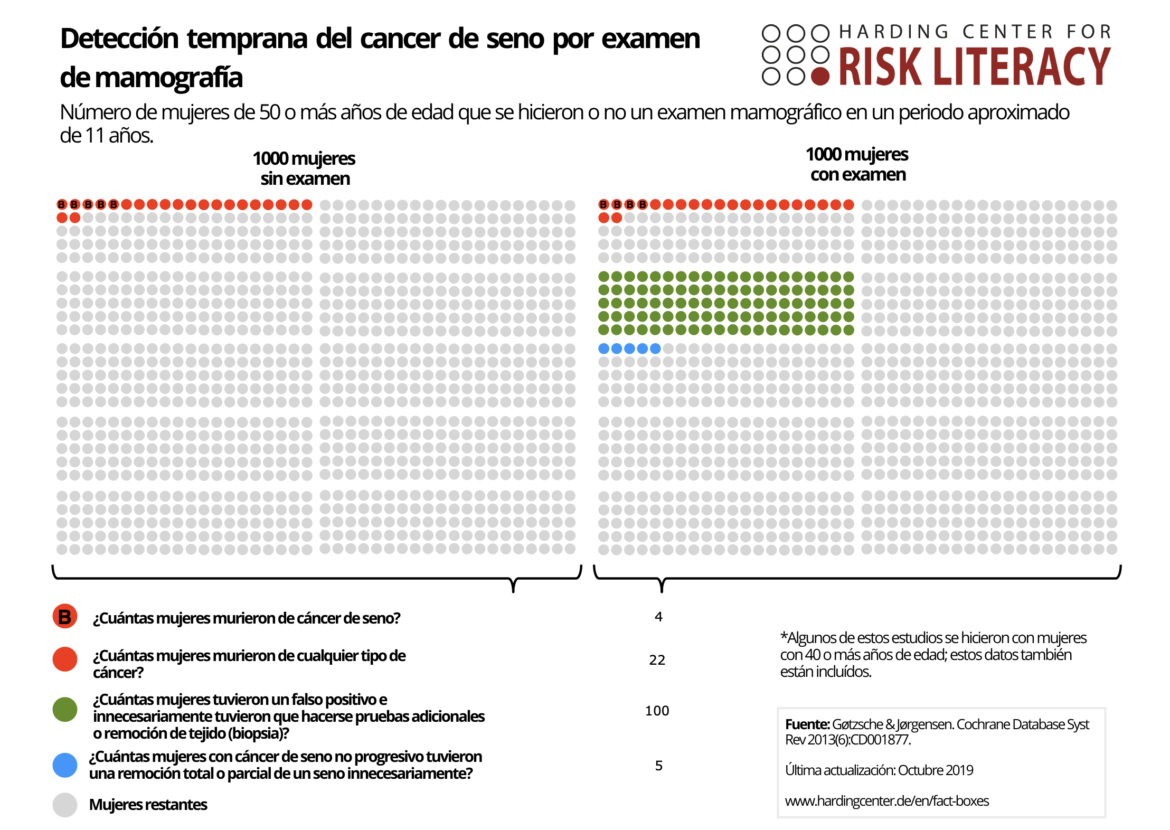

El siguiente ejemplo de Gerd Gigerenzar y coautores, del Centro Harding para el Alfabetismo del Riesgo, muestra cuán engañoso puede ser:

“En 1996 una revisión de exámenes de mamografía destacó en su resumen un 24% de reducción de la mortalidad de cáncer de mama; una revisión en 2002 citó una reducción de 21%. En consecuencia, los panfletos de salud, páginas web y la televisión transmitían una reducción de 20% (o 25%) de la mortalidad. ¿Sabe el público que este número corresponde a una reducción de 1 muerte menos por cada mil mujeres? Es decir, 4 o 5 de cada 1000 mujeres. Es el 0,1% en términos absolutos. La respuesta es no. En una muestra representativa en nueve países europeos, 92% de alrededor de 5,000 mujeres sobreestiman el beneficio 10 veces, 100 veces y más, o no conocen las cifras reales. Por ejemplo, 27% de las mujeres del Reino Unido creían que de cada 1000 mujeres que fueron examinadas, 200 menos morirían de cáncer de mama. Y no son solamente los pacientes los que han sido engañados. Cuando se preguntó qué significaba esa reducción de mortalidad del 25%, el 31% de los 150 ginecólogos respondieron que por cada 1000 mujeres cribadas, 25 o 250 menos morirían”.

El riesgo relativo es a menudo más convincente o favorable desde el punto de vista de las compañías y promotores de campañas de salud pública, que la exposición en valores absolutos (riesgo absoluto).

Lee cómo esto ocurre y comprueba el simple ejemplo que proponen en esta ilustración:

Suena complejo, pero el ejemplo aquí abajo puede ayudar:

El riesgo absoluto es más útil y da idea del verdadero impacto de una intervención. Sin embargo, todavía es poco frecuente verlo tanto en los estudios como en las noticias del Health News Review. Procura utilizar números absolutos porque será capaz de comprenderlos la mayoría de la gente.

El Centro Harding para el Alfabetismo del Riesgo tiene cuadros de datos y despliegues de iconos sobre el cribado de los cánceres de mama y de próstata, que son ejemplos de la mejor práctica: los beneficios y daños están expresados en valores absolutos y con sus comparables. En este caso, los datos provienen de metaanálisis de ensayos clínicos aleatorizados (RTCs).

La siguiente página recoge el cuadro de datos y el despliegue de iconos del cáncer de mama del Centro Harding. En este enlace se pueden descargar en PDF.

Cuarta sugerencia: no te olvides de leer el texto original

“Un estudio pionero publicado por la prestigiosa revista X. . .”, definitivamente

quieres evitar poner esta línea en tu investigación. Incluso las revistas más

prestigiosas tienen que ser examinadas y no pueden considerarse fiables en sí

mismas.

Una forma rápida de aprenderlo es analizando la grabación de un seminario en el Liverpool School of Tropical Medicine por la directora del British Medical Journal Fiona Godlee: Por qué no deberías creer lo que lees en las revistas médicas (Why You Shouldn’t Believe What You Read in Medical Journals). Godlee analiza los fallos del sistema de revisión por pares. Además, explica con franqueza cómo el modelo de negocio afecta el contenido de las revistas científicas, en particular la publicidad. Estas publicaciones aparte cuentan con los ingresos de las «reimpresiones», publirreportajes pagados por la industria y utilizadas con fines de propaganda.

Existe mucha literatura sobre la influencia comercial en el contenido de las revistas médicas. Hay que tener en cuenta, además, que las carreras de los investigadores están determinadas por fenómenos bien estudiados como «publicar o perecer» o por el llamado «factor de impacto» (la frecuencia con que se cita una revista). Los científicos también tienen que atraer financiamiento a sus instituciones, lo que puede generar conflictos de intereses que no tienen nada que ver con la ciencia ni con el bien común.

Una lectura obligada es el ya citado artículo imperecedero de John P. A. Ioannidis, Por qué la mayoría de los resultados de las investigaciones publicadas son falsos (Why Most Published Research Findings Are False).

Desafortunadamente, existen pocos mecanismos para abordar estos problemas. Uno de ellos es la retractación: el artículo de un estudio se elimina de la revista cuando se han demostrado fallos importantes. Sin embargo, esto ocurre con poca frecuencia. Revisa Retraction Watch, un gran recurso para encontrar historias al respecto.

Entonces, ¿cómo manejamos esta complejidad como periodistas? Un camino es buscar revistas que sean independientes de la industria farmacéutica. Hay muchas en el mundo, todas miembros de la International Society of Drug Bulletins.

Es incluso preferible que busques la mejor evidencia disponible, como haría un periodista en cualquier otro campo. Lo que significa: buscar, buscar y buscar. Además, no te limites a leer el resumen del estudio. Revisa siempre el texto completo, sin importar la revista, el autor o de lo que le dijo un experto. Por supuesto, esto es un trabajo exigente que requerirá tiempo, paciencia y haber adquirido más que ciertos conocimientos básicos en metodología y estrategia de evaluación críticas.

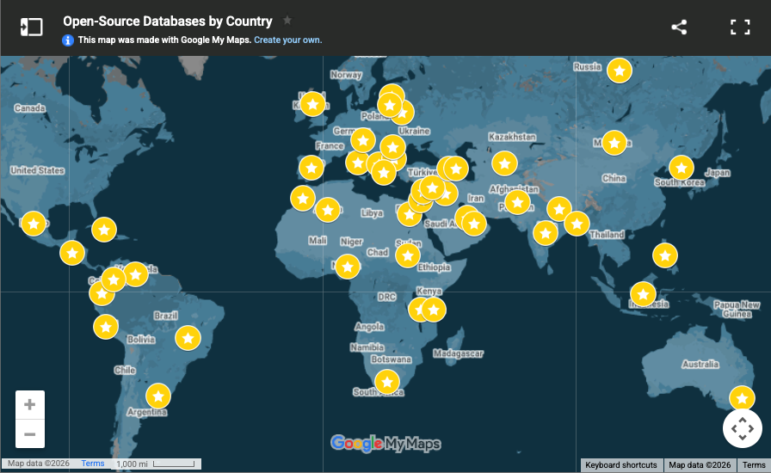

¿Dónde encontrar estudios científicos? PubMed, de la Biblioteca Nacional de Medicina de Estados Unidos (National Library of Medicine, NLM), es una base de búsqueda bibliográfica gratuita, con más de 30 millones de citas y resúmenes de literatura biomédica. MedLine, también de NLM, es una base de datos bibliográfica con más de 26 millones de referencias a artículos de revistas en ciencias de la vida, con especialización en biomedicina.

Algunos estudios no son de acceso libre, lo que dificulta su valoración. Ocurre que la mayoría de los científicos trabaja para instituciones financiadas con fondos públicos y las revistas no le pagan cuando publican sus estudios. Sin embargo, los dueños de estas publicaciones sí cobran a esas mismas instituciones costosas suscripciones. Puedes leer sobre este tema en este artículo de EBMLive, Investigación sin revistas (Research without Journals).

Los artículos de pago a veces pueden estar gratis en Internet o conseguir la opción de enviar un correo electrónico a los autores o a su institución a fin de pedir una copia para revisión. Si cuentas con un buen presupuesto puedes comprar el acceso a los estudios que deseas leer. En PubMed obtendrás un vínculo para acceder a la página del editor, donde se pueden hacer los pagos.

Al igual que la mayoría de los científicos y médicos investigadores, te resultará complicado pagar la gran cantidad de estudios que se necesitan para investigar un tema. El portal de Alexandra Elbakyan, científica y programadora informática de Kazajstán, ofrece varias recomendaciones que te ayudarán: Eliminar todas las barreras en el camino de la ciencia (Sci-Hub: To remove all barriers in the way of science). El sitio web de Elbakyan proporciona acceso a una gran cantidad de estudios científicos que suelen tener barreras de pago. En su sitio web personal se describe a sí misma y su proyecto. Puedes ver también el artículo sobre ella en la revista Science. Los pleitos de los editores obligan a Elbakyan a migrar Sci-Hub a diferentes dominios, que son publicados con regularidad en Twitter.

Captura de pantalla