Image: Hanna Barakat & Archival Images of AI + AIxDESIGN / Better Images of AI / Used under a CC 4.0 license

Haber Merkezleri Haberleri Geliştirmek ve Güven Oluşturmak için Yapay Zeka Sohbet Robotlarını Nasıl Kullanıyor?

Bu Yazıyı Oku

Büyük bir yapay zeka sohbet robotuna veya internet arama motoruna “ABD’nin İran’ı bombalaması küresel petrol fiyatlarını nasıl etkiledi?” gibi bir soru sorun; bir dizi güvenilir rakam, site bağlantısı ve trendle karşılaşırsınız. Örneğin, ChatGPT’nin uzun cevabı şöyle başlıyor: “Brent ham petrolü kısa süreliğine %3’ün üzerinde sıçrayarak varil başına 81-82 dolar civarına ulaştı; bu da Ocak ayından bu yana en yüksek seviye.”

Aynı soruyu Washington Post’un “Ask The Post AI” gibi dahili bir haber odası yapay zeka sohbet robotuna sorduğunuzda, genellikle daha basit ve daha temkinli, alıntı yapılan kaynak makalelerin küçük resimlerinin üstünde, önemli çıkarımlar türünde bir yanıt alırsınız: “Şu an itibarıyla petrol fiyatları dalgalandı, küresel ham petrol yaklaşık %1 düştü, ancak durum belirsizliğini koruyor.”

Ancak asıl fark, bu yanıtlar için bilgi kaynaklarının güvenilirliğidir. Büyük dil modeli (LLM) yapay zekâ sohbet robotları, doğrulanmamış kaynaklar da dahil olmak üzere neredeyse tüm interneti tarar. Bu arada, son birkaç yılda Filipinler’den Birleşik Krallık’a kadar birçok büyük haber merkezi, okuyucu sorularını yalnızca kendi sitelerinin haberlerine ve doğrulanmış kaynak veri tabanlarına dayanarak yanıtlaması beklenen, dışarıdan yanlış bilgi veya önyargı sızmasını önlemek için tasarlanmış katı kod bariyerleri kullanan dahili üretken yapay zekâ sohbet robotlarını kullanıma sundu.

Bu akıllı haber arayüzlerinin önde gelen örnekleri arasında Filipinler’deki Rappler’ın Rai aracı , Financial Times’ın Ask FT’si , Forbes’un Adelaide sohbeti ve Ask The Post AI yer alıyor .

(Not: Bunlar, The Wall Street Journal, Bloomberg ve Yahoo News gibi haber merkezlerinin tanıttığı, okuyucuların sorularını yanıtlamayan, bunun yerine yoğun okuyucuların, yapay zeka tarafından oluşturulmuş madde işaretli haber özetlerini bulmak için bir sekmeye tıklamalarını sağlayarak onlara yardımcı olan yapay zeka haber özeti araçlarından farklıdır.)

Tüm bu sohbet robotu araçları kendilerini deneysel olarak tanımlıyor ve hataya açık hale getiriyorlar. Bunun bir nedeni de, önyargı, hata ve ‘halüsinasyonlar ‘ ile ünlü LLM’lerin dijital iskeleti üzerine inşa edilmiş olmaları.

Ancak, daha geniş internet aramalarını etkileyen yanlış bilgi, yanlış atıf, kaynak gösterilmemiş görüş ve önyargı sorunları göz önüne alındığında, bu platformlar, okuyucuların zaten arkalarındaki medya markalarına olan sadakatleri nedeniyle güvenmeye yatkın oldukları güvenilir bilgiler sunmak gibi asil bir amaca hizmet ediyor. Yanıtlar, haber merkezinin arşivinde yer alan, tamamen haberleştirilmiş ve düzenlenmiş haberlerden elde ediliyor. Yapay zekâ sohbet robotlarının potansiyel kusurlarına rağmen, uzmanlar, haber merkezlerine daha fazla okuyucu etkileşimi, gençlere erişim ve hatta potansiyel abonelik tabanlı gelir akışları için bazı çözümler sunabilecekleri konusunda ihtiyatlı bir iyimserlik içindeler.

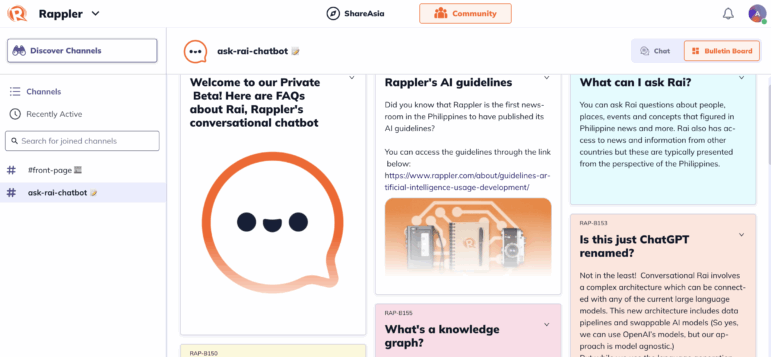

Rappler’ın Rai’si düşük riskli bir deney olarak başladı: Rappler sohbet odasının nispeten güvenli alanında odak grup tartışmaları için bir yapay zeka “moderatörü” olarak. Ekim 2024’te, Rappler uygulamasında çok daha iddialı bir araca dönüştü: bir özet aracı yerine, artık yalnızca 400.000’den fazla yayınlanmış Rappler hikayesinin ve doğrulanmış veri kümelerinin gerçeklerinden yararlanan bir sohbet robotu. Rappler’ın dijital hizmetler başkanı Gemma Mendoza’ya göre , bunlar arasında Rappler’ın 2011’deki kuruluşundan bu yana yayınlanmış 350.000’den fazla makale, ayrıca selefi Newsbreak Magazine’den 10 yıllık derinlemesine ve araştırmacı hikayeler ve Filipinler’deki son beş ulusal ve yerel seçimden sonuçlar, adaylar ve seçmen kütüklerine ilişkin veri kümeleri yer alıyor .

Mendoza, Rai’yi başlatmanın temel amaçlarından birinin okuyucuları Rappler’ın mobil uygulaması Rappler Communities’i indirip kullanmaya teşvik etmek olduğunu söylüyor .

“Sosyal medya haberleri gerçekten de önemsizleştirdi, peki hedef kitlenizle nasıl etkileşim kuracaksınız; sürdürülebilir bir trafik nasıl elde edeceksiniz ve hedef kitlenizin içeriğinizle nasıl etkileşime girmesini sağlayacaksınız?” diye soruyor. “Bu ilişkiyi sürdürmenin bir diğer yolu da haber bültenleri; ki bu Filipinler’de pek yaygın bir uygulama değil. Uygulamamız için iddialı etkileşim hedeflerimiz var ve Rai, içeriğimizle daha ayrıntılı bir şekilde etkileşim kurmanın ve onları daha görünür kılmanın bir yolu.”

Sistemin arkasındaki ‘bilgi grafiği’ veritabanının her 15 dakikada bir arşivlenmiş hikayeler ve kaynak veri kümelerine en son raporları ve araştırmaları eklemesi gerekiyor ve Rai daha sonra uygulama kullanıcılarına birkaç bağlantılı hikayeyle birlikte bilgili ve nispeten güncel yanıtlar sunuyor.

Mendoza, “Yapay zekanın genel sorunu, her yerden bilgi alması ve her noktayı aynıymış gibi ele almasıdır,” diyor. “Rappler’da hikayelerimizin arkasında duruyor ve gerçekleri inceliyoruz; Rai’nin temeli de bu.”

Ancak haber merkezleri, ticari sağlayıcıların bu karmaşık sistemleri sürdürmek için istihdam ettiği büyük veri mühendisliği ekiplerine sahip değil ve haber merkezi sohbet robotlarının bu deneysel çağında arızalar hâlâ yaygın. Örneğin, Rai, Temmuz ayında birkaç hafta boyunca güncelleme işlevindeki bir sorun nedeniyle en son haberleri eklemedi, bu nedenle bazı yanıtlar güncelliğini yitirdi.

Mendoza, LLM altyapısal temeline rağmen Rai’nin en son, özel olarak hazırlanmış versiyonunun, dışarıdan gelen bilgilerin sonuçlara sızmasını önlemek için yenilikçi ve son derece katı bariyerler içerdiğini söylüyor.

Uygulamadaki açıklayıcı notta belirtildiği gibi: “Bu, veri kaynakları içeriği mutlaka doğrulanmamış rastgele web sitelerini içeren diğer sohbet robotlarından farklıdır. Sonuçta, çöp girerse, çöp çıkar.”

“Gerçekten sohbete dayalı bir süreç – mevcut LLM programlarının üzerine bir altyapı oluşturduk; agnostik, yani gerekirse diğer LLM programlarına da taşımaya karar verebiliriz,” diye açıkladı. “Cevaplar yayınlanmış hikayelerden ve yapılandırılmış verilerden elde ediliyor.”

Mendoza şunları ekliyor: “Rappler’ın gerçekten iyi olduğu alanlara odaklanıyoruz, siyasetle başlıyoruz.”

Chatbot Sınırlamaları

Sadece “FT Professional” abonelerine özel olan Ask FT jeneratif yapay zeka aracı, yanıtlarını 2004’ten bu yana Financial Times arşivlerinden çekiyor.

Mayıs ayında, Columbia Gazetecilik Okulu’nda mesleki uygulama profesörü olan Bill Grueskin , bu sohbet robotunu test etti ve gerçeklerin gazeteciler tarafından doğrulandığını, ancak bazı yanıtların aracın veritabanının sınırlamalarını hızla ortaya koyduğunu ve “Tesla 2024’te kaç araba sattı?” gibi sorulara cevap veremediğini” belirtti.

Ancak Grueskin, düzenli bir yapay zeka kullanıcısı olmamasına rağmen chatbot’tan birçok fayda elde etti.

“Arayüz basit,” diyor. “Sorunuzu yazdığınız bir kutu var – örneğin “Çin-ABD ticaret savaşındaki son durum nedir?” – ve saniyeler içinde, yanıtını şekillendiren FT haberlerine dipnotlar ve bağlantılar içeren, düşünceli ve doğru bir özet yanıt üretebiliyor.”

Grueskin, GIJN’e verdiği röportajda, haber odası yapay zeka modelinin haber etkileşimi, daha iyi bilgilendirilmiş bir kamuoyu ve çok daha iyi arşiv araması açısından mütevazı bir vaat sunduğunu söylüyor.

“Genel olarak bu fikri beğeniyorum,” diye açıklıyor. “Bunun bir nedeni, çoğu haber sitesinin arama motorunun berbat olması. Büyük haber siteleri bile: Kötü sonuçlar veriyorlar, tarihe göre sıralama yapmanıza izin vermiyorlar. Örneğin, terimleri Google’a “site:nytimes.com” ile birlikte girdiğimde çok daha iyi arama sonuçları alıyorum. Yapay zeka bunu daha iyi bir deneyim haline getiriyorsa ve yanıtlar, daha önce yayınlanmış düzenlenmiş haberleri içeren tek bir temel veritabanından geliyorsa – ve muhabir bir hata yaparsa, daha sonraki düzeltmeleri de içeriyorsa – harika.”

“Bunu, yapay zekanın halüsinasyon niteliğinde alıntılar ve gerçekler eklemesini engelleyecek şekilde yapabileceğinizi varsayıyoruz.” diye ekledi.

Harvard Kennedy Okulu Kamu Yararı Teknoloji Laboratuvarı başkanı Dr. Latanya Sweeney , haber odası sohbet robotlarının sınırlı veri tabanlarının ötesinde olası bir sorununun, yapay zeka programlarının geçmiş haberlere dayanarak istemeden yanıltıcı yanıtlar verebilmesi olduğunu söylüyor. Örneğin, bir kamu sektörü hakkındaki yanıtlar, o konudaki haber değeri taşıyan tartışmalar hakkındaki gerçeklerle çarpıtılabilir. Bazı haber odası arayüz araçlarının, nihayetinde tek bir haber arşivinin katı veri sınırları ile bağımsız haber odaları arasındaki arşiv iş birliklerini içeren daha geniş internet arasında bir orta yol arayacağını belirtiyor.

“Arşivinizdeki makaleler belirli bir konu hakkında oldukça spesifikse ve yalnızca bir kısmından bahsediyorsa, soruyu yalnızca o bakış açısıyla yanıtlıyor olabilir,” diye açıklıyor. “Daha iyi, doğru kaynaklara dayanan bir cevap olabilir. Sadece kendi arşivinizi kullanmakta çok fazla katılık var. Bu nedenle, [yapay zeka yanıtlarını bilgilendiren] güvenilir gazetecilik arşivlerinden oluşan ekosistemlere sahip olmak harika olabilir.”

Uzmanlar, harici sitelere karşı geliştirilen dijital güvenlik duvarının, bu dahili sohbet robotları tarafından uydurulan bilgilerin riskini büyük ölçüde azalttığını ancak tamamen ortadan kaldırmadığını söylüyor.

Rai’den gelen yanıtlar, Rappler’ın normal editoryal düzeltme politikasına tabidir ve okuyucular olası hataları sohbet odalarında veya e-posta yoluyla bildirmeye davetlidir . Kuruluş, “Hatanın nedenini bulmaya ve gerekirse kaynak materyali düzeltmeye çalışacağız” ifadesini kullanmaktadır.

Birçok kullanıcı için haber odası sohbet robotlarının en canlandırıcı ve güven verici özelliklerinden biri, bazen bir soruya etkili bir şekilde “Bilmiyorum” şeklinde yanıt verebilmeleri. “1922’de Londra’da Sir Henry Wilson’ın suikastını kim emretti?” diye sorarsanız, Post’un sohbet robotu “Üzgünüz, bir yanıt üretemedik” diye kabul ediyor. Ancak ChatGPT, İrlanda İç Savaşı’nı tetikleyen bir olayı çevreleyen oldukça tartışmalı ve bölücü bir iddia olmasına rağmen, “Muhtemelen emri veren: İrlanda Özgür Devlet Geçici Hükümeti lideri Michael Collins” şeklinde kendinden emin bir şekilde yanıt veriyor.

Mendoza, “Yapay zekanın bir sorunu, doğrulanmış verileri olmasa bile soruları yanıtlamaya çalışmasıdır, bu yüzden bazı güvenlik önlemlerinin alınması gerekir,” diye uyarıyor. “Bu yüzden Rai, çoğu zaman soruyu doğru yorumlayabileceğinden emin olmadığı için ‘Bunu bilmiyorum’ demeyi biliyor.”

Rai’nin lansmanında, Rappler’ın veri ve inovasyon başkanı Don Kevin Hapal, girişimin kâr amacı gütmeyen haber merkezleri için örnek alınabilecek bir model teşkil ettiğini öne sürdü: “Rai ile sadece yeni bir yapay zeka aracı piyasaya sürmüyoruz, aynı zamanda haber merkezlerinin kamuoyunun güvenini kazanmak için verileri ve yapay zekayı nasıl kullanabileceğini tanımlıyoruz. Rai’yi Rappler’ın gazetecilik titizliğinin bütünlüğüne bağlayarak, yapay zekanın dezenformasyon karşısında gerçeği desteklemek için sorumlu bir şekilde entegre edilebileceğini gösteriyoruz.”

Üretken yapay zekanın ortaya çıkışından önce, bazı araştırmacı haber odaları etkileşimli karar ağaçlarına dayalı haber yanıt arayüzleri sunuyordu.

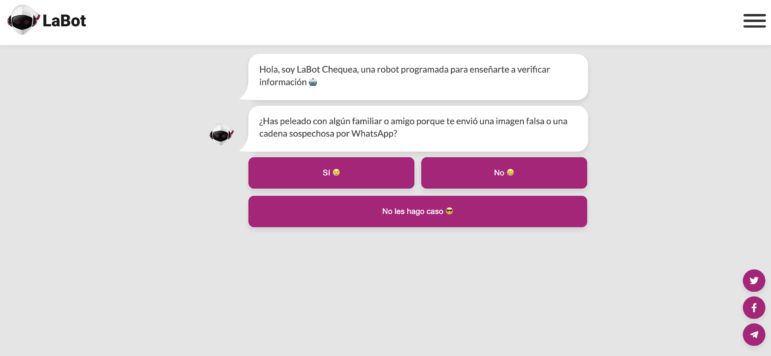

Bunun en önemli örneklerinden biri, 2017 ile 2023 yılları arasında kullanıcıların gazeteciler tarafından önceden yazılmış bir dizi soru arasından seçim yaparak, Telegram veya Facebook Messenger aracılığıyla kendi haber odası haberciliği hakkında bir dizi sohbet tarzında yanıt bulmak için sekmeleri kullanabildikleri Şili’deki LaBot’tu.

LaBot’un kurucu ortaklarından Francisca Skoknic , bu deneysel sohbet robotunun popülaritesinin, okuyucuların gerçekler hakkında kısa ve güvenilir sohbetlere olan genel iştahını gösterdiğini söylüyor.

“Bence bu [haber odası yapay zekası] sohbet robotları mantıklı çünkü çoğu zaman insanlar makalelerin tamamını okumaya vakit bulamıyor, ancak güvenilir bir markadan, özellikle de Rappler gibi bir ülkedeki güncel olaylar hakkında kapsamlı ve doğrulanmış bilgiler sunan bir kaynaktan, belirli yanıtlar almak istiyorlar,” diyor Skoknic. “Ancak bu araçların, yanıtları zorlamak yerine ‘Bilmiyorum’ diyebilmesi önemli. Sohbet robotları, haberlerden çok farklı bir şekilde duygusal bir bağ kurabiliyor.”

Dahili Kullanım ve Geliştirme

Mendoza, chatbot’un aynı zamanda Rappler muhabirlerinin haberlere hazırlanmasına da yardımcı olduğunu söylüyor.

“Editör ekibimiz bunu çok kullanıyor,” diye belirtiyor. “Örneğin, inanç muhabirimiz haberlerinin ön hazırlıklarını yapıyor, ancak bunun yanında Rai’nin de yardımıyla Rappler’ın zaten bildiklerini sentezlemesi için arka plan bilgileri de hazırlıyor.”

Şöyle ekliyor: “Rai’nin bir kullanım alanı, her zaman takip etmediğiniz konularda yardım almaktır. [Eski Başkan] Duterte’nin gizli fonları hakkında birçok maraton duruşma yapıldı, güncel kalmanız gerekiyor ve Rai’den son gelişmeleri isteyebilirsiniz. Sağlık sigortası fonlarıyla ilgili endişeler nelerdi? Bütçe neden kısıldı? Haberlerde boy gösteren bu karakter kim? Rai’ye sorabilirsiniz.”

Mendoza, kendi yapay zeka sohbet robotlarını piyasaya sürmeyi düşünen diğer haber odaları için gazetecilerin tasarım hedeflerine entegre bir şekilde dahil olmasının hayati önem taşıdığı konusunda uyarıyor.

“Evet, veri mühendislerine ve geliştiricilere ihtiyacınız var ve bu araçları aşamalı olarak devreye almalısınız,” diye açıklıyor. “Ancak mühendislerin kendi hallerine bırakılmaması önemli. Mühendislik ve içerik arasında sıkı bir entegrasyona ihtiyacınız var. Bu botların tasarlanma biçiminde bir editoryal zihniyete ihtiyacınız var.”

Mendoza, haber odalarının olası bir sohbet robotunun amacını tanımlayarak ve bu teknolojinin neler yapabileceği ve yapamayacağı konusunda net bir anlayış geliştirerek işe başlamaları gerektiğini ekliyor.

“Özetleme tak-çalıştır olabilir, ancak sohbet robotları tak-çalıştır değildir,” diye açıklıyor. “Orada bir koruma mimarisinin olması önemli, aksi takdirde bir şeyleri uydurma olasılığı var.”

Rowan Philp, GIJN’nin küresel muhabiri ve etki editörüdür. Güney Afrika’nın Sunday Times gazetesinin eski baş muhabiri olan Philp, dünya çapında yirmiden fazla ülkeden haber, siyaset, yolsuzluk ve çatışma konularında haber yapmış ve ayrıca İngiltere, ABD ve Afrika’daki haber merkezlerinde görevlendirme editörü olarak görev yapmıştır.

Rowan Philp, GIJN’nin küresel muhabiri ve etki editörüdür. Güney Afrika’nın Sunday Times gazetesinin eski baş muhabiri olan Philp, dünya çapında yirmiden fazla ülkeden haber, siyaset, yolsuzluk ve çatışma konularında haber yapmış ve ayrıca İngiltere, ABD ve Afrika’daki haber merkezlerinde görevlendirme editörü olarak görev yapmıştır.