Guide pour authentifier une vidéo

Les chercheurs et les journalistes doivent souvent vérifier le contenu de vidéos publiées sur les réseaux sociaux et les plateformes de partage de fichiers, tels YouTube, Twitter ou Facebook. Mais un seul outil ne suffit pas à authentifier toutes les vidéos, et cette tâche est parfois quasiment impossible à effectuer autrement qu’en obtenant le fichier d’origine.

Il existe néanmoins des méthodes permettant de vérifier la plupart des contenus, en particulier pour garantir que des vidéos dites d’actualité ne recyclent pas des évènements passés. De nombreux guides en ligne, dont le manuel de vérification, vous aideront à vérifier des contenus vidéos.

particulier pour garantir que des vidéos dites d’actualité ne recyclent pas des évènements passés. De nombreux guides en ligne, dont le manuel de vérification, vous aideront à vérifier des contenus vidéos.

Ce guide présente quelques techniques supplémentaires fréquemment employées par l’équipe de Bellingcat, et vous donnera des tuyaux pour contourner les limites des outils disponibles. Voir le Guide de Bellingcat sur l’utilisation de la recherche d’image inversée dans le cadre d’enquêtes (2019). Le guide ci-dessous devrait vous apprendre à utiliser tout un ensemble d’outils, mais aussi à être inventif afin d’éviter les impasses au cours de vos recherches.

La recherche d’image inversée : un outil imparfait mais utile

La première étape de la vérification de contenus vidéos est la même que pour la vérification d’images : exécuter une recherche d’image inversée sur Google ou via un autre service, par exemple TinEye. Aucun outil en libre circulation ne permet actuellement d’effectuer une recherche d’image inversée sur l’intégralité d’une vidéo, on se résoudra donc à utiliser cette méthode sur des captures d’écran. Les auteurs de vidéos truquées sont d’habitude peu créatifs et partagent donc le plus souvent des vidéos qu’ils auront trouvé en ligne, s’étant assurés au préalable qu’elles ne contiennent aucun élément révélant la supercherie, comme par exemple une personne s’exprimant dans une langue qui ne correspond pas à l’événement en question. Pour cette raison, il est d’habitude relativement simple de retrouver les vidéos d’origine.

actuellement d’effectuer une recherche d’image inversée sur l’intégralité d’une vidéo, on se résoudra donc à utiliser cette méthode sur des captures d’écran. Les auteurs de vidéos truquées sont d’habitude peu créatifs et partagent donc le plus souvent des vidéos qu’ils auront trouvé en ligne, s’étant assurés au préalable qu’elles ne contiennent aucun élément révélant la supercherie, comme par exemple une personne s’exprimant dans une langue qui ne correspond pas à l’événement en question. Pour cette raison, il est d’habitude relativement simple de retrouver les vidéos d’origine.

Il y a deux façons d’effectuer cette recherche. La première consiste à prendre manuellement des captures d’écran de la vidéo qui vous intéresse, de préférence vers le tout début ou à des moments clés du clip, puis à les faire passer par un service de recherche d’image inversée, tel que Google Images. La seconde consiste à utiliser les vignettes générées par le site qui héberge la vidéo, en général YouTube.

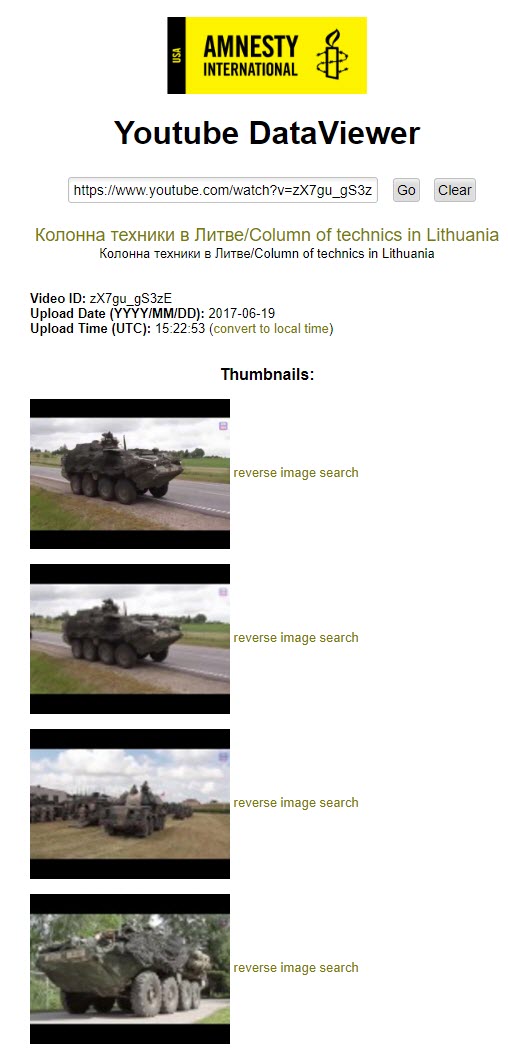

Il est difficile de prédire quelle image servira de vignette à la vidéo, Google ayant développé un algorithme complexe permettant à YouTube de sélectionner la vignette la mieux adaptée à chaque vidéo. (Pour davantage d’informations sur ce sujet, je vous invite à consulter le blog Google Research.) Le meilleur moyen de  trouver ces vignettes reste encore l’outil de recherche YouTube DataViewer, d’Amnesty International : il vous suffit d’y saisir l’URL de la vidéo YouTube puis, une fois que la vignette s’affiche, de la soumettre à une recherche d’image inversée.

trouver ces vignettes reste encore l’outil de recherche YouTube DataViewer, d’Amnesty International : il vous suffit d’y saisir l’URL de la vidéo YouTube puis, une fois que la vignette s’affiche, de la soumettre à une recherche d’image inversée.

Par exemple, un agrégateur sur YouTube nommé Action Tube a récemment publié une vidéo censée montrer un convoi de matériels militaires en Lituanie, mais en n’indiquant ni la source ni la date de ces images. Elles pourraient donc dater d’hier comme elles pourraient être vieilles de cinq ans. [NDLR : la vidéo utilisée comme exemple dans ce guide a été supprimée mais vous pouvez utiliser le même processus avec n’importe quelle autre vidéo].

L’outil d’Amnesty International révèle la date et l’heure exacte à laquelle Action Tube a publié la vidéo, ainsi que quatre images qui en sont tirées pour vous permettre d’effectuer une recherche d’image inversée.

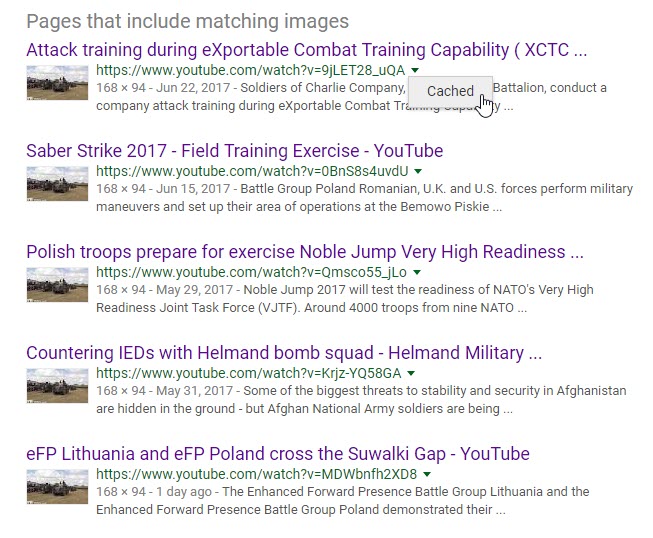

En l’occurrence, cette recherche ne nous permet pas de retrouver la source de la vidéo. Cependant, les résultats concernant la troisième vignette nous dirigent vers d’autres vidéos qui ont été associées à cette même vignette. En cliquant dessus, la vignette recherchée n’apparaîtra pas forcément sur votre écran, car les vidéos dans la liste d’attente sont adaptées à chaque utilisateur. En tout cas, la vidéo associée à cette vignette était bien là au moment où Google a sauvegardé les résultats ; vous pouvez donc retrouver la vidéo en mémoire cache.

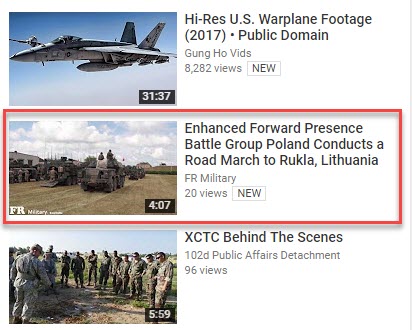

Rappelons qu’aucun de ces cinq résultats ne nous donne l’originale de la vidéo que nous recherchons, mais quand Google a mis en mémoire cache une capture d’écran de la page en question, la vignette recherchée était bien présente sur ces vidéos. La mémoire cache du premier des résultats ci-dessus nous indique la source de la vidéo publiée par Action Tube et intitulée « Le groupement tactique amélioré de la présence avancée en Pologne se dirige vers Rukla, en Lituanie ».

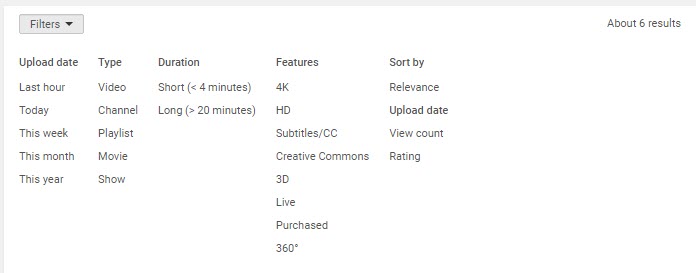

Nous disposons maintenant de l’ensemble des informations qu’il nous faut pour retrouver la vidéo originale et vérifier que la vidéo d’Action Tube montre bien un déploiement récent d’équipements militaires en Lituanie. En recherchant le titre de la vidéo trouvée à partir de la vignette, nous tombons sur six vidéos. Un tri chronologique révèle la vidéo la plus ancienne, c’est-à-dire celle qui a servi de matériau source à Action Tube.

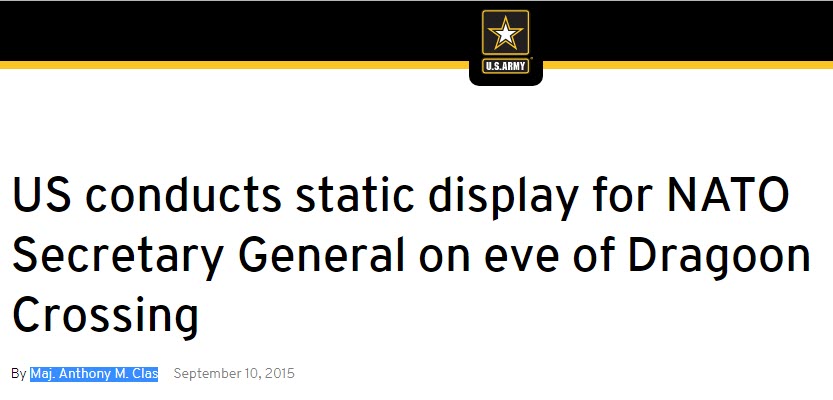

Venons-en à une vidéo mise en ligne le 18 juin 2017 (soit la veille de la vidéo d’Action Tube) par un certain « Maj Anthony Clas ». Il s’agit de la même vidéo que celle mise en ligne par Action Tube.

En recherchant cette personne, on découvre qu’elle a écrit des articles pour le site internet de l’armée américaine au sujet des activités de l’OTAN en Europe, ce qui signifie qu’elle est probablement chargée de communications pour l’organisation, et rend d’autant plus crédible l’idée qu’Action Tube se soit servi de sa vidéo.

L’inventivité toujours plus forte que les algorithmes

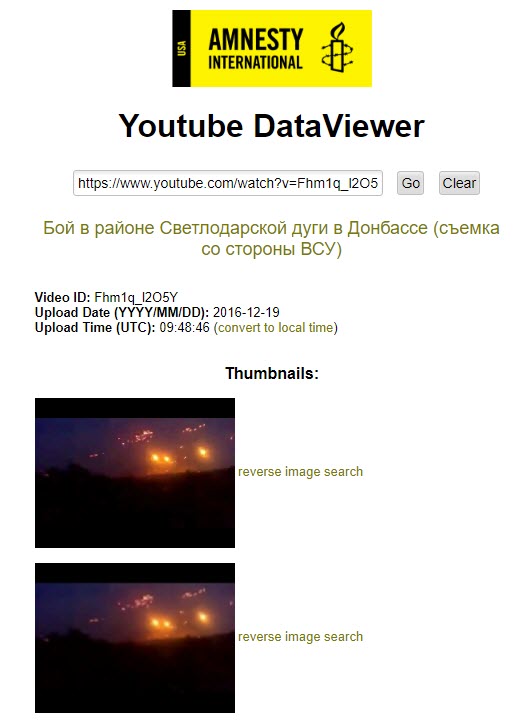

Bien que la recherche d’images inversée puisse mettre au jour de nombreuses fausses vidéos, ce n’est pas une solution miracle. Par exemple, la vidéo ci-dessous, qui a été visionnée plus de 45 000 fois, prétend montrer des combats entre des soldats ukrainiens et des forces séparatistes soutenues par la Russie près de Svitlodarsk, dans l’est de l’Ukraine. Le titre peut se traduire ainsi : « Bataille dans la bosse de Svitlodarsk, dans le Donbass (prise du point de vue des forces armées ukrainiennes) ». On y voit de nombreux coups de feu et tirs d’artillerie, alors même que des soldats rient.

En saisissant l’URL de la vidéo dans l’outil d’Amnesty International, on apprend la date et l’heure exactes de sa mise en ligne. On obtient aussi des vignettes nous permettant d’effectuer une recherche d’image inversée.

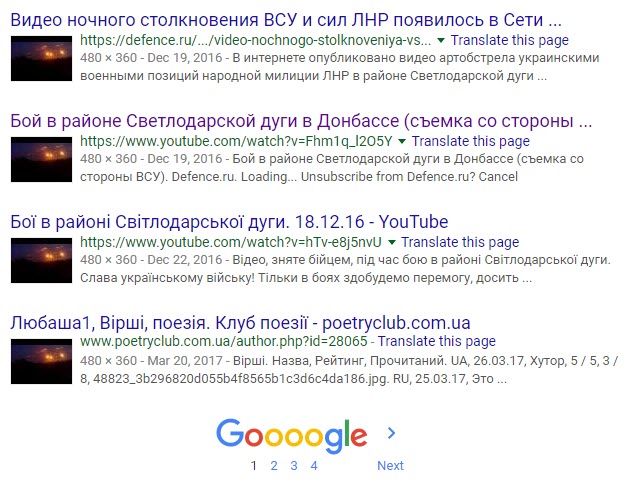

Presque tous les résultats ont été mis en ligne vers le même moment, ce qui donne l’impression que la vidéo pourrait bien montrer des combats près de Svitlodarsk en décembre 2016.

La vidéo montre pourtant un exercice militaire russe ayant eu lieu en 2012.

Même un usage particulièrement ingénieux de la recherche d’images inversée sur Google et de l’outil d’Amnesty International ne vous permettra pas de retrouver cette vidéo originale, sauf dans des articles expliquant la supercherie après la diffusion des fausses vidéos. Par exemple, si nous recherchons le titre exact de la vidéo d’origine (« кавказ 2012 учения ночь», ce qui signifie « exercice de nuit Kavkaz 2012 », rapport aux exercices militaires ayant eu lieu à Kavkaz en 2012), ainsi qu’une capture d’écran de la vidéo, nous ne trouvons que des résultats affichant la fausse vidéo de Svitlodarsk. Pour se rendre compte que la vidéo était fausse, il fallait être familier de la vidéo originale, ou du moins se méfier des rires des soldats, qui pourraient indiquer qu’ils n’étaient pas en situation de combats réels.

Que faire dans ce cas de figure ? Il n’y a pas de réponse toute faite, à part vous inviter à faire preuve d’un esprit inventif.

Se mettre à la place de la personne qui a partagé une vidéo potentiellement truquée peut s’avérer utile à vos recherches. Dans l’exemple ci-dessus, le rire du soldat sert d’indice qu’il ne s’agit pas d’un vrai combat : dans quelles circonstances un soldat russophone filmerait-il un combat tout en riant ?

Si vous vouliez effectuer ce genre de manipulation, quelle vidéo emploieriez-vous ? Une vidéo prise la nuit rendrait la scène moins reconnaissable. Il vous faudrait des images de combats spectaculaires, mais qui ne soient pas connues des Ukrainiens ou les Russes après la guerre dans le Donbass : des vidéos d’exercices de l’armée russe, ukrainienne ou biélorusse pourrait donc convenir, tout comme des images de guerre dans un autre pays, avec doublage en russe. En recherchant « exercices militaires » et « nuit » (en russe), cette vidéo serait votre tout premier résultat. Si vous n’aviez pas réussi à accéder à la vidéo d’origine, la meilleure façon de vérifier l’authenticité de cette vidéo aurait été de contacter la personne qui l’a mise en ligne.

Transformez-vous en détective numérique, avec un sens aigu du détail

L’utilisation d’outils numériques pour vérifier des contenus a ses limites, car les algorithmes peuvent être induits en erreur. Des techniques assez simples à mettre en oeuvre permettent d’éviter qu’une recherche d’image inversée ne révèle une supercherie : on peut par exemple citer la mise en miroir d’une vidéo, l’usage du noir et blanc, et le zoom/dézoom. Pour détecter ces méthodes, il faut avoir un sens aigu du détail et s’assurer que le milieu environnant est cohérent avec l’événement concerné.

Le 19 septembre 2016, des informations ont circulé selon lesquelles l’homme responsable de trois explosions à New York et au New Jersey avait été arrêté à Linden, dans le New Jersey. Plusieurs photos et vidéos sont apparues à différents endroits, dont les deux ci-dessous montrant le suspect, Ahmad Khan Rahami, par terre et cerné par des policiers.

Le lieu exacte de l’arrestation ne circulait pas encore, mais il y avait fort à parier que ces deux photos étaient réelles, puisqu’elles montraient la même scène sous deux angles différents. La vidéo ci-dessous provenait d’un citoyen local. De toute évidence, la vidéo n’est pas truquée, puisque de nombreux médias l’ont diffusée tout au long de la journée. Mais, à titre d’exemple, comment aurions-nous pu vérifier son authenticité ultra rapidement ?

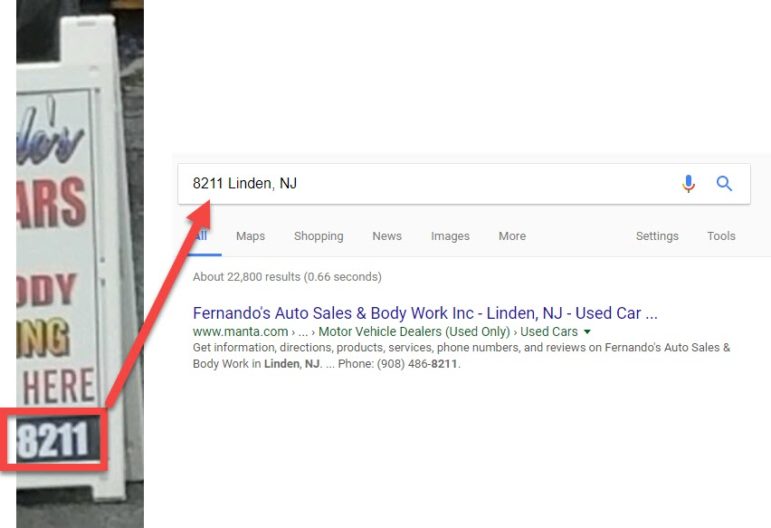

A partir des deux photos, on peut établir en peu de temps où Ahmad Khan Rahami a été interpellé. Dans le coin inférieur gauche de la deuxième photo on voit une affiche publicitaire sur laquelle sont imprimés quatre chiffres (8211), ainsi que des fragments de mots, comme « ARS » et « ODY ». On remarque également, tout près, un carrefour avec la route 619, ce qui nous permet de localiser la scène plus précisément. En recherchant un numéro de téléphone contenant 8211 à Linden, dans le New Jersey, on trouve le garage Fernando’s Auto Sales & Body Work, qui complète les fragments « ARS » et « ODY » – voitures (cars en anglais) et carrosserie (body). Fernando’s se situe au 512 E Elizabeth Ave à Linden, dans le New Jersey.

On peut alors vérifier l’adresse sur Google Street View, pour s’assurer qu’on est sur la bonne voie.

À gauche : une photo d’un suspect arrêté à Linden, dans le New Jersey. À droite : une photo du même emplacement disponible sur Google Street View

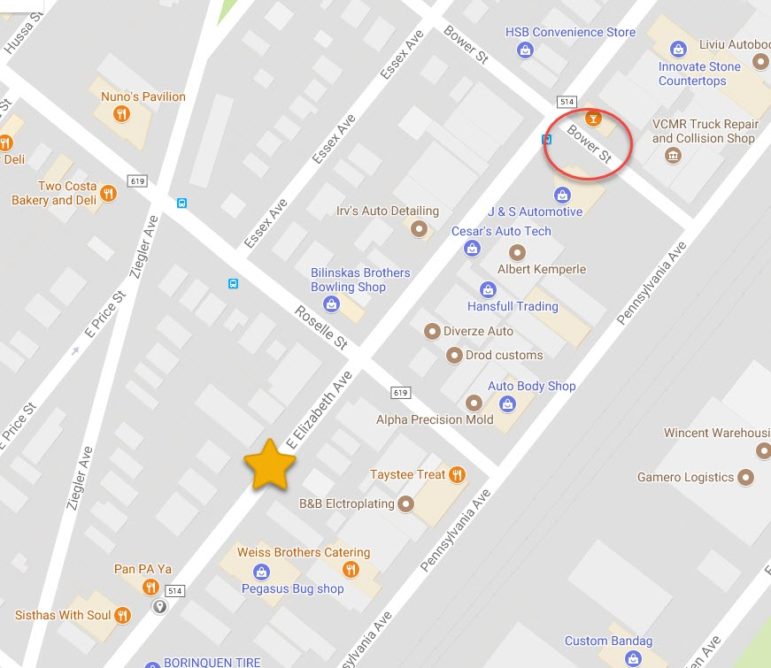

Par ailleurs, le temps – ciel couvert, forte humidité – est le même sur les deux photos ainsi que sur la vidéo. Vingt-six secondes après le début de la vidéo, le conducteur passe devant un panneau indiquant la rue « Bower St » et un autre panneau marquant le carrefour de la route 619, nous donnant ainsi une localisation géographique à recouper avec celle des deux photos.

Un coup d’œil sur Google Maps nous montre que la rue Bower croise East Elizabeth Ave, où le suspect a été interpellé près du garage (représenté par l’étoile jaune).

Si vous avez le temps, vous pouvez retrouver l’emplacement exact où la vidéo a été filmée en comparant les objets visibles sur Google Street View avec ceux visibles dans la vidéo.

Bien que chacune de ces étapes puisse sembler pénible, si vous savez quoi rechercher le tout ne devrait vous prendre que quelques minutes. Si vous n’avez pas accès au témoin oculaire ayant filmé l’incident, il faudra vous montrer attentif aux détails des images et faire usage de Google Maps et Google Street View. La vérification de contenus vidéos est une compétence indispensable et mériterait d’être utilisée pour toute diffusion sur les réseaux sociaux, les fausses vidéos étant fréquemment employées pour répandre des fausses informations.

Distinguer le vrai du faux

Modifier numériquement des vidéos, en ajoutant ou en retirant des éléments sans dénaturer l’ensemble, demande beaucoup d’effort et de talent. Les vidéos peuvent être modifiées pour induire les journalistes en erreur, mais aussi pour échapper aux algorithmes à la recherche de contenus protégés par des droits d’auteur. Des films, des émissions de télévision ou des événements sportifs peuvent ainsi être publiés sur YouTube avec la vidéo inversée (en effet miroir), de sorte qu’elle reste en ligne (bien qu’elle soit un peu rebutante) sans que l’on se rende compte qu’elle viole les lois de propriété intellectuelle. La meilleure façon de détecter rapidement si une vidéo a été inversée est d’y rechercher du texte ou des chiffres : on verra alors aisément s’ils ont été retournés.

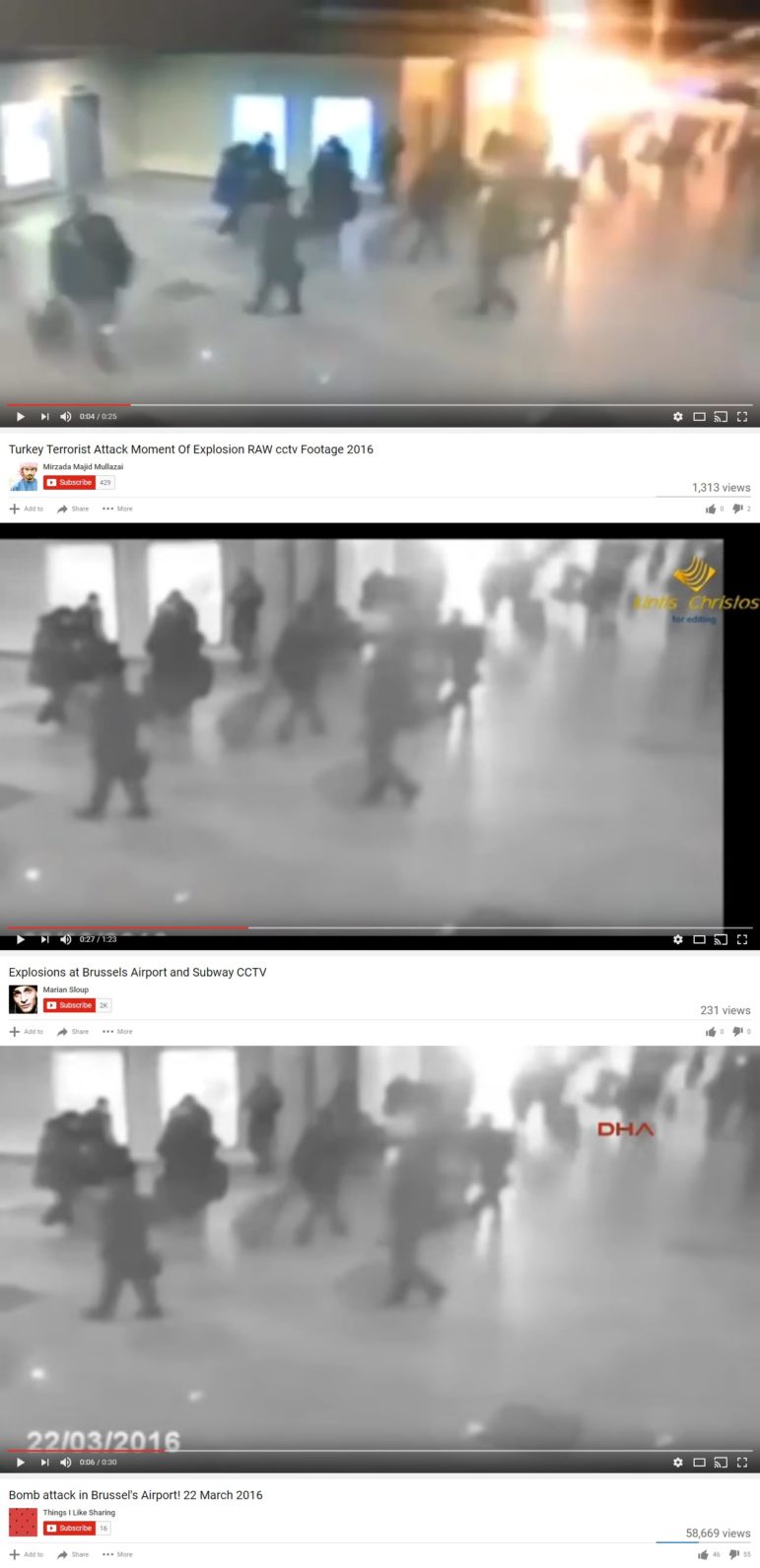

Dans la série de captures d’écran ci-dessous, des images d’une attaque de 2011 à l’aéroport de Moscou Domodedovo ont été reprises dans de fausses vidéos censées montrer les attaques qui ont eu lieu dans les aéroports de Bruxelles et d’Istanbul. Parmi les effets utilisés par les faussaires : aggrandir des segments de la vidéo, ajouter de faux horodatages et la mettre en noir et blanc. Des logos voyants sont souvent ajoutés sur les images, ce qui rend d’autant plus difficile l’utilisation de logiciels de recherche d’images inversée.

Aucun outil ne permet aisément de révéler la supercherie dans ce cas – il faut vous fier à votre bon sens et à votre inventivité. Comme avec la vidéo de l’exercice militaire russe présentée comme une séquence de combat, mieux vaut se mettre à la place du faussaire : où iriez-vous pour trouver une telle vidéo ? La recherche des termes “airport explosion” (« explosion aéroport ») ou “CCTV terrorist attack” (« attaque terroriste vidéosurveillance ») vous donnera les images de l’attaque à l’aéroport de Domodedovo beaucoup plus vite qu’une recherche par image inversée des captures d’écran.

Pas de solution miracle

On pourrait penser que les avancées technologiques nous permettront à terme de déceler toutes les fausses nouvelles et contenus truqués, mais on a du mal à imaginer des outils numériques qui en seraient capables à tous les coups. En d’autres termes, une course à l’armement entre créateurs de tels outils et faussaires un tantinet créatifs est une bataille perdue d’avance, à l’exception de contrôles plus stricts des contenus sur les réseaux sociaux et sur YouTube, qui auraient un véritable effet dissuasif. Les outils numériques dont nous disposons pour authentifier les contenus vidéos sont importants, mais notre propre inventivité l’est encore plus.

Cet article, d’abord publié sur le site de Bellingcat, est repris ici avec l’autorisation de l’organisation. Il a été traduit en français par Olivier Holmey.

Aric Toler travaille à Bellingcat depuis 2015. Il est spécialisé dans la vérification d’informations publiées par les médias russes, le conflit dans l’est de l’Ukraine, l’influence russe sur l’extrême droite américaine et européenne et l’enquête sur le vol MH17.

Aric Toler travaille à Bellingcat depuis 2015. Il est spécialisé dans la vérification d’informations publiées par les médias russes, le conflit dans l’est de l’Ukraine, l’influence russe sur l’extrême droite américaine et européenne et l’enquête sur le vol MH17.