Imagen: Shutterstock

Caos y fiabilidad: Una mirada a cómo la IA impacta la libertad de prensa y el periodismo de investigación

Leer este artículo en

Desde que la Asamblea General de las Naciones Unidas proclamó hace 32 años el Día Mundial de la Libertad de Prensa, dicha libertad ha estado sujeta a cambios radicales, que van del proverbial florecimiento de los mil medios de comunicación tras la Guerra Fría y la Primavera Árabe, a un lento retroceso al control y pérdida de independencia a causa del resurgimiento de guerras y represiones autoritarias.

La recién publicada Clasificación Mundial de la Libertad de Prensa, elaborada cada año desde 2002 por Reporteros sin Fronteras (RSF) arroja que la situación global de la libertad de prensa ha llegado al nivel más bajo desde que comenzó a publicarse este índice. RSF estima la situación de la libertad de prensa en promedio como “difícil”, y considera que las condiciones para el periodismo son “pobres” para la mitad de los países en el mundo.

En medio de esta turbulencia del periodismo, la inteligencia artificial, los grandes modelos de lenguaje y los algoritmos predictivos han surgido en todos los escenarios mediáticos. Si bien estos desarrollos tecnológicos cambian los paradigmas establecidos, su revolucionario potencial también trae promesas y peligros. Las salas de redacción más pequeñas pueden ahora utilizar herramientas de IA para lograr poderosos y novedosos caminos periodísticos, pero esta tecnología igualmente amenaza al modelo tradicional de negocios de noticias, ofreciéndoles a los actores de mala fe y a los extremistas políticos una poderosa y novedosa arma para propagar la desinformación y debilitar la confianza en la prensa.

Entender cómo cubrir mejor la IA e incorporarla a las prácticas de reportaje y edición fueron los principios que motivaron la Carta de París sobre IA y Periodismo, de la que GIJN fue socia hace dos años. La comisión de la carta, que incluyó a 32 personas destacadas de 20 países, se propuso definir los 10 principios clave para resguardar la integridad de la información y preservar el papel social del periodismo.

“Si bien la IA ha aportado nuevas y emocionantes oportunidades a las cajas de herramientas de los periodistas de investigación, también conlleva varios retos,” dijo la directora ejecutiva de GIJN, Emilia Díaz-Struck, durante el lanzamiento de la carta. “GIJN está honrada de unirse a la conversación sobre cómo la IA puede ayudar al periodismo de investigación, y cómo nuestra comunidad puede superar algunos de los retos de la IA, mientras se hacen reportajes que exploran sistemas rotos y hacen rendición de cuentas a los poderosos”.

Dos años más tarde, durante el más reciente Día Mundial de la Libertad de Prensa, las Naciones Unidas también enfatizaron en su informe, “Reporteando en un Mundo Nuevo y Valiente: El impacto de la inteligencia artificial en la libertad de prensa y los medios”, la necesidad de comprender el impacto de la IA.

“La IA está transformando el derecho fundamental de buscar, impartir y recibir información, así como la profesión del periodismo”, dijo el informe en su resumen ejecutivo. “Mejora el acceso a la información y su procesamiento, permitiendo que los periodistas manipulen y procesen vastas cantidades de datos con más eficiencia y creen contenido con más efectividad”.

“También presenta riesgos. Puede ser usada para reproducir y propagar desinformación, amplificar discursos de odio en línea y facilitar nuevas formas de censura”, advirtió el informe. “Algunos actores usan la IA para la vigilancia masiva de periodistas y ciudadanos, creando un efecto de opresión sobre la libertad de expresión. Las plataformas privadas cada vez usan con más frecuencia la IA para filtrar, moderar y curar el contenido, convirtiéndose en guardianes de la información”.

Otra preocupación más directa sobre el impacto de la IA en la libertad de prensa y el periodismo está relacionada con el aspecto de la tecnología que se presenta como una forma de impulsar la productividad, mientras se recorta la planta editorial. Al tiempo que la industria de noticias sufre por profundas dificultades financieras y reducciones de personal, reemplazar a los reporteros y editores reales con IA podría acelerar la pérdida de empleos entre periodistas. En un ejemplo extremo y reciente, el portal Quartz despidió a casi toda su planta editorial, luego de ser adquirida por un nuevo dueño. Esta maniobra se interpretó como el portal queriendo apostar a incorporar una estrategia de contenido generado por IA. Justo el año pasado, el periódico italiano Il Foglio dijo que iba a publicar, como un experimento, el primer periódico completamente generado por IA, incluyendo la escritura de historias, titulares e incluso citas (de personas inexistentes).

Sin embargo, el periodismo de investigación sigue siendo un antídoto al huracán de manipulación y desinformación de la IA. Los reportajes que exigen pesquisas sistemáticas, con múltiples fuentes, análisis de datos y verificación de hechos, simplemente no pueden ser replicados por el aprendizaje electrónico o una supercomputadora. El periodismo de denuncia ofrece a los lectores un servicio vital que no pueden encontrar en ningún otro lugar. Por ello es crucial proteger la independencia de los periodistas para exponer las malas prácticas y hacer rendición de cuentas a los poderosos.

“Los miembros de nuestra comunidad han revelado historias sobre desinformación, estafas y abusos de derechos humanos con la ayuda de la IA”, dijo Díaz-Struck, de GIJN, en el más reciente Día Mundial de la Libertad de Prensa. “Al mismo tiempo, como herramienta, ha ofrecido nuevas posibilidades para que los periodistas de investigación revisen millones de registros e identifiquen pistas clave que han sido valiosas en el proceso de hacer el reportaje. La IA sigue evolucionando y tenemos que hacerle rendir cuentas, mientras comprendemos sus posibilidades y limitaciones”.

Exponer las amenazas de la IA para la democracia

Aunque la IA todavía tiene problemas simulando incluso los aspectos más básicos de escribir una noticia, el aumento del contenido generado por algoritmos aún puede tener un efecto negativo sobre el periodismo y la sociedad civil. Enturbiar las aguas y dificultar que el público pueda saber qué fuentes son fiables reduce la confianza sobre la prensa en general. Como informó el Instituto Reuters en noviembre pasado, los reportajes de periodistas profesionales pueden perderse en la masa de portales que tienen optimización en motores de búsqueda e información de mala calidad generada por IA. Por ejemplo, en la antesala de las elecciones de 2024 en Estados Unidos, NewsGuard identificó unos 1.200 portales de “limo rosa” (“pink slime”), un término para referirse al contenido que posa como periodismo riguroso, pero es en realidad una plataforma para promover narrativas sesgadas, posiciones u organizaciones políticas, y deslegitimar al periodismo legítimo. Dichos portales usan historias generadas por IA para imitar periódicos o canales de televisión locales en los que el público tradicionalmente ha confiado.

“La IA generative facilita la creación de contenido engañoso, como ultrafalsos (deepfakes), que debilitan la confianza en las instituciones democráticas”, dijo el informe de la ONU.

GIJN profundizó el año pasado en esta amenaza como parte de su proyecto Elecciones 2024, que se desarrolló durante un año. Una historia clave en esta serie pretendía educar a los periodistas alrededor del mundo en cómo identificar e investigar contenido de audio ultrafalso generado por IA, luego de propagarse para engañar y manipular a los votantes en países como Pakistán y Bangladesh, y supuestamente favorecer al partido pro-ruso en Eslovaquia. En el 2024, otros portales de noticias también monitoreaban la manipulación de la IA en elecciones alrededor del mundo, y encontraron casos en México, Indonesia y otros países asiáticos.

Una investigación del Financial Times publicada el año pasado también halló que las herramientas de clonación de voz generada por IA se habían empleado en las primarias presidenciales Demócratas del 2024 (para simular falsamente que el entonces presidente Joe Biden le pedía a la gente no votar), y en las elecciones de 2023 en Sudán, Etiopía, Nigeria e India.

Hera Rizwan, a reporter for India’s Decode, has published several stories exposing how AI can be used to sow confusion in the country’s electorate. This, as India’s press situation has fallen into an “unofficial state of emergency” in recent years, according to RSF.

Hera Rizwan, reportera del medio Decode, de India, ha publicado varias historias revelando cómo la IA puede usarse para sembrar confusión en el electorado de un país. Esto al tiempo que la situación de la prensa en India ha caído en un “estado no oficial de emergencia” durante los últimos años, según RSF.

“La IA definitivamente está dándole una nueva forma al ecosistema en el que operamos”, le dijo Rizwan a GIJN. “Lo preocupante es que está poniendo mucho poder en las manos de las grandes plataformas de tecnología y los gobiernos — que no son exactamente campeones de la libertad de prensa. Estamos viendo cómo la IA se usa en herramientas de vigilancia, como el reconocimiento facial y la vigilancia predictiva. En los países donde la ley no hace mucho para proteger a los periodistas y los ciudadanos, este tipo de tecnología puede ser profundamente intimidante. Lleva a que la gente tenga miedo de hablar o de participar en protestas, y el temor también se extiende hacia la prensa”.

Además de las elecciones, la IA se usa como un arma para manipular a la opinión pública en torno a la guerra en Ucrania. En un cubrimiento de The Insider, la periodista Dana Lyndell trabajó en una serie de investigaciones sobre la llamada campaña de desinformación Matrioska, que creó imágenes IA para presentar a los líderes de Ucrania como débiles y sanguinarios, mientras fomentaba que los ucranianos se rindieran a Rusia.

El portal en ruso de The Insider descubrió una campaña de propaganda en línea que usaba imágenes falsas generadas por IA para promover mensajes pro-Kremlin entre los ucranianos. Imagen: Toma de pantalla, The Insider

Profundizar en los algoritmos y sus consecuencias

Comprender la implementación más profunda y sistémica de la IA, y hacer responsables de su impacto a quienes la emplean, también es un camino investigativo clave para los periodistas.

Iniciativas como la Red de Rendición de Cuentas IA del Pulitzer Center buscan “atender el desequilibrio que existe en torno a la inteligencia artificial en la industria del periodismo y crear un ecosistema multidisciplinario y colaborativo que les permita a los periodistas informar con destreza, matices e impacto sobre este tema que evoluciona tan rápido”.

Un ejemplo reciente de su trabajo fue una colaboración entre Estados Unidos y Brasil hecha por Núcleo, que descubrió perfiles de usuarios de Instagram que promovían un contenido con obvio abuso infantil generado por IA, mientras los protocolos de seguridad de la compañía matriz Meta habían fracasado en su papel de detenerlos. Sin embargo, a los pocos días de la publicación y como respuesta a las revelaciones, Meta eliminó los 14 perfiles.

Al Jazeera hizo parte de la misma iniciativa del Pulitzer Center, y halló que a miles de personas en condición de pobreza en India se les había negado comida, y miles más habían sido declaradas muertas por equivocación, a causa de errores cometidos por un algoritmo de IA empleado por el sistema de seguridad social del país.

Estas revelaciones surgieron luego de hallazgos similares hechos por la organización periodística de los Países Bajos, Lighthouse Reports, un año atrás. Como parte de una colaboración con el Pulitzer Center, Wired y varios medios más, Lighthouse Reports profundizó en los sesgos algorítmicos implantados en el software de detección de fraude empleado por el sistema de seguridad social de los Países Bajos. La investigación Máquinas de Sospecha (Suspicion Machines), indagó en los aportes y elecciones de diseño del sistema de medición de riesgo, y halló que los modelos de aprendizaje automáticos discriminaban de forma rutinaria a los beneficiarios de seguridad social con base en su etnia, edad, género y estado parental.

Al aceptar el premio inaugural del Access to Info Impact Award el año pasado, el periodista de Lighthouse Reports, Gabriel Geiger, explicó que la libertad de prensa y la transparencia fueron claves para poder investigar plenamente el algoritmo. “Esto quiere decir idear e implementar una campaña de libertad de información a gran escala en países europeos con regímenes de acceso a la información muy distintos”, dijo. “Las agencias gubernamentales nos resistieron en todo momento. Colaborando con periodistas de cada país fuimos a los tribunales, presentamos quejas con las defensorías públicas y esperamos más de un año para obtener el acceso necesario”.

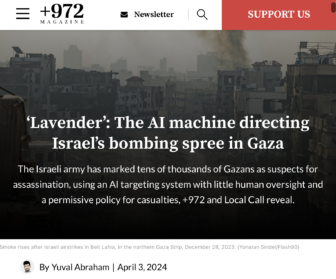

Un ejemplo modelo de investigación de algoritmos IA se publicó el año pasado como parte de una colaboración entre los medios independientes israelíes +972 y Local Call. Juntos, revelaron cómo las Fuerzas de Defensa de Israel (FDI) usaban “Lavender”, un programa de IA, para dirigir los bombardeos dentro de Gaza. El programa tenía poca supervisión y llevaba a una alta proporción de muertes de civiles, a causa de su preferencia por tener como objetivos a hogares privados durante la noche.

En una publicación sobre la metodología que le siguió a la revelación inicial, el periodista de +972, Yuval Abraham, explicó cómo él y su equipo habían entrevistado a seis informantes como parte del reportaje, un recordatorio de que un elemento clave al cubrir la implementación de la IA es comprender a los humanos que empoderan la tecnología. Abraham descubrió que, desde los días iniciales de la guerra tras el ataque de Hamás del 7 de octubre, las FDI comenzaron a delegar las decisiones de vida o muerte al modelo IA para definir objetivos.

“Según las fuentes, el ejército le dio una aprobación amplia a sus soldados para que adoptaran con muy poca supervisión las listas de Lavender de a quién debían matar, y que interpretaran los resultados de la máquina ‘como si fueran decisiones humanas’”, dijo Abraham. “Mientras la máquina estaba diseñada para marcar operativos militares de ‘bajo nivel’, se sabía que en aproximadamente el 10% de los casos cometía lo que se consideraban ‘errores’ de identificación”.

Usar la IA como una poderosa herramienta en las salas de redacción

A pesar de estas preocupaciones sobre el rol de la IA en el ecosistema de medios y la sociedad civil, ésta aún puede jugar un papel positivo en el periodismo actual. De hecho, muchos periodistas de investigación han adoptado los grandes modelos de lenguaje de la IA para multiplicar el poder de sus salas de redacción. Cuando se despliegan de forma adecuada y con los controles editoriales correctos, las herramientas de IA pueden ser particularmente útiles para los medios pequeños, independientes y sin ánimo de lucro, que no tienen los recursos financieros y el personal de los grandes medios.

Como mínimo, los periodistas pueden usar grandes modelos de lenguaje, como ChatGPT, para hacer más eficientes sus etapas tempranas de los reportajes y buscar líneas desde las cuales aproximarse a los temas. “ChatGPT te da una lista de expertos a quienes puedes recurrir y sus números telefónicos en cinco segundos, lo que te ahorra invertir 40 minutos a hacer búsquedas en Google”, dijo a GIJN el año pasado Jermey Jojola, periodista de investigación de KUSA-TV.

Sin embargo, los periodistas de investigación que tengan conocimientos técnicos más avanzados pueden ampliar el alcance de la asistencia de la IA. Esto les dará más tiempo y recursos para enfocarse en la reportería de alto nivel y en la escritura. GIJN habló con varias personas que se graduaron de nuestro curso de entrenamiento Amenazas Digitales (Digital Threats), para tener perspectivas sobre cómo empleaban la IA en sus salas de redacción.

“He estado desarrollando proyectos de fuente abierta que usan la inteligencia artificial para apoyar el periodismo de investigación”, dijo a GIJN Reinaldo Chaves, de Abraji. Chaves ha creado varias herramientas de IA innovadoras y las publicó en su página de GitHub. “Estas herramientas están diseñadas para hacer más eficiente el flujo de trabajo de mi equipo —por ejemplo, al investigar la desinformación, analizar documentos y revisar casos legales con chatbots personalizados (indicaciones/prompts, configuración y contexto para periodismo)—, y para servirle a la comunidad más amplia de periodistas mediante apps y repositorios públicos”.

Ibrahim Helel usó la IA para buscar entre un caudal de publicaciones en línea hechas por cuentas falsas, durante una campaña en redes sociales luego de la muerte de Hasán Nasralá, el líder de Hezbolá, para encontrar su origen verdadero: Arabia Saudita e Irán. “Usé modelos de IA para analizar miles de publicaciones en X (anteriormente Twitter). Estas herramientas me ayudaron a detectar el comportamiento de bots, al identificar patrones en tiempos, repetición y actividad de red”, le dijo Helal a GIJN. “También usé procesadores de lenguaje natural para reunir grupos de cuentas basados en cómo escriben y participan, lo cual reveló grupos de cuentas comerciales probablemente contratadas para amplificar contenido”.

Otros, como Balkrishna, de India Today, ven posibilidades en la habilidad de la IA para buscar en grandes bases de datos o archivos, y apoyar el periodismo de datos. “Nuestro equipo ha usado regularmente varias herramientas de IA en sus reportajes”, dijo a GIJN. Algunas de ellas son: Notebook LM para analizar grandes documentos e identificar patrones en ellos; ChatGPT para extracción, limpieza y organización de datos; Gemini para geolocalización, mapas y extraer de una hoja de datos coordenadas de ubicación; herramientas de IA para analizar ultrafalsos y medios manipulados; y Napkin AI para las visualizaciones”. Balkrishna no sólo usa la IA como una herramienta de reportaje, sino también de investigación. En enero, coescribió una historia que descubrió un sesgo latente a favor de China en el nuevo chatbot de la IA DeepSeek.

Christopher Newton, de InSight Crime, hace poco investigó cuatro formas en que los grupos criminales de América Laina han comenzado a aprovechar la IA — y tiene planes de indagar incluso más en el impacto de esta tecnología en la corrupción y el crimen organizado de la región. Entretanto, su sala de redacción aprende sobre sus lectores y mejora su contenido gracias a la IA.

“Usamos IA en nuestro sistema de monitoreo de noticias para tratar de ranquear los artículos con base en su relevancia y marcarlos para que sea más fácil encontrar información en nuestra base de datos interna”, dijo Newton a GIJN. También usan la IA para “apoyar la escritura de código, para que sea más eficiente, y nos ayude a encontrar errores cuando hacemos nuestras propias herramientas y gráficas. Empleamos la IA para transcripciones, traducciones y edición de borradores, con una supervisión/revisión humana”.

Como una señal de lo que está por venir, la IA es una herramienta en las salas de redacción de InSight Crime para lograr varios objetivos, y también investiga el uso de la tecnología por parte del crimen organizado en América Latina. Imagen: Toma de pantalla, InSight Crime

ICIJ y OCCRP, ambos miembros de GIJN, también han incluido componentes de la IA en Datashare y Aleph, que ambas organizaciones, respectivamente, desarrollaron internamente. Con ellas han logrado minar millones de registros y han fortalecido, mediante colaboraciones transfronterizas, el trabajo de periodistas en todo el mundo.

Es una señal de lo que está por venir para la industria periodística: la tecnología de la IA puede, en distintos momentos, emplearse para y contra la libertad de prensa. Dependerá de los periodistas, en especial los de investigación, asegurarse de trabajar juntos para que esta poderosa herramienta tienda hacia la rendición de cuentas y la independencia, mientras se aleja de la opresión y la propaganda.

Como concluyó el informe de la ONU: “La cooperación entre los actores más influyentes es esencial para desarrollar herramientas impulsadas por la IA que fortalezcan la integridad de la información, detecten y mitiguen la desinformación, y fomenten ecosistemas digitales seguros y basados en los derechos humanos”.

Reed Richardson está radicado en Estados Unidos. Tiene una maestría en periodismo de la Escuela de Posgrado de la Universidad de Columbia, en Nueva York, y cuenta con más de 15 años de experiencia en medios digitales. Antes de unirse a GIJN, trabajó como cronista y crítico de medios freelance en The Nation, FAIR Media Watch y Mediaite.

Reed Richardson está radicado en Estados Unidos. Tiene una maestría en periodismo de la Escuela de Posgrado de la Universidad de Columbia, en Nueva York, y cuenta con más de 15 años de experiencia en medios digitales. Antes de unirse a GIJN, trabajó como cronista y crítico de medios freelance en The Nation, FAIR Media Watch y Mediaite.

Andrea Arzaba es la editora de GIJN en español y directora del proyecto Amenazas Digitales (Digital Threats) de la organización. Tiene maestría en Estudios Latinoamericanos por la Universidad de Georgetown, en Washington D.C., y es licenciada en Comunicación y Periodismo por la Universidad Iberoamericana de la Ciudad de México. Sus trabajos han sido publicados en Palabra, Revista Proceso, National Geographic Traveler, Animal Político y 100 Reporters, entre otros medios.

Andrea Arzaba es la editora de GIJN en español y directora del proyecto Amenazas Digitales (Digital Threats) de la organización. Tiene maestría en Estudios Latinoamericanos por la Universidad de Georgetown, en Washington D.C., y es licenciada en Comunicación y Periodismo por la Universidad Iberoamericana de la Ciudad de México. Sus trabajos han sido publicados en Palabra, Revista Proceso, National Geographic Traveler, Animal Político y 100 Reporters, entre otros medios.