Ilustración: Nodjadong Boonprasert

Guía para periodistas sobre cómo detectar contenido generado por IA

Estamos llegando al punto en el que el ritmo de la desinformación casi es igual al de la información factual, y es casi imposible discernir qué es real. Esta guía busca enseñar a los periodistas cómo identificar contenido generado por IA mientras están bajo la presión de una entrega, y ofrece siete categorías de detección avanzada que todo reportero debe dominar.

Hablando como alguien que apoya a las redacciones en su lucha contra la desinformación, esto es lo que me preocupa: la verificación de datos tradicional tarda horas o días, mientras la desinformación generada por IA tarda minutos.

La desinformación en video comenzó décadas antes que la tecnología moderna de IA. Incluso a pesar de las limitaciones técnicas de los primeros equipos de grabación, se podían crear representaciones devastadoramente falsas. En 2003, la niñera Claudia Muro pasó 29 meses en prisión porque una cámara de seguridad con una baja velocidad de fotogramas hizo que los movimientos cariñosos parecieran violentos, y a nadie se le ocurrió verificar la grabación. En enero de 2025, la profesora británica Cheryl Bennet debió asumir la clandestinidad luego de que en un video ultrafalso apareciera haciendo comentarios racistas.

La imagen generada por IA, que mostraba al Papa Francisco I vistiendo una chaqueta acolchada Balenciaga. Imagen: Midjournery, Pablo Xavier

Esta imagen viral del Papa Francisco I con una chaqueta acolchada Balenciaga blanca engañó a millones de personas en redes sociales, antes de que se revelara que fue hecha por IA con un prompt de texto a imagen de Midjourney. Algunas pistas claves para detectarla fueron el crucifijo que colgaba sobre su pecho, que estaba inexplicablemente sostenido sobre el aire, y que allí donde debía estar la otra mitad de la cadena sólo estaba la chaqueta. El creador de la imagen, Pablo Xavier, le dijo a BuzzFeed News: “Sólo pensé que era divertido ver al Papa en una chaqueta graciosa”.

En ocasiones el contenido falso más efectivo ni siquiera necesita de IA. En mayo de 2019, un video de la vocera de la Cámara de Representantes de Estados Unidos, Nancy Pelosi, fue desacelerado a una velocidad de 75% y se alteró el timbre de su voz, para hacerla parecer intoxicada. En noviembre de 2018, la Casa Blanca compartió un video acelerado de una interacción del corresponsal de CNN, Jim Acosta, con un practicante de la Casa Blanca, haciendo que su brazo pareciera más agresivo de lo que en realidad fue.

Hace poco creé un escándalo político inexistente, que incluía presentadores de televisión, ciudadanos enfurecidos, grabaciones de protestas y hasta un alcalde ficticio, en tan sólo 28 minutos, durante mi hora de almuerzo. Fue una crisis política completamente fabricada que pudo haber engañado a editores atareados y presionados por cumplir con una entrega.

Hace poco, observaba a un verificador de datos veterano declarar confiado que una cierta imagen era real y no generada por IA, porque la mano tenía cinco dedos en lugar de seis. Hoy esa solución es prácticamente obsoleta.

Esta es la cruda realidad de detectar la IA: los métodos que nos hacen sentir seguros se están evaporando ante nuestros ojos. Antes, las manos mal representadas, como dedos extra o fusionados, eran una táctica común para identificar imágenes generadas por IA. Contenidos falsos virales, como el “arresto de Trump” de 2023, en parte lograban revelarse por estos obvios errores con las manos. Sin embargo, en 2025, los grandes modelos de IA como Midjourney y DALL-E han mejorado significativamente al representar manos de forma anatómicamente correcta. Por ello, las manos ya no son una manera confiable de detectar imágenes creadas por IA, y quienes desean reconocer el arte creado por IA deben recurrir a otras pistas más sutiles.

La revolución en la presentación de textos sucedió incluso más rápido. Si bien antes los letreros de protesta de la IA presentaban mensajes confusos, como “STTPO THE MADNESSS” y “FREEE PALESTIME”, algunos de los actuales modelos producen una tipografía perfecta. OpenAI entrenó específicamente a DALL-E 3 en la precisión textual, mientras Midjourney V6 añadió “texto preciso” como una característica a la venta. Lo que antes era un método confiable de detección ahora escasamente funciona.

Cada vez son más inusuales las orejas desalineadas, los ojos anormalmente simétricos y los dientes pintados que antes caracterizaban a los rostros de la IA. Las imágenes de retratos generadas en enero de 2023 todo el tiempo arrojaban errores detectables. Los mismos prompts hoy producen rostros realistas.

Esto implica un cambio fundamental para las redacciones. Un periodista entrenado en métodos de detección en 2023 podría decir que es real un contenido que obviamente es IA porque supera pruebas obsoletas. Esta certeza errada es más peligrosa que la duda honesta.

Presentamos a Image Whisperer

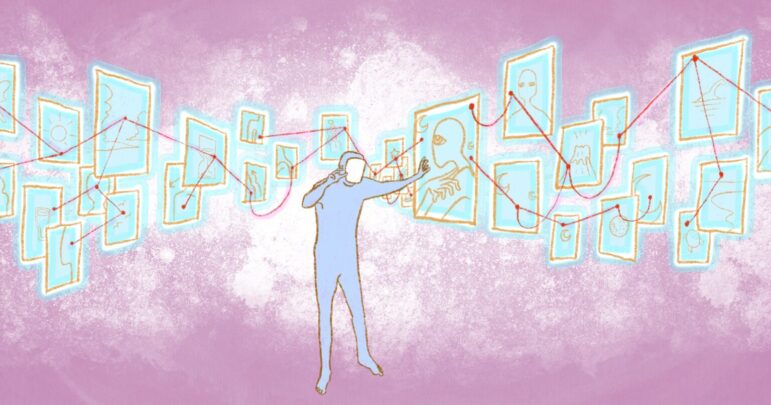

Análisis de una imagen generada por IA que pretende mostrar a una niña rescatada, luego de una inundación en Estados Unidos. Imagen: Henk van Ess

Comencé a preguntarme si podría construir un asistente de verificación para contenido IA, como parte de un contenido extra para este mismo artículo. Los científicos me llevaron a un profundo territorio de la física que nunca esperaba visitar: las transformadas de Fourier, las mecánicas cuánticas de las redes neuronales, los registros matemáticos invisibles al ojo humano. Un físico explicó cómo los artefactos de la IA no son sólo errores visuales, sino huellas digitales de dominios de frecuencia.

Pero luego llegó mi golpe con la realidad: “no construyas una herramienta tú mismo”, me advirtió un experto, “pues necesitarás una potencia masiva de procesamiento y equipos con un nivel de doctorado. Sin esa infraestructura fracasarás”.

Entonces me golpeó de frente la idea: ¿por qué no enfrentar a la IA con IA, pero de una forma diferente? En lugar de crear sistemas multimillonarios de detección, entrenaría a la infraestructura existente de IA para hacer el trabajo más pesado.

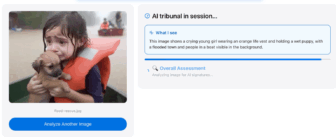

Análisis de una imagen generada por IA, que supuestamente muestra al presidente de Bielorusia sosteniendo un cono con papas fritas. Imagen: Henk van Ess

Image Whisperer (inicialmente llamado Detectai.live) nació de esta aproximación. La herramienta realiza varios análisis con grandes modelos de lenguaje, junto con un procesamiento hecho con Google Vision y aplicando los principios de la física que los expertos me enseñaron, mientras se utiliza el poder de procesamiento ya disponible. Lo más importante es que a diferencia de muchas herramientas de IA, te dice si no sabe algo en lugar de adivinar.

No trata de ser el mejor sistema que existe, sino el más honesto.

Siete categorías de detección de IA

Aún prosigue la carrera armamentista entre los creadores y detectores de IA, y los creadores actualmente se benefician de la ventaja que les proporciona su velocidad. Identificar qué es o no un ultrafalso se ha vuelto un juego del gato y el ratón con los desarrolladores que mejoran la tecnología. Reconocer ultrafalsos con éxito implica mezclar varios métodos de detección, mantener una vigilancia constante y aceptar que la detección perfecta puede ser imposible. Para los periodistas que buscan respuestas precisas, el objetivo ha cambiado de ser una identificación definitiva a una evaluación de probabilidad y un juicio editorial informado.

Pero el periodismo siempre se ha adaptado a una tecnología cambiante. Hemos aprendido a verificar fuentes cuando antes cualquier persona tenía las herramientas para crear una página web. Hemos desarrollado protocolos de verificación de redes sociales cuando todos se convirtieron en potenciales reporteros. Ahora debemos desarrollar estándares para una era en la que cualquier persona puede crear evidencia audiovisual convincente.

Categoría 1: Fracasos anatómicos y de objetos, cuando lo perfecto es lo revelador

View this post on Instagram

Revisión de banderas rojas en 30 segundos (noticias de última hora): Cuando el tiempo apremia y debes hacer una evaluación instantánea de algo con una perfección sospechosa, enfócate en el instinto de que algo “demasiado bueno para ser cierto”. Busca cuando una estética que alcanza la calidad de una revista se halla en contextos en los que ese nivel de aseo sería imposible o inapropiado. El líder de una protesta podría tener maquillaje perfecto, la víctima de un desastre podría tener un cabello impecable, y una cándida escena política en la que todos se ven profesionalmente arreglados debería generar una sospecha inmediata.

- Revisión de instinto por perfección — ¿Se ve esta persona demasiado arreglada/perfecta para la situación?

- Escanear descuadres de contexto — ¿En una escena de crisis/conflicto, hay un nivel de belleza similar al de una revista?

- Revisión de realidad en la piel — Una suavidad alcanzada con aerógrafo donde debería haber una textura natural.

- Una evaluación general de aseo — ¿Acaso la apariencia coincide con la escena?

Verificación técnica en cinco minutos (historias estándar): Esta revisión más profunda se enfoca en los detalles técnicos que revelan la generación artificial. La IA actual crea imágenes anatómicamente correctas, pero a menudo exhiben una perfección antinatural, que no está presente en la fotografía real. Los rostros reales tienen asimetrías sutiles, patrones naturales de desgaste y efectos ambientales que a la IA le resulta difícil replicar de manera auténtica.

- Amplía la imagen al 100% sobre los rostros — Busca textura natural de piel, poros y asimetrías menores.

- Evaluación física de las vestimentas — ¿Hay arrugas naturales, textura de los materiales y patrones de desgaste?

- Análisis de los cabellos individuales — ¿Son visibles los cabellos individuales, en lugar de haber una apariencia pintada/renderizada?

- Realismo de la joyería/accesorios — La apariencia tridimensional en lugar de la apariencia bidimensional de las gráficas de computadora.

- Evaluación de la dentadura — ¿Hay imperfecciones en lugar de perfección uniforme?

- Evaluación general de la perfección — Revisa si el nivel de aseo se ajusta al supuesto contexto y lugar.

Investigación profunda (reportajes de alto riesgo): Para las historias en las que es indispensable la precisión, este análisis comprehensivo se aproxima a la imagen como si fuera evidencia que amerita un escrutinio forense. El objetivo es elaborar una evaluación de probabilidad basada en varios puntos de verificación. Si bien puede ser imposible tener una prueba definitiva, se puede llegar a un juicio informado.

- Análisis comparativo — Encuentra otras fotografías de la misma persona y compara los niveles de naturalidad con la perfección artificial.

- Ampliación técnica — Utiliza herramientas profesionales para examinar la textura de la piel al nivel de pixeles y busca patrones matemáticos.

- Verificación de contexto — Investiga y compara con otras imágenes para determinar si la persona típicamente aparece así de limpia en contextos similares.

- Consulta profesional — Contacta a expertos digitales forenses, como Farid Hany, para obtener un análisis avanzado.

- Verificación desde varios ángulos — Busca fotos/videos del mismo evento para verificar la consistencia.

- Comparación histórica — Compara fotos verificadas de la misma persona en un periodo o contexto similar.

Categoría 2: Violaciones geométricas de la física — Cuando la IA ignora las leyes naturales

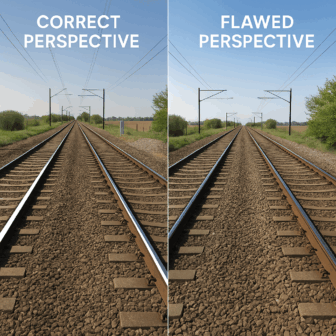

La imagen generada por IA de ferrocarriles desapareciendo en la distancia, junto a la imagen de la vida real con la perspectiva correcta: Henk van Ess

La narrativa: La IA reúne imágenes como un artista de collage, no como un fotógrafo. Entiende los elementos visuales, pero no las reglas geométricas y físicas que gobiernan cómo la luz, la perspectiva y las sombras de hecho operan en el mundo real. Estos fallos fundamentales de la física le resultan a la IA más difíciles de resolver, pues requieren una comprensión del espacio 3D y del comportamiento de la luz.

Los problemas de la física del mundo real en las imágenes de IA: Aunque aún estamos en la etapa temprana de la IA generativa, las imágenes generadas por la IA actual corrigen la perspectiva de las sombras y los reflejos. Un típico ejemplo generado usando DALL-E 2, de OpenAI, muestra sombras inconsistentes y reflejos ausentes o equivocados, y sombras en los reflejos que están orientadas en la dirección incorrecta.

Análisis de punto de fuga: Los edificios reales siguen las leyes de la perspectiva. Las líneas paralelas convergen en un único punto en el horizonte. La IA a menudo crea edificios en los que las líneas del tejado apuntan a la izquierda, mientras las líneas de las ventanas apuntan a la derecha, lo cual es una imposibilidad geométrica que revela la construcción algorítmica en lugar de una captura fotográfica. Los puntos de fuga son fundamentales para capturar la esencia de la perspectiva en las imágenes reales, y las imágenes generadas a menudo tienen inconsistencias con el punto de fuga correcto, porque las líneas no se encuentran.

Verificar la consistencia de las sombras: Cuando hay luz, hay sombras. La relación entre un objeto, su sombra y la fuente de luz es geométricamente simple, y sin embargo en una imagen manipulada o sintetizada, es engañosamente difícil de lograr. En escenas con una sola fuente de iluminación (como la luz solar), todas las sombras deben apuntar en la dirección opuesta a esa fuente. La IA a menudo muestra personas proyectando sombras en múltiples direcciones a pesar de haber un sol, lo cual viola las leyes básicas de la física.

La validación de la investigación: La investigación académica ha confirmado estas fallas geométricas. Los estudios basados en un análisis con GradCam, en imágenes en exteriores, revelan direcciones variadas en la sombra de vehículos y distorsiones estructurales cerca de los puntos de fuga; mientras las escenas en interiores muestran desajustes en la relación objeto-sombra y líneas desalineadas en la geometría de una habitación.

Este tipo de detección sutil no es para los débiles. Acostúmbrate a la idea de estar observando líneas durante una gran cantidad de tiempo.

Revisión de banderas rojas en 30 segundos:

- Encuentra cualquier fotografía con rieles de tren rectos (busca “perspectiva de rieles de ferrocarril” en Google).

- Abre MS Paint o cualquier editor básico de imágenes.

- Usa la herramienta de línea para colocarla a lo largo de ambos rieles, extendiéndolos hacia el horizonte.

- Revísalas para confirmar que convergen en un solo punto, pues esto es lo que DEBERÍA suceder.

Ahora tienes el modelo visual de cómo es una perspectiva correcta.

Verificación técnica en cinco minutos (historias estándar):

Prueba de perspectiva:

- Elige un edificio en la imagen.

- Utiliza cualquier editor de imagen para dibujar una línea que extienda el borde del tejado y las filas de ventanas.

- Revisa que las líneas del mismo edificio convergen en un único punto.

- Varios puntos de fuga para una sola estructura revelan un error de ensamblaje de la IA.

Análisis de sombras:

- Identifica la fuente de luz primaria (los realces más brillantes).

- Traza líneas desde la fuente de luz a la parte superior de los objetos y hasta el fin de la sombra.

- Verifica que todas las sombras apunten en la misma dirección.

- Las sombras en direcciones diferentes revelan una violación de las leyes de la física.

Investigación profunda (reportajes de alto riesgo):

Verificación de reflejo: Cuando los objetos están en la superficie de un plano, las líneas que conectan un punto en el objeto con el correspondiente punto en el reflejo deberían converger en un mismo punto de fuga.

- Encuentra superficies reflectivas en la imagen (agua, vidrio, espejos).

- Traza líneas conectando los objetos a sus reflejos.

- Revisa si las líneas se encuentran con la superficie reflectiva en ángulos rectos.

- Los reflejos en posiciones imposibles revelan un error geométrico.

Categoría 3: Huellas digitales técnicas y análisis de pixeles — El ADN matemático

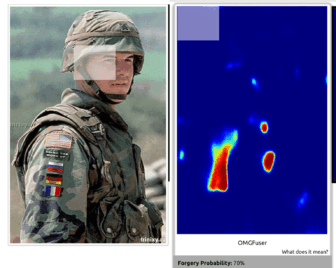

Una fotografía viral, digitalmente alterada, de un soldado estadounidense en 2004. El parche dice “DOING THE WORK OF”, junto con las banderas de Rusia, Alemania y Francia han sido añadidas a la imagen. La herramienta muestra la posible zona de alteración y cómo pudo haber sido alterada. Imagen: Henk van Ess

La narrativa: Cuando la IA crea una imagen, deja atrás pistas ocultas en el archivo. Una firma matemática, que es como huellas digitales invisibles que pueden ser detectadas por herramientas especiales. Estas pistas se encuentran en la forma como los pixeles están dispuestos y en cómo se comprime el archivo. Imagínalo como pistas de ADN que demuestran que algo fue hecho por IA, en lugar de capturado por una cámara real.

Detección del patrón de ruido: Las cámaras reales capturan imágenes con imperfecciones naturales y desordenadas, como diminutos puntos aleatorios desde el sensor de la cámara. Las imágenes generadas por IA tienen en cambio patrones perfectos que no son naturales. Cuando los expertos analizan estos patrones con programas especiales, ven formas de estrella distintas que no saldrían en una fotografía real. Es como la diferencia entre la estática realmente aleatoria de un televisor viejo, comparado con una computadora que intenta recrear la aleatoriedad: la versión falsa tiene un orden oculto que la delata, si tienes las herramientas adecuadas.

Detección copiar-pegar: Cuando la IA o los humanos duplican regiones de imagen, crean correlaciones de pixeles inusuales. Áreas distintas se vuelven sospechosamente similares, más allá de la redundancia espacial natural, creando patrones detectables o firmas matemáticas.

Análisis de compresión de artefacto: El contenido generado por IA a menudo muestra patrones de compresión que no son naturales y que difieren de los crudos archivos que se originan de una cámara. Esto revela orígenes algorítmicos en lugar de ópticos.

Herramientas de detección profesionales: La tecnología de TrueMedia.org tiene la capacidad de analizar productos mediáticos sospechosos e identificar ultrafalsos en audio, imágenes y videos. Algunos ejemplos de ultrafalsos detectados recientemente por TrueMedia.org son la supuesta fotografía de arresto de Donald Trump y una supuesta foto del presidente Biden con altos oficiales militares.

Revisión de banderas rojas en 30 segundos: Antes de analizar imágenes sospechosas, practica en productos mediáticos que sean a prueba de principiantes:

- Sube tu fotografía al Image Verification Assistant.

- La tecnología te dará una tasa de Probabilidad de Falsedad.

- Investiga más la imagen cuando la probabilidad de falsedad sea de al menos 70%

Verificación técnica en cinco minutos (historias estándar):

- Revisión de textura visual: Amplía a 100% en zonas como la piel o el cielo y observa de cerca la textura. ¿Tiene las características aleatorias e irregulares de la vida real, o se ve muy liso y matemáticamente perfecto? Las fotos reales tienen un caos natural, mientras la IA a menudo crea patrones que son sospechosamente uniformes.

- Herramienta de detección automatizada: Sube la imagen a TrueMedia.org (un portal gratuito). Esta herramienta corre la imagen a través de detección de IA que analiza aquellas firmas matemáticas ocultas de las que hablamos más atrás. Esto te da una probabilidad en un porcentaje de que la imagen sea generada por IA.

- Revisa la información oculta del archivo: Haz clic derecho sobre el archivo de la imagen y selecciona “Propiedades” (en PC) u “Obtener información” (en Mac). Mira los metadatos. Esto muestra qué programa creó el archivo y cuándo. Las imágenes IA a menudo muestran marcas de tiempo de programas de edición o herramientas de creación que no coinciden con la historia de cuándo/cómo supuestamente se tomó la imagen.

- Análisis de lisura de superficie: Esto es diferente de la revisión rápida de las texturas. Aquí estás mirando imágenes que deberían ser naturalmente imperfectas, como paredes, telas o agua. La IA tiende a limpiar estas superficies, haciéndolas lisas a un nivel que no es natural, mientras una foto real mostraría pequeños baches, variaciones o desgaste.

Cada paso detecta diferentes tipos de error de IA. Considéralo como usar diferentes pruebas para estar más seguro de tu conclusión.

Investigación profunda (reportajes de alto riesgo):

Forensically — Esta es una serie de herramientas gratuitas, integrales de análisis forense de imágenes digitales, con visualización de frecuencia de dominio.

Análisis de frecuencia de dominio — Detección técnica de patrones matemáticos propios de la IA.

Categoría 4: Artefactos de voz y audio — Cuando la voz sintética se traiciona

Análisis de audio ultrafalso (deepfake) de Donald Trump generado por IA. Imagen: YouTube, vía Henk van Ess

La narrativa: La tecnología de clonación de voz puede replicar la voz de cualquier persona a partir de unos segundos de audio, pero deja trazos detectables de generación artificial en patrones de voz, autenticidad emocional y características acústicas. Aunque logran una precisión asombrosa, las voces sintéticas aún tienen dificultades replicando los sutiles elementos humanos de las voces realmente auténticas.

Casos reales de engaño en audio: En marzo de 2019, el director ejecutivo de una firma de energía de Gran Bretaña recibió una llamada de su “jefe”, con un acento alemán perfecto, pidiendo una enorme transferencia de dinero. Tan sólo una segunda llamada sospechosa de un número austriaco reveló la decepción de IA. Más recientemente, el consultor político Steven Kramer pagó 150 dólares para crear una llamada de robot ultrafalsa (deepfake), haciéndose pasar por el presidente de los Estados Unidos, Joe Biden. En ella, solicitaba a la gente no votar en las primarias Demócratas de New Hampshire en 2024.

Velocidad y costo de falsos audios: Según la demanda contra Kramer, tomó menos de 20 minutos crear el ultrafalso (deepfake) y costó sólo un dólar. Kramer le dijo a CBS News que recibió “5 millones de dólares en exposición” por sus esfuerzos.

Banderas rojas en patrones de voz: Lindsay Gorman, que estudia tecnologías emergentes y desinformación, le dijo a NBC News que a menudo los ultrafalsos (deepfakes) tienen características que los revelan: “La cadencia, sobre todo al final, no parece natural, sino robótica. Esta es una de las características que revelan una pieza potencialmente falsa de contenido de audio”.

- Ritmo que no es natural, sin titubeos o respiración normal.

- Pronunciación sin errores, que no tiene las imperfecciones de la voz natural.

- Inflexión robótica en ciertas palabras o frases.

- Ausencia de ruido ambiental de fondo que debería estar presente.

- Frases o terminología que una persona nunca realmente utilizaría.

Un caso anterior de un ultrafalso (deepfake) reveló que la IA decía “libras 35.000”, poniendo el tipo de moneda antes de los números, en un estilo que no es natural y reveló la generación sintética.

Revisión de banderas rojas en 30 segundos:

Échale un vistazo al Hiya Deepfake Voice Detector, un sencillo plugin de Chrome (puedes usarlo hasta 20 veces al mes). Superó la prueba Trump-Biden de video:

Es una extensión de Chrome que analiza audio en tiempo real para determinar si lo que estás escuchando es una voz humana real o algo creado por IA.

Esto es lo que hace:

- Analiza voces en videos y audio que corren en tu navegador Chrome.

- Trabaja instantáneamente, requiriendo sólo un segundo de audio para hacer la determinación.

- Funciona en cualquier portal, como plataformas de redes sociales, portales de noticias y plataformas de video.

- Detecta las voces similares a la humana, creadas por las principales herramientas para sintetizar voz en IA.

- Soporta varios idiomas.

- Corre en tiempo real mientras haces búsquedas.

Una aclaración: Dado que el plugin usa algoritmos de probabilidad, no será 100% acertado en todos los casos.

Verificación técnica en cinco minutos (historias estándar):

- Fíjate en la naturalidad del habla — ¿Hay pausas en su pronunciación y se siente humana?

- Verifica la disponibilidad — ¿Podría esta persona de hecho haber hecho esa afirmación cuando se dice que la hizo?

- Revisa la autenticidad emocional — ¿La emoción está acorde con el contenido y el contexto?

- Llama al número oficial para verificar cualquier solicitud urgente de audios.

- Haz preguntas contextuales que sólo la persona real sabría responder.

Investigación profunda (investigaciones de alto riesgo):

- Descarga el audio completo del fragmento.

- Súbelo a Notta.ai y deja que escriba una transcripción.

- Mientras esperas, alimenta cinco o seis fragmentos de audio verificados de la misma persona, o transcripciones, a Claude.

- Pídele que haga un análisis semántico y categoriza los temas, los patrones de habla, el uso de la gramática, el estilo y el tono de voz.

- Luego sube la transcripción del audio en el que no confías y pídele a Claude que lo compare para identificar anomalías.

Categoría 5: Lógica temporal y contextual — Cuando la IA no captura el panorama general

Imagen generada por IA que pretende mostrar la cobertura de una protesta climática en París. Imagen: Henk van Ess

La narrativa: La IA genera contenido basado en patrones visuales sin el contexto del mundo real, la lógica temporal o lo apropiado en ciertas situaciones. Esto genera contenido que parece convincente de forma aislada, pero se derrumba bajo una revisión sensata.

La decepción del video de la prisión en Irán: Un sofisticado video generado por IA aseguraba mostrar un ataque con misiles israelíes sobre la Prisión Evin de Irán, pero fue generada a partir de una fotografía de 2023. Las pistas claves de detección incluyen incongruencias en las estaciones (hay arbustos sin hojas en una grabación que supuestamente fue hecha en verano), coincidencias perfectas en los detalles que iban en contra de lo que resultaba más probable, y una capacidad imposible para estar en el lugar y el momento correctos.

Revisión de banderas rojas en 30 segundos: La IA crea contenido visualmente convincente, pero no captura las relaciones lógicas entre el momento, el lugar y las circunstancias en los que algo acontece. En escenarios de noticias de última hora, confía en tu conocimiento del mundo para detectar cosas imposibles cuya posterior verificación exigiría un análisis sofisticado.

- Revisar que la representación de la estación/el clima sea verosímil. coincidencia de estación/clima — ¿La vegetación, los atuendos o la iluminación coinciden con la supuesta fecha y lugar?

- Revisión de anacronismos tecnológicos — ¿Hay dispositivos, vehículos o infraestructura que no pertenece a este periodo?

- Revisión de corazonada geográfica —¿Coincide el supuesto lugar con su arquitectura, características y paisaje?

- Evaluación rápida de credibilidad de la fuente — ¿Se alinea el contenido con sus requisitos de acceso y nivel de sofisticación?

Verificación técnica en cinco minutos (historias estándar):

Este análisis más profundo se apoya en tus habilidades investigativas para cruzar las afirmaciones con los hechos verificables. La IA tiene problemas con la naturaleza interconectada de los eventos mundiales, creando contenido que pasa una inspección visual, pero fracasa bajo el escrutinio lógico, una vez se compara con fuentes externas de datos.

- Verificación histórica del clima — Revisa datos archivados sobre el clima para comprobar las condiciones visibles en esa fecha/lugar.

- Cruzar referencias de construcciones sobresalientes — Verifica que los edificios, señales e infraestructura existan en el lugar referenciado.

- Auditoría de elementos culturales — Confirma que los estilos de vestimenta, comportamientos y dinámicas sociales sean acordes con el contexto geográfico/cultural.

- Evaluación de probabilidad en la línea de tiempo — Investiga si los eventos que se pretenden representar podrían acontecer simultáneamente.

- Análisis de patrón de fuentes — Mapea cómo el contenido se propaga con patrones típicos de distribución para eventos similares.

- Busca múltiples ángulos — Busca otras fuentes independientes que hayan documentado el mismo evento.

Investigación profunda (reportaje de alto riesgo): Usa las pistas contextuales como si fueran piezas de un rompecabezas forense. Cada una exige una verificación sistemática contra los hechos comprobados. Esta aproximación construye una matriz de probabilidades basada en varias inconsistencias lógicas, en lugar de puntos de prueba individuales y definitivos.

- Reconstrucción cronológica de la línea de tiempo — Elabora una cronología detallada de los eventos reivindicados y cruza las referencias con todos los elementos visuales.

- Verificación de inteligencia geográfica — Utiliza imágenes satelitales, vista desde las calles (Street View) y la experiencia local para confirmar detalles de ubicación.

- Análisis forense de estaciones/ambiente — Consulta a expertos botánicos, meteorólogos y fuentes locales sobre condiciones ambientales.

- Evaluación de autenticidad cultural — Entrevista a expertos regionales sobre normas de conducta y vestuario, y tradiciones sociales que sean visibles en el contexto.

- Análisis de anacronismos tecnológicos — Verifica que todos los dispositivos visibles, vehículos e infraestructura realmente existían en el tiempo y lugar que la grabación pretende reproducir.

- Investigación de cadena de fuentes — Rastrea la historia completa de distribución y compárala con patrones conocidos de eventos similares auténticos.

- Red de consultores expertos — Contacta a periodistas, académicos y funcionarios locales familiarizados con el lugar o situación que se dice representar.

- Construcción de matriz de probabilidad — Asigna un puntaje a cada elemento lógico y construye una evaluación integral de autenticidad y contexto.

Categoría 6: Reconocimiento de patrón de comportamiento — Cuando la IA se equivoca representando a los humanos

Imagen generada por IA que pretende mostrar manifestantes marchando en las calles de una ciudad. Imagen: Henk van Ess

La narrativa: La IA puede replicar la apariencia humana, pero tiene dificultades con el comportamiento genuinamente humano, las dinámicas sociales y los patrones naturales de interacción. Esto crea inconsistencias detectables en escenas con multitudes, dinámicas grupales y comportamiento individual que observadores entrenados pueden identificar.

Revisión de banderas rojas en 30 segundos (noticias de última hora): La IA crea multitudes que parecen a primera vista realistas, pero que delatan su falsedad mediante patrones de comportamiento que no son naturales. En situaciones de noticias de última hora, enfócate en si las personas de hecho actúan como lo harían humanos reales en circunstancias dadas, en lugar de ser actores digitales siguiendo comportamientos programados.

- Revisión de uniformidad en las multitudes — ¿Hay demasiadas personas con edades, apariencias o atuendos similares?

- Comprobación de atención al patrón — ¿Todos observan en la misma dirección o hacia la cámara, o hay variaciones naturales en la atención?

- Prueba de la autenticidad emocional — ¿Las expresiones faciales están acorde con el ambiente y la intensidad del evento?

- Evaluación del realismo del movimiento — ¿Hay posiciones artificiales, o es acorde con cómo los humanos naturalmente ocupan el espacio y transmiten un lenguaje corporal?

Verificación en cinco minutos (historias estándar): Este análisis se apoya en tu comprensión de las dinámicas sociales para identificar las falencias de la IA en replicar el comportamiento auténtico de un grupo. Las multitudes reales tienen patrones sociales complejos que los datos de entrenamiento de la IA no pueden capturar por completo, creando una uniformidad artificial detectable en reuniones supuestamente espontáneas.

- Auditoría de diversidad demográfica — Cuenta los rangos de edad, estilos de vestimenta y representación étnica frente a la uniformidad artificial.

- Mapeo de interacción social — Identifica conversaciones y relaciones genuinas, frente a posicionamientos recreados.

- Verificación de respuesta ambiental — ¿Reaccionan las personas de forma apropiada al clima, iluminación y niveles de sonido?

- Revisión de comportamientos culturales — ¿Las normas sociales, el espacio personal y los estilos de interacción concuerdan con el ambiente donde se desarrolla la acción?

- Análisis de expresiones individuales — Busca expresiones faciales únicas y emociones genuinas en comparación con respuestas uniformes o genéricas.

- Evaluación de patrones de movimiento — ¿Hay asimetrías naturales y rasgos personales, en comparación con movimientos artificialmente fluidos?

Investigación profunda (reportaje de alto riesgo): Acércate al comportamiento humano como evidencia antropológica que exige un análisis sistemático de patrones sociales. Este enfoque integral examina si la compleja red de interacciones sociales podría ocurrir auténticamente en las circunstancias que se pretende presentar.

- Análisis sociológico de la multitud — Consulta a expertos en psicología de masas para verificar las dinámicas realistas de los grupos para el tipo de evento que se pretende presentar.

- Verificación de autenticidad cultural — Entrevista a especialistas regionales sobre comportamientos sociales adecuados, códigos de vestimenta y patrones de interacción.

- Evaluación de probabilidades demográficas — Investiga si la composición de la multitud concuerda con los patrones típicos de asistencia a eventos similares.

- Análisis forense de comportamiento individual — Analiza a personas específicas para verificar personalidades y relaciones consistentes, y respuestas emocionales auténticas.

- Estudio de adaptación ambiental — Verifica que las respuestas de la multitud al clima, sonidos y logística estén acordes con los patrones del mundo real.

- Investigación de comparación histórica — Compara el evento retratado con filmaciones verificadas o fotografías de eventos similares auténticos en la misma región o contexto cultural.

- Red de consultas expertas — Contacta a antropólogos, sociólogos y periodistas locales familiarizados con dinámicas sociales regionales.

- Análisis de micro expresiones — Consulta a expertos para analizar expresiones faciales que te ayuden a distinguir entre respuestas emocionales auténticas y la generación artificial.

- Mapeo de redes sociales. Rastrea las relaciones entre individuos para verificar la autenticidad de cómo se formó el grupo en comparación con una reunión artificial.

Categoría 7: Reconocimiento intuitivo de patrones — El antiguo sistema de detección

Una imagen generada por IA que pretende mostrar al presidente de Bielorusia sosteniendo de forma incongruente un cono de papas fritas durante una reunión oficial. Imagen: Henk van Ess

La narrativa: Los patrones de reconocimiento fueron parte de la evolución de nuestro cerebro a lo largo de millones de años. Los patrones de la IA vienen del entrenamiento con datos y procesos algorítmicos. Cuando algo viola las expectativas naturales construidas dentro de la percepción humana, esa corazonada a menudo representa la forma más rápida y fiable de detección, antes del análisis técnico.

Historias de éxito del mundo real: En 2019, los usuarios de redes sociales inmediatamente llamaron la atención sobre la imagen viral de un “tiburón callejero” durante el Huracán Florence. Aunque fue una imagen técnicamente competente, quienes la vieron tuvieron la impresión de que algo estaba mal con la situación. Sus instintos resultaron ser correctos, pues las búsquedas inversas revelaron la inserción digital. De igual forma, los periodistas experimentados pueden detectar cuándo los videos de principiantes parecen sospechosamente cinemáticos, o cuándo surge una documentación perfecta para eventos espontáneos.

Dato curioso: parece que los supuestos encuentros se dieron durante más de una década en muchos huracanes, pero sólo un ejemplo logró ser verificado.

Revisión de banderas rojas en 30 segundos: Confía en tu reconocimiento evolutivo de patrones cuando el tiempo apremia. Busca paradojas en la calidad de producción, en las que las fuentes principiantes producen nivel de contenido propio de Hollywood, o una enorme conveniencia en cuándo se capturan las imágenes, documentando a la perfección eventos caóticos. Tu viejo sistema de detección personal a menudo identifica estas violaciones antes que haya un análisis técnico.

Revisión de banderas rojas en 30 segundos:

- Primera impresión — ¿Se siente auténtico o “producido”? (Confía en tus sensaciones de inquietud hacia las representaciones artificiales de seres humanos, también conocida como emociones de “valle inquietante”.

- Paradoja de costo-producción — ¿La fuente principiante se alinea con la calidad cinemática (con ocho dólares se pueden producir escándalos políticos que se ven muy profesionales)?

- Revisa qué tan conveniente es el momento de publicación — ¿Crees que la documentación perfecta de esos eventos aconteció demasiado pronto para que fuera una grabación normal?

- Prueba de manipulación emocional — ¿El contenido está diseñado para generar una reacción emocional y una propagación rápida, en lugar de informar al observador?

Verificación técnica de cinco minutos (historias estándar): Transforma las emociones intuitivas en verificación sistemática al examinar elementos específicos que detonaron tu patrón de habilidades de reconocimiento. Cuando tu instinto te dice que algo está mal, identifica qué específicamente viola las expresiones naturales para elaborar una conclusión lógica.

- Revisión profunda de contexto lógico — ¿La escena tiene sentido desde una perspectiva práctica, desde tu conocimiento del mundo real?

- Investigación de la credibilidad de la fuente — ¿El origen concuerda con la sofisticación y requisitos de acceso del contenido?

- Análisis de conveniencia narrativa — ¿Acaso las historias se alinean de forma demasiado precisa con las actuales tensiones políticas o sociales?

- Auditoría de inconsistencias técnicas — ¿La calidad, iluminación o audio encajan con las supuestas circunstancias?

- Catálogo de violación de patrones — Documenta elementos específicos que desaten emociones de sospecha o te hagan pensar que el contexto es imposible.

- Evaluación de incongruencia en la fuente del contenido — Sospecha de contenido sofisticado presentado por fuentes principiantes o anónimas sin explicación alguna.

Investigación profunda (reportaje de alto riesgo): Usa la detección intuitiva como un punto de partida para la verificación comprensiva. Tu reconocimiento de patrones detectó anomalías. Ahora, examina sistemáticamente cada elemento que detonó sospechas para construir una evaluación basada en evidencias.

- Análisis forense mediante instinto — Cataloga cada elemento que percibes fuera de lugar e investiga por qué viola las expectativas naturales.

- Investigación de paradojas en la producción — Calcula los recursos que de hecho se necesitan para la producción, y compáralas con las supuestas capacidades de un principiante.

- Imposibilidad de un análisis contextual — Mapea escenarios contrastados con el conocimiento del mundo real y las consultas con expertos.

- Evaluación de la manipulación emocional — Analiza la estructura de contenido para identificar si hay detonantes diseñados para ser virales, en lugar de una propagación orgánica.

- Búsqueda profunda de inconsistencias técnicas — Analiza la calidad, la iluminación y las incongruencias de audio, cuadro por cuadro.

- Verificación de autenticidad de la fuente — Investiga si los supuestos orígenes pudieron haber hecho este contenido, siendo realistas.

- Detección de ingeniería narrativa — Examina la construcción de la historia para encontrar conveniencia artificial en lugar del desarrollo natural de un evento.

- Consulta de expertos en violación de patrones — Busca investigadores experimentados en evaluaciones independientes e intuitivas.

- Análisis de límite de confianza — Documenta cuándo hay múltiples elementos que parecen fuera de lugar y justifican rechazar el contenido a pesar de que sea técnicamente competente.

Cuando confiar en tu intuición:

- Si hay múltiples elementos que se sienten fuera de lugar y no puedes identificar problemas específicos.

- Cuando el contenido desata una respuesta emocional inmediata, está diseñado para impedir el análisis.

- Si la fuente, el momento en que se publica o el contexto despiertan preguntas lógicas.

- Cuando la calidad técnica no concuerda con el nivel de experiencia del productor.

- Si tu cerebro detecta una paradoja en la calidad de la producción o la conveniencia de cuándo se publica, que fue demostrada por tu experimento.

La realidad: no hay soluciones perfectas

En última instancia: Estas siete categorías de detección IA y la nueva herramienta — fallas anatómicas, violaciones de las leyes de la física, huellas digitales, artefactos de voz, contexto lógico, patrones de comportamiento y reconocimiento intuitivo —les dan a los periodistas una caja de herramientas integral para evaluar la autenticidad del contexto bajo la presión de una entrega. Junto con las herramientas de detección profesionales y estándares editoriales actualizados, podemos mantener la credibilidad. Usa el fuego para combatir el fuego. Usa la IA para detectar la IA, y ayuda a preservar lo que queda de nuestra realidad compartida.

El neerlandés Henk van Ess está abriendo camino a través de la IA para encontrar historias en los datos. Aplica esto en investigaciones y construye herramientas para uso público, como SearchWhisperer y AI Researcher. Ha dado entrenamientos en redacciones alrededor del mundo, como el Washington Post, Axel Springer, BBC y DGP. Dirige Digital Digging, donde la inteligencia de fuente abierta se encuentra con la IA. Es asesor de la Poynter’s International Fact-Checking Network (IFCN) y la European Fact-Checking Standards Network (EFCSN).

El neerlandés Henk van Ess está abriendo camino a través de la IA para encontrar historias en los datos. Aplica esto en investigaciones y construye herramientas para uso público, como SearchWhisperer y AI Researcher. Ha dado entrenamientos en redacciones alrededor del mundo, como el Washington Post, Axel Springer, BBC y DGP. Dirige Digital Digging, donde la inteligencia de fuente abierta se encuentra con la IA. Es asesor de la Poynter’s International Fact-Checking Network (IFCN) y la European Fact-Checking Standards Network (EFCSN).