Ilustración: Nodjadong Boonprasert para GIJN

सोशल मीडिया एल्गोरिदम की जांच कैसे करें

इस लेख को पढ़ें

सोशल मीडिया एल्गोरिदम काफी प्रभावशाली है। सोशल मीडिया के न्यूज़फ़ीड अब एल्गोरिदम द्वारा संचालित होते हैं। दुनिया भर के देशों और सरकारों को अस्थिर करने में इसकी भूमिका देखने को मिलती है। इसने लोगों के मानसिक स्वास्थ्य पर गहरा प्रभाव डाला है। इससे हमारे रिश्तों के टूटने का भी खतरा है। कुछ उदाहरण देखें :

- फेसबुक और इंस्टाग्राम में फ़िलिस्तीन समर्थक सामग्री पर अघोषित प्रतिबंध।

- घाना में राजनीतिक अशांति भड़काने के लिए भ्रामक सूचना अभियान।

- राजनीतिक मतभेद के कारण एक माँ ने अपनी बेटी को सोशल मीडिया पर अनफ़ॉलो किया

सोशल मीडिया एल्गोरिदम की जांच कई रूप ले सकती है। कुछ जांच में हफ़्तों लग सकते हैं। इसके लिए डिजिटल फ़ोरेंसिक और कोडिंग कौशल की जरूरत पड़ सकती है। कोई जांच किसी खास तकनीकी जानकारी के बिना भी संभव है। अलग-अलग खातों की सामग्री का पता लगाकर यह जांच हो सकती है। सोशल प्लेटफ़ॉर्म पर प्रयोग करके आप पता लगा सकते हैं कि इनकी पोस्ट से क्या नुकसान हो रहा है।

सोशल मीडिया एल्गोरिदम पर रचनात्मक तरीके से खबरों की बेहद आवश्यकता है। ऐसा करके आप सोशल मीडिया कंपनियों को जवाबदेह बना सकते हैं। मेटा या टिकटॉक जैसी कंपनियां यह नहीं बतातीं कि वह अपना एल्गोरिदम कैसे बनाती हैं। कभी-कभार लीक होने वाले दस्तावेज़ों (leak of documents) से ऐसी खबरें सामने आ जाती हैं। इसलिए पत्रकारों को एल्गोरिदम के काम करने के तरीके को रिवर्स इंजीनियर करने के तरीके खोजने होंगे। यह साबित करना होगा कि वे नफ़रत फैलाने वाली अथवा भ्रामक सामग्री फैलाकर किस तरह समाज को नुकसान पहुंचा रही हैं।

एल्गोरिदम क्या है? यह कैसे काम करता है?

एल्गोरिदम किसी खास काम के लिए बनाए गए नियमों या गणनाओं का समूह है। इसके जरिए सोशल मीडिया के डेटा का मूल्यांकन किया जाता है। किसी उपयोगकर्ता को कैसी सामग्री पसंद है, इसका पता लगाया जाता है। उस प्लेटफ़ॉर्म पर वह किन लोगों से जुड़ा है? उसने किस तरह की पोस्ट के साथ संवाद किया? इसके आधार पर यह निर्धारित किया जाता है कि उपयोगकर्ता अपने न्यूज़ फ़ीड, टाइमलाइन या स्ट्रीम पर कैसी सामग्री देखेंगे। एल्गोरिदम के जरिए यह अनुमान लगाया जाता है कि उपयोगकर्ता किन चीज़ों से जुड़ सकता है।

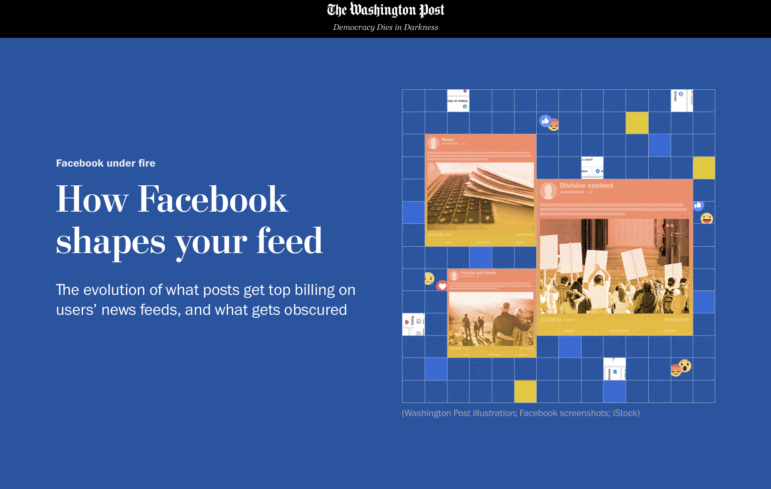

एल्गोरिदम को उनके कॉरपोरेट मालिकों द्वारा लगातार बदला जा रहा है। समय के साथ यह और भी परिष्कृत हो रहा है। द वाशिंगटन पोस्ट की 2021 की रिपोर्ट देखें। इसके अनुसार फ़ेसबुक का एल्गोरिदम लगभग 10,000 संकेतों को ध्यान में रखता है। इसके जरिए अनुमान लगाता है कि कोई उपयोगकर्ता कैसी पोस्ट के साथ इंटरैक्ट कर सकता है।

द वाशिंगटन पोस्ट ने 2021 में फेसबुक के बदलते एल्गोरिदम का अध्ययन किया। इमेज: स्क्रीनशॉट, द वाशिंगटन पोस्ट

सोशल मीडिया पर एल्गोरिदम बेहद जटिल होते हैं। उन्हें बनाने वाली कंपनियां यह नहीं बतातीं कि यह कैसे काम करता है। इसलिए खोजी पत्रकारों को इन प्लेटफ़ॉर्म के बारे में जवाबदेही पत्रकारिता करते समय एल्गोरिदम के हानिकारक परिणामों पर ध्यान देना चाहिए। इसमें इन प्लेटफार्मों पर वायरल होने वाली सामग्री के प्रकारों को देखना होगा। यह समझना होगा कि कुछ कमजोर आबादी को किस प्रकार के वीडियो दिखाए जा रहे हैं। एल्गोरिदम कैसे काम कर रहा है? इसकी जांच के लिए कुछ डमी खाते बनाकर देख सकते हैं। किसी प्लेटफॉर्म पर ट्रोलिंग, जानबूझकर किसी को आपत्तिजनक या भड़काऊ पोस्ट के साथ उकसाने या फंसाने की कोशिश कैसे हो रही है? झूठी जानकारी कितनी व्यापक है? सोशल वेब से जुड़ी खबरों को कवर करने में सूचना के प्रवाह पर चर्चा करना भी शामिल है। ऐसी जांच के दौरान शब्दों और अवधारणाओं की एक सामान्य समझ विकसित करना जरूरी है। हम जिन घटनाओं को ऑनलाइन देखते हैं, वे सोशल मीडिया के लिए विशिष्ट होती हैं।

दुष्प्रचार, गलत सूचना और नफरती भाषा

सोशल मीडिया की सार्वजनिक चर्चा में तीन शब्द सबसे लोकप्रिय हैं- गलत सूचना, दुष्प्रचार और नफरती भाषा। यह क्या है? ऐसी चीजें कैसे फैलती हैं? इसे समझना होगा। ऑनलाइन सूचना को कवर करने वाले पत्रकारों के लिए कई प्रासंगिक संसाधन उपलब्ध हैं। जैसे, ईयू डिसइन्फ़ोलैब (गैर-लाभकारी शोध संगठन) ने एक ‘गलत सूचना शब्दावली’ बनाई है।

गलत सूचना (Misinformation) – इस शब्द का इस्तेमाल ऑनलाइन मुद्दों की एक विस्तृत श्रृंखला का वर्णन करने के लिए किया जाता है। यह झूठी जानकारी होती है। लेकिन लोग अक्सर इसे सच मानकर साझा करके फैलाते हैं। जैसे, ब्रेकिंग न्यूज के दौरान कुछ लोग गलती से किसी दूसरी या पुरानी घटना की तस्वीरें साझा करते हैं। उन्हें लगता है कि यह उसी मामले से संबंधित है।

दुष्प्रचार (Disinformation) – यह जानबूझकर गुमराह करने या नुकसान पहुंचाने के लिए फैलाई गई झूठी सूचना है। जैसे, 2016 के अमेरिकी राष्ट्रपति चुनाव का एक मामला देखें। अमेरिकी सीनेट और हाउस इंटेलिजेंस कमेटियों ने फेसबुक के सहयोग से एक जांच कराई । पता चला कि रूसी एजेंटों ने अमेरिकी मतदाता होने का ढोंग करके राजनीतिक विभाजन पैदा करने के लिए फर्जी विरोध प्रदर्शनों के बारे में दुष्प्रचार फैलाया। हालांकि रूस ने अमेरिकी चुनाव में ऐसी दखलंदाजी से इनकार किया।

नफरती भाषा (Hate speech) – ऐसी हानिकारक सामग्री अक्सर ऑनलाइन फैलाई जाती है। यह किसी समूह के खिलाफ नफरत फैलाती है। उनकी विशेषताओं, जाति, धर्म, लिंग या यौन रचना के आधार पर हिंसा भड़काती है। जैसे, म्यांमार के राजनेताओं ने एक मुस्लिम जातीय अल्पसंख्यक समुदाय रोहिंग्या को अमानवीय और शैतान बताने के लिए फेसबुक का दुरूपयोग किया। इसके कारण रोहिंग्या लोगों के खिलाफ हिंसा हुई। इस पर संयुक्त राष्ट्र की एक रिपोर्ट भी आई। इसके बाद फेसबुक ने म्यांमार में 20 संगठनों और व्यक्तियों पर प्रतिबंध लगाकर नफरत और गलत सूचना का प्रसार रोकने का प्रयास किया। हालांकि म्यांमार के सैन्य अधिकारियों ने इस रिपोर्ट के निष्कर्षों को खारिज कर दिया।

पत्रकारों के लिए यह समझना ज़रूरी है कि किसी भी मीडिया इकोसिस्टम में मुख्य खिलाड़ी कौन हैं। एल्गोरिदम व्यक्तिगत ऑनलाइन अनुभव तैयार करते हैं। इसका मतलब है कि हम लोग सूचनाओं की अपनी एक खास छोटी-सी दुनिया में रहते हैं। इसे ‘इको चैंबर’ या ‘फ़िल्टर बबल’ कहा जाता है।

सोशल मीडिया में बड़े पैमाने पर मौजूद सामान्य ‘निष्क्रिय उपयोगकर्ता’ इस इको-सिस्टम का हिस्सा होते हैं। ऐसे लोग दूसरों की बनाई सामग्री को साझा करते हैं। लेकिन खुद कोई प्रभावी सामग्री नहीं बनाते। दूसरी श्रेणी ‘सक्रिय सामग्री निर्माता’ की है। ऐसे लोग काफी सामग्री तैयार करते हैं। सामान्य लोगों द्वारा पढ़ी और साझा की जाने वाली जानकारी पर उनका काफ़ी प्रभाव होता है। इनमें सरकारी संस्थाओं, मीडिया और अन्य प्रभावशाली लोग होते हैं। इनके अलावा, ऐसे बुरे लोग हैं, जो मतभेद पैदा करने की कोशिश करते हैं। इन सबके बीच एक महत्वपूर्ण चीज ‘एल्गोरिदम’ है। यह डेटा-संचालित नियमों का एक सिस्टम है। यह निर्धारित करता है कि लोगों की टाइमलाइन पर कौन-सी सामग्री दिखाई जाए। यह सोशल मीडिया के इको-सिस्टम में लोगों के अनुभवों को आकार प्रदान करता है।

एल्गोरिदम की जांच के तीन तरीके

रिपोर्टर जेन लिट्विनेंको और मैंने कुछ साल पहले इन मुद्दों की जांच के लिए एक ढांचा विकसित किया था। मीडिया पारिस्थितिकी तंत्र में तीन प्रमुख पक्ष हैं- दर्शक, सामग्री निर्माता या एल्गोरिदम। इनमें से किसी एक को केंद्र में रखकर आपको जांच करनी होगी।

-

उपयोगकर्ता पर ‘एल्गो–फीड‘ के असर की जांच

सबसे पहले आप यह जांच कर सकते हैं कि दर्शकों पर ‘एल्गो-फीड’ का असर क्या है? सोशल मीडिया उपयोगकर्ताओं पर ध्यान केंद्रित करना एक अच्छी शुरुआत है। लोग अक्सर अपने दोस्तों से जुड़ने या समाचार और जानकारी प्राप्त करने के लिए सोशल मीडिया का उपयोग करते हैं। ‘एल्गोरिदम’ के जरिए उन्हें कौन-सी सामग्री देखने को मिलती है, इससे जुड़े उनके अनुभव आपके लिए उपयोगी हैं।

किसी व्यक्ति द्वारा गलत या भ्रामक सूचना का अनुभव करना उनका व्यक्तिगत मामला होता है। दुनिया को देखने-समझने के उनके नजरिये को एल्गोरिदम और न्यूज़फ़ीड के जरिए प्रभावित किया जाता है। इसकी जांच के लिए आपको किसी उपयोगकर्ता के ऑनलाइन विचारों के डेटा पर ध्यान केंद्रित करना होगा। सोशल वेब पर उसके अनुभव की ‘मात्रात्मक सेल्फी’ ले सकते हैं।

इसके लिए किसी व्यक्ति से उसके डेटा तक पहुंच की अनुमति मांगनी होगी। इससे आप देख सकते हैं कि वे सोशल मीडिया का अनुभव कैसे करते हैं। यूरोपीय संघ में डेटा और सुरक्षा नियम (जीडीपीआर) लागू हैं। इसके कारण यूरोपीय संघ में संचालित कई सोशल मीडिया कंपनियां अपने उपयोगकर्ताओं को अपने डेटा पर अधिक नियंत्रण प्राप्त होता है। इनमें टिकटॉक, मेटा और एक्स (ट्वीटर) शामिल हैं। इसमें लोगों को अपनी ऑनलाइन गतिविधियों के डेटा तक पहुंचने, डाउनलोड करने और उसे डिलीट करने की सुविधा मिलती है।

न्यूयॉर्क के न्यूज पोर्टल ‘डॉक्यूमेंटेड’ ने यह रिपोर्ट की। इसके संवाददाता मलिक गाई ने पांच सेनेगल प्रवासियों के टिकटॉक का अध्ययन किया। उन पांचों ने एक निश्चित अवधि में टिकटॉक पर क्या सामग्री देखी, इस पर स्टडी की। पता चला कि टिकटॉक की गलत सूचनाओं ने इन्हें अमेरिका आने के लिए प्रेरित किया। अब भी उन्हें अमेरिका के बारे में भ्रामक जानकारी दी जा रही थी। टिकटॉक पर मिली गलत जानकारी के कारण इन लोगों ने संयुक्त राज्य अमेरिका आने का कदम उठाया। ऐसे प्रवासी अब भी अपनी मूल भाषा में जानकारी के लिए काफी हद तक टिकटॉक पर निर्भर थे। रिपोर्टर को पता चला कि इन पांचों प्रवासियों को अनगिनत वीडियो में आव्रजन प्रक्रियाओं के बारे में भ्रामक जानकारी मिली थी। कुछ वीडियो में अमेरिका में शरण लेने या शरणार्थी (असाइलम) दर्जा पाने संबंधी आवेदन भरने के गलत तरीके बताए गए थे। अगर उनके आधार पर आवेदन किए जाएं, तो उनकी आव्रजन कार्यवाही पर नकारात्मक प्रभाव पड़ सकता था। एक अन्य वीडियो में झूठा दावा किया गया कि न्यूयॉर्क शहर के मेयर द्वारा प्रवासियों के बीच 50 मिलियन अमेरिकी डॉलर बांटे जा रहे हैं। टिकटॉक की मालिक कंपनी बाइटडांस ने इस पर कोई टिप्पणी नहीं की।

एनबीसी न्यूज़ की रिपोर्टर कैट टेनबार्ज की यह रिपोर्ट देखें। इसमें युवा महिलाओं के मानसिक स्वास्थ्य पर सोशल मीडिया के विनाशकारी प्रभाव की जांच की गई। ‘एक्स’ (ट्वीटर) पर कई उपयोगकर्ता समूहों की पड़ताल की गई। इनमें पतला या स्लिम होने के लिए खाने-पीने की हानिकारक आदतों को बढ़ावा दिया गया था। इनमें 2,000 से 1,73,000 उपयोगकर्ता थे। कुछ की उम्र 13 साल से भी कम थी। एनबीसी न्यूज़ को दिए गए एक बयान के अनुसार “एक्स ऐसी सामग्री को प्रतिबंधित करता है जो आत्म-हानिकारक व्यवहार को बढ़ावा देती है। बाल यौन शोषण पर भी पूरी तरह से रोक है। इसकी गहन समीक्षा के बाद ‘एक्स’ ने नियमों का उल्लंघन करने के वाले ऐसे समूहों को निलंबित कर दिया।”

“कैन नॉट लुक अवे” (Can’t Look Away) – यह 2025 की एक डॉक्यूमेंट्री है। इसमें फेसबुक, टिकटॉक और इंस्टाग्राम में पहले काम कर चुके कुछ व्हिसल ब्लोअर्स को दिखाया गया है। इसमें बताया गया है कि एल्गोरिदम किस तरह से सामग्री दिखाने के तरीकों के जरिए खासकर युवाओं को नुकसान पहुंचा सकता है। एक व्हिसल ब्लोअर चार्ल्स बहर ने टिकटॉक में अपने काम की चर्चा की। बताया कि एल्गोरिदम भावनात्मक बुद्धिमत्ता के बिना हर चीज़ को अनुकूलित करता है। इससे नुकसान होता है। उन्होंने बताया कि कैसे टिकटॉक आपको ऐसी सामग्री दिखाता है, जिस पर उपयोगकर्ता अधिक समय बिताते हैं, न कि वह सामग्री जिसे वे खोजते हैं। यदि कोई उपयोगकर्ता एक निराशाजनक वीडियो देखता है, तो उसका फ़ीड उसी तरह की सामग्री दिखाने लगता है। टिकटॉक का तर्क है कि वह युवा दर्शकों के लिए सुरक्षा उपाय, स्क्रीन-टाइम प्रबंधन उपकरण, माता-पिता और अभिभावकों के लिए सुरक्षा उपकरण तथा अन्य संसाधन प्रदान करता है।

चार्ल्स बहर ने कहा कि किसी प्लेटफ़ॉर्म पर उपयोगकर्ताओं द्वारा अनुभव की जा रही समस्या को दोहराना आसान है। खासकर परेशान करने वाली या कष्टदायक सामग्री के संदर्भ में। इसका मतलब है कि समस्या ज़्यादा संरचनात्मक है। इसलिए पत्रकार रिवर्स इंजीनियरिंग करके देख सकते हैं। अगर वे किसी खास तरह की सामग्री के साथ ज़्यादा इंटरैक्ट करते हैं, तो उनका फ़ीड कैसा दिखेगा। ऐसा करके यह समझा जा सकता है कि यह आम उपयोगकर्ताओं पर कैसे असर डाल सकता है।

एक अन्य व्हिसलब्लोअर, आर्टुरो बेजर ने फेसबुक और इंस्टाग्राम दोनों में काम किया है। उन्होंने कहा कि कंपनियां कहती हैं कि उपयोगकर्ता ‘रुचि नहीं’ या ‘स्किप’ बटन के जरिए ऐसी सामग्री को रोक सकते हैं, जिसे वे अपने फ़ीड में नहीं देखना चाहते हैं। हालांकि ऐसे नियंत्रण प्रभावी नहीं हैं। एल्गोरिदम अब भी उपयोगकर्ताओं को ज़्यादातर वही सामग्री दिखाता है, जिस पर वे ज़्यादा समय बिताते हैं। मेटा का दावा है कि “उसने अपने प्लेटफ़ॉर्म पर किशोरों के अनुभव को बेहतर बनाने के लिए 30 से ज़्यादा सुविधाएं शुरू की हैं।”

- हानिकारक या झूठी जानकारी की जांच

एल्गोरिदम की जांच का दूसरा तरीका यह देखना है कि सामग्री निर्माता किस तरह गलत जानकारी को बढ़ावा देने के लिए एल्गोरिदम का फ़ायदा उठाते हैं। ऐसी सामग्री निर्माताओं की जांच के लिए आप झूठी या भ्रामक वायरल सामग्री को देखकर उसकी उत्पत्ति का पता लगाने का प्रयास करें। दुष्प्रचार अभियान चलाने वाले कई बुरे लोग झूठी या भ्रामक सामग्री का इस्तेमाल करते हैं। उसे विभिन्न प्लेटफ़ॉर्म पर बार-बार पोस्ट करते हैं।

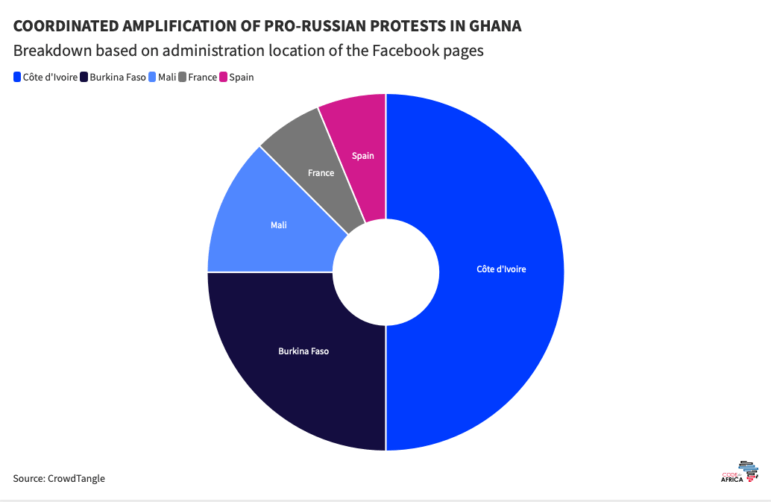

कोड फ़ॉर अफ़्रीका की एक रिपोर्ट देखें। इसमें घाना से बाहर के 16 फ़ेसबुक अकाउंट्स के एक नेटवर्क की जांच की गई। इसने एक ही पोस्ट को बार-बार वायरल करके घाना में रूस समर्थक प्रदर्शनकारियों की कथित गिरफ़्तारियों के बारे में ग़लत सूचना फैलाई। ये खाते कोटे डी आइवर, बुर्किना फासो, माली, फ्रांस और स्पेन में स्थित थे।

इंस्टाग्राम पर नकली फालोअर्स खरीदना – यह स्विस सार्वजनिक समाचार संगठन Schweizer Radio und Fernsehen (SRF) की रिपोर्ट है। इसके पत्रकारों ने नकली खातों की पहचान करने के लिए मशीन लर्निंग का इस्तेमाल किया। उन्होंने इंस्टाग्राम में 5,000 नकली खाते खरीदे। अपने मशीन लर्निंग मॉडल को उन नकली खातों की विशेषताओं पर प्रशिक्षित किया। फिर इस प्रशिक्षित मॉडल का उपयोग करके अन्य नकली खातों की पहचान की।

घाना में रूस समर्थक प्रभाव अभियान की जाँच की गई। इसमें कोड फ़ॉर अफ़्रीका ने पाया कि ये खाते वास्तव में किन बाहरी देशों में स्थित थे। इमेज: कोड फ़ॉर अफ़्रीका

-

एल्गोरिदम कैसे काम करता है, इसकी जांच

एल्गोरिदम की जांच का तीसरा तरीका इसके काम के तरीकों की जांच करना है। उन एल्गोरिदम के बारे में जांच करें, जो सोशल मीडिया को संचालित करते हैं। इसमें हमारे अधिकांश ऑनलाइन अनुभव को नियंत्रित करने वाली प्रणाली की जांच की जाती है। इसमें सूचना के प्रसार या अवसरों तक पहुंच पर एल्गोरिदम का प्रभाव शामिल है। हालांकि सोशल मीडिया एल्गोरिदम की जांच या ऑडिट करना आसान नहीं है। यह अस्पष्ट, जटिल प्रणाली है। जनता के लिए यह दुर्गम हैं।

‘फेसबुक किस तरह आपकी फीड को आकार देता है’ – ‘द वाशिंगटन पोस्ट’ ने यह महत्वपूर्ण जांच की। इसके अनुसार, कोई व्यक्ति किसी पोस्ट के साथ इंटरैक्ट करेगा या नहीं, यह अनुमान लगाने के लिए फेसबुक एल्गोरिदम 10,000 से अधिक विभिन्न संकेतों को ध्यान में रखता है।

इसलिए पत्रकारों को डेटा संग्रह और परीक्षण अकाउंट्स के साथ ही कुछ एल्गोरिदम के काम करने के तरीके को रिवर्स-इंजीनियर करना पड़ता है। उदाहरण के लिए, द वॉल स्ट्रीट जर्नल ने 100 टिकटॉक अकाउंट बनाए। इसके जरिए यह पता लगाया कि अलग-अलग गतिविधियों का इन अकाउंट्स द्वारा देखी जाने वाली सामग्री पर क्या प्रभाव पड़ता है। जैसे, किसी पोस्ट पर देर तक रुकने से लेकर वीडियो दोबारा देखना।

तकनीक की जांच के लिए आपको हाई-टेक दृष्टिकोण अपनाने की ज़रूरत नहीं है। एक पत्रकार के रूप में आपको हमेशा सिस्टम की व्याख्या करना जरूरी नहीं। कई बार ‘सिस्टम को छेड़ना’ और यह दिखाना ही काफी होता है कि यह नुकसान पहुंचा रहा है।

फेसबुक रंगभेद के आधार पर भेदभाव की अनुमति देता है – प्रोपब्लिका की इस जांच में पत्रकारों ने फ़ेसबुक पर विज्ञापन देने के लिए एक अकाउंट बनाया। पता चला कि फेसबुक नस्ल, लिंग और अन्य व्यक्तिगत विशेषताओं के आधार पर लोगों से भेदभाव करने वाले विज्ञापन देने से नहीं रोकेगा। रिपोर्ट के अनुसार फेसबुक ने कानून का उल्लंघन करने के तरीके खोज निकाले। उसने जनता को होने वाले नुकसान को रोकने की जरूरत नहीं समझी। हालांकि फेसबुक ने प्रोपब्लिका के समक्ष दावा किया कि वह विज्ञापनदाताओं को अपनी सेवाओं का भेदभावपूर्ण तरीके से उपयोग करने से रोकता है।

नुकसान रोकने में सोशल मीडिया कंपनियों की विफलता

एल्गोरिदम की जांच के लिए आपको सोशल मीडिया कंपनियों के अंदरूनी कामकाज की गहराई से जांच करनी होगी। सोशल मीडिया कंपनियों के वर्तमान और पूर्व कर्मचारियों के साथ संबंध बनाकर आप यह काम कर सकते हैं। उनके खिलाफ दायर मुकदमों की तहकीकात करें। व्हिसलब्लोअर के साथ मिलकर भी ऐसी जांच हो सकती है।

इथियोपिया के एक प्रोफेसर मेरेग अमारे की हत्या की जांच – ‘इनसाइडर’ के रिपोर्टर टेकेंद्र परमार ने यह जांच की थी। फेसबुक पर प्रोफेसर मेरेग अमारे के बारे में घृणित, झूठी सामग्री फैलाई जा रही थी। बाद में प्रोफेसर की हत्या कर दी गई थी। पत्रकार ने फेसबुक के ट्रस्टेड पार्टनर प्रोग्राम के तहत काम करने वाले कई लोगों से बात की। यह प्रोग्राम नागरिक समाज संगठनों का एक नेटवर्क है। इनके पास नफरती सामग्री की पहचान करने और फेसबुक को सूचित करने के लिए आवश्यक भाषाई और सांस्कृतिक ज्ञान था। इससे जुड़े छह लोगों ने बताया कि प्रोफेसर मेरेग अमारे के खिलाफ लगातार फैलाई जा रही घृणित सामग्री के बारे में फेसबुक को कई बार सूचित किया गया। लेकिन फेसबुक ने इसे नज़रअंदाज़ कर दिया। इन छह लोगों ने फेसबुक को भेजे गए अपने संचार को देखने का भी अवसर दिया। फेसबुक की मूल कंपनी मेटा ने ‘इनसाइडर’ को बताया कि ट्रस्टेड पार्टनर्स द्वारा भेजी गई रिपोर्ट की यथाशीघ्र समीक्षा की जाती है। हर मामले के अनुसार समीक्षा का समय अलग-अलग हो सकता है।

ऐसे उदाहरण दिखाते हैं कि सोशल वेब की जांच के लिए आप कई तरह की रिपोर्टिंग विधियों का उपयोग कर सकते हैं। इसमें विश्लेषण के लिए प्लेटफ़ॉर्म से डेटा स्क्रैप करना एक अच्छा तरीका है। साथ ही, बुरे लोगों का पता लगाने के लिए डिजिटल फ़ोरेंसिक विधियों का उपयोग करने जैसे उच्च-तकनीकी तरीके भी हैं। लेकिन आपके पास समुचित तकनीकी समाधान न हों, तब भी सफल हो सकते हैं। जैसे, किसी सोशल मीडिया प्लेटफ़ॉर्म के कारण नुकसान झेल चुके लोगों का साक्षात्कार लेना। इसके अलावा, इसके हानिकारक परिणामों को साबित करने के लिए प्लेटफ़ॉर्म पर प्रयोग करना भी संभव है। सोशल मीडिया एल्गोरिदम की जांच करना एक उभरता हुआ क्षेत्र है। इसमें सफलता की मुख्य कुंजी एक रचनात्मक दृष्टिकोण है।

अतिरिक्त संसाधन

पत्रकारों के लिए उपकरण

- पत्रकारों के लिए एल्गोरिदमिक साक्षरता – यह पत्रकारों को एल्गोरिदम समझने में मदद करने के लिए एक व्यावहारिक टूलकिट है। इन शोधकर्ताओं ने डीआईवाई एल्गोरिदम ऑडिट के लिए एक संक्षिप्त मार्गदर्शिका भी तैयार की है।

- इंडिकेटर – क्रेग सिल्वरमैन (भ्रामक सूचना विशेषज्ञ) और एलेक्सियोस मंत्ज़र्लिस द्वारा तैयार किया गया एक न्यूज़लेटर।

- बेलिंगकैट – यह संगठन सोशल मीडिया के क्षेत्र में व्यापक सत्यापन कार्य करता है। यह कई उपयोगी गाइड प्रकाशित करता है।

- सोशल मीडिया प्लेटफॉर्म की निगरानी के नए खोजी उपकरण – जीआइजेएन द्वारा प्रकाशित लेख।

- माइनिंग सोशल मीडिया – सोशल वेब से डेटा स्क्रैपिंग और विश्लेषण पर एक पायथन पुस्तक।

- द एल्गोरिदम्स बीट : एंगल्स एंड मेथड्स फ़ॉर इन्वेस्टिगेशन– डेटा जर्नलिज़्म हैंडबुक में एल्गोरिदम की जांच संबंधी एक अध्याय।

शोध

- एल्गोरिदमिक जस्टिस लीग– यह संगठन जो एल्गोरिदम संबंधी नुकसान की जांच और दस्तावेज़ीकरण करता है।

- एआई नाउ इंस्टीट्यूट, एक स्वतंत्र संस्थान जो एआई और एल्गोरिद्म संबंधी जवाबदेही पर शोध प्रकाशित करता है

- सेंटर फ़ॉर डेमोक्रेसी एंड टेक्नोलॉजी– यह एक गैर-लाभकारी संस्था है। यह डिजिटल युग में नागरिक स्वतंत्रता पर रिपोर्ट प्रकाशित करती है।

- डेटा एंड सोसाइटी – एक गैर-लाभकारी शोध संस्था, जो तकनीक, डेटा और नीतियों पर केंद्रित है।

- एल्गोरिदम वॉच – ज्यूरिख और बर्लिन स्थित एक गैर-लाभकारी संस्था।

लैम थुई वो – खोजी पत्रकार हैं। व्यवस्था और नीतियों का व्यक्तियों पर क्या प्रभाव पड़ता है, इसका डेटा विश्लेषण करके ज़मीनी रिपोर्टिंग करती हैं। डॉक्यूमेंटेड नामक एक स्वतंत्र, गैर-लाभकारी न्यूज़रूम में कार्यरत हैं। यह अप्रवासी समुदायों के साथ और उनके लिए रिपोर्टिंग के लिए समर्पित न्यूज़रूम है। वह क्रेग न्यूमार्क ग्रेजुएट स्कूल ऑफ़ जर्नलिज़्म में डेटा जर्नलिज़्म की एसोसिएट प्रोफ़ेसर भी हैं। पहले वह द मार्कअप, बज़फीड न्यूज़, द वॉल स्ट्रीट जर्नल, अल जज़ीरा अमेरिका और एनपीआर के प्लैनेट मनी में पत्रकार रह चुकी हैं।

लैम थुई वो – खोजी पत्रकार हैं। व्यवस्था और नीतियों का व्यक्तियों पर क्या प्रभाव पड़ता है, इसका डेटा विश्लेषण करके ज़मीनी रिपोर्टिंग करती हैं। डॉक्यूमेंटेड नामक एक स्वतंत्र, गैर-लाभकारी न्यूज़रूम में कार्यरत हैं। यह अप्रवासी समुदायों के साथ और उनके लिए रिपोर्टिंग के लिए समर्पित न्यूज़रूम है। वह क्रेग न्यूमार्क ग्रेजुएट स्कूल ऑफ़ जर्नलिज़्म में डेटा जर्नलिज़्म की एसोसिएट प्रोफ़ेसर भी हैं। पहले वह द मार्कअप, बज़फीड न्यूज़, द वॉल स्ट्रीट जर्नल, अल जज़ीरा अमेरिका और एनपीआर के प्लैनेट मनी में पत्रकार रह चुकी हैं।

अनुवाद: डॉ. विष्णु राजगढ़िया