Ilustração: Nodjadong Boonprasert

Guia do repórter para detectar conteúdo gerado por inteligência artificial (IA)

Estamos nos aproximando de um ponto em que a relação sinal-ruído está quase igual a um — o que significa que, à medida que o ritmo da desinformação se aproxima do da informação factual, torna-se praticamente impossível distinguir o que é real. Este guia ensina jornalistas a identificar conteúdo gerado por inteligência artificial (IA) sob pressão de deadlines, oferecendo sete categorias avançadas de detecção que todo repórter precisa dominar.

Como alguém que ajuda redações a combater a desinformação, eis o que me tira o sono: a verificação de fatos tradicional leva horas ou dias. A geração de desinformação por IA leva minutos.

A desinformação em vídeo é tão antiga que antecede a tecnologia moderna de IA em décadas. Mesmo com as limitações técnicas básicas dos equipamentos de gravação da época, ela podia criar impressões falsas devastadoras. Em 2003, a babá Claudia Muro passou 29 meses na prisão porque uma câmera de segurança com baixa taxa de quadros fez com que movimentos suaves parecessem violentos — e ninguém se preocupou em verificar as imagens. Em janeiro de 2025, a professora britânica Cheryl Bennett foi obrigada a se esconder depois que um vídeo deepfake a mostrou falsamente fazendo comentários racistas.

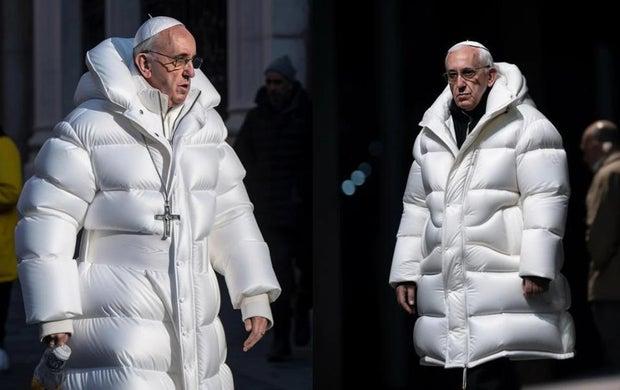

Imagem gerada por IA que supostamente mostra o Papa Francisco I vestindo uma jaqueta puffer da Balenciaga. Imagem: Midjournery, Pablo Xavier

Esta imagem viral do Papa Francisco I com um casaco puffer branco da Balenciaga enganou milhões de pessoas nas redes sociais antes de ser revelada como gerada por inteligência artificial usando o recurso de texto para imagem da Midjourney. As principais pistas para a detecção incluíam o crucifixo pendurado em seu peito, inexplicavelmente erguido, com apenas o casaco puffer branco onde deveria estar a outra metade da corrente. O criador da imagem, Pablo Xavier, disse ao BuzzFeed News: “Achei engraçado ver o Papa com um casaco engraçado”.

Às vezes, as falsificações mais eficazes não exigem nenhuma IA. Em maio de 2019, um vídeo da presidente da Câmara dos Representantes dos EUA, Nancy Pelosi, foi desacelerado para 75% da velocidade e teve o tom alterado para fazê-la parecer embriagada. Em novembro de 2018, a Casa Branca compartilhou uma versão acelerada da interação do correspondente da CNN, Jim Acosta, com uma estagiária da Casa Branca, fazendo com que o movimento de seu braço parecesse mais agressivo do que na realidade.

Recentemente, criei um escândalo político falso completo — com âncoras de notícias, cidadãos indignados, imagens de protestos e um próprio prefeito fictício — em apenas 28 minutos durante meu horário de almoço. Custo total? Oito dólares. Vinte e oito minutos. Uma crise política completamente fabricada que poderia enganar editores muito ocupados e sob pressão de prazos.

Não faz muito tempo, vi um verificador de fatos experiente declarar com confiança que uma imagem gerada por IA era “autêntica” porque mostrava uma mão perfeita de cinco dedos em vez de seis. Mas agora, essa solução praticamente desapareceu.

Esta é a dura realidade da detecção de IA: os métodos que nos davam segurança estão se evaporando diante dos nossos olhos. No início do desenvolvimento de geradores de imagens por IA, mãos mal desenhadas — como dedos extras ou agrupados — eram comuns e frequentemente usadas para identificar imagens geradas por IA. Falsificações virais, como as imagens da “prisão de Trump” de 2023, foram parcialmente expostas por esses erros óbvios nas mãos. No entanto, em 2025, os principais modelos de IA, como Midjourney e DALL-E, melhoraram significativamente na renderização de mãos anatomicamente corretas. Como resultado, as mãos não são mais uma forma confiável de detectar imagens criadas por IA, e aqueles que buscam identificar arte gerada por IA devem procurar outros sinais, mais sutis, para detectar conteúdo gerado por IA.

A revolução na renderização de texto aconteceu ainda mais rápido. Onde cartazes de protesto feitos com IA antes exibiam mensagens ininteligíveis como “PARREM COM A LOUCURAA” e “LIBERTEEM A PALESTIMA”, alguns dos modelos atuais produzem tipografia impecável. A OpenAI treinou especificamente o DALL-E 3 para precisão de texto, enquanto o Midjourney V6 adicionou “texto preciso” como um recurso comercializável. O que antes era um método de detecção confiável agora raramente funciona.

As orelhas desalinhadas, os olhos artificialmente assimétricos e os dentes pintados que antes caracterizavam os rostos criados por IA estão se tornando raros. Imagens de retratos geradas em janeiro de 2023 apresentavam falhas detectáveis o tempo todo. Os mesmos comandos atuais produzem rostos convincentes.

Isso representa um perigo fundamental para as redações. Um jornalista treinado em métodos de detecção de 2023 pode desenvolver uma falsa confiança, declarando conteúdo obviamente gerado por IA como autêntico simplesmente porque passa em testes desatualizados. Essa certeza equivocada é mais perigosa do que a incerteza honesta.

Introduzindo: Image Whisperer

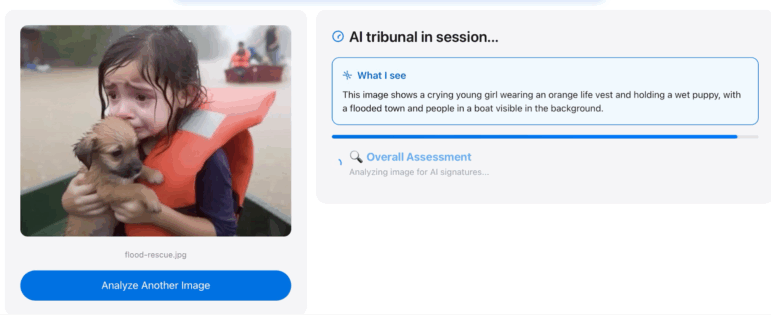

Análise de uma imagem gerada por IA que supostamente mostra uma menina sendo resgatada após uma enchente nos EUA. Imagem: Henk van Ess

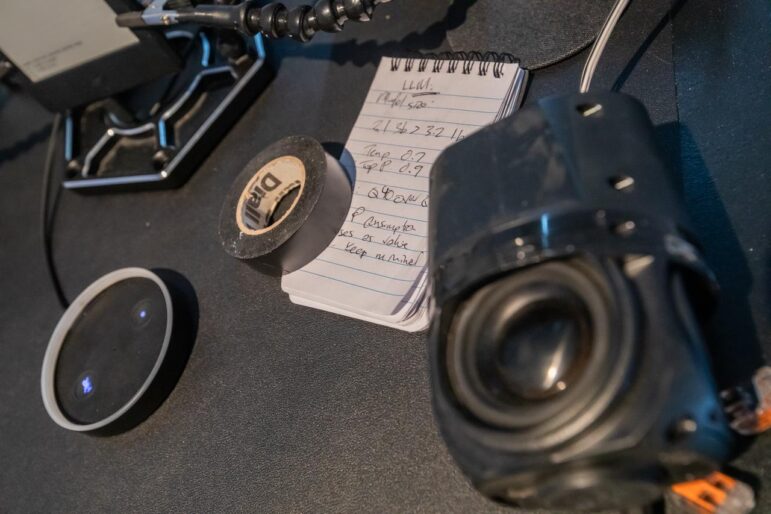

Comecei a me perguntar se seria possível criar um assistente de verificação para conteúdo de IA como um bônus para este artigo. Comecei a enviar e-mails para especialistas. Cientistas me levaram a um território da física que eu jamais imaginaria: transformadas de Fourier, mecânica quântica de redes neurais, assinaturas matemáticas invisíveis ao olho humano. Um físico explicou como os artefatos de IA não são apenas falhas visuais — são impressões digitais no domínio da frequência.

Mas então veio o choque de realidade: “Não construa uma ferramenta você mesmo”, alertou um especialista. “Você precisará de enorme poder computacional e equipes com doutorado. Sem essa infraestrutura, você fracassará miseravelmente”.

Foi aí que me ocorreu. Por que não combater a IA com IA, mas de uma forma diferente? Em vez de recriar sistemas de detecção bilionários, eu aproveitaria a infraestrutura de IA existente para fazer o trabalho pesado.

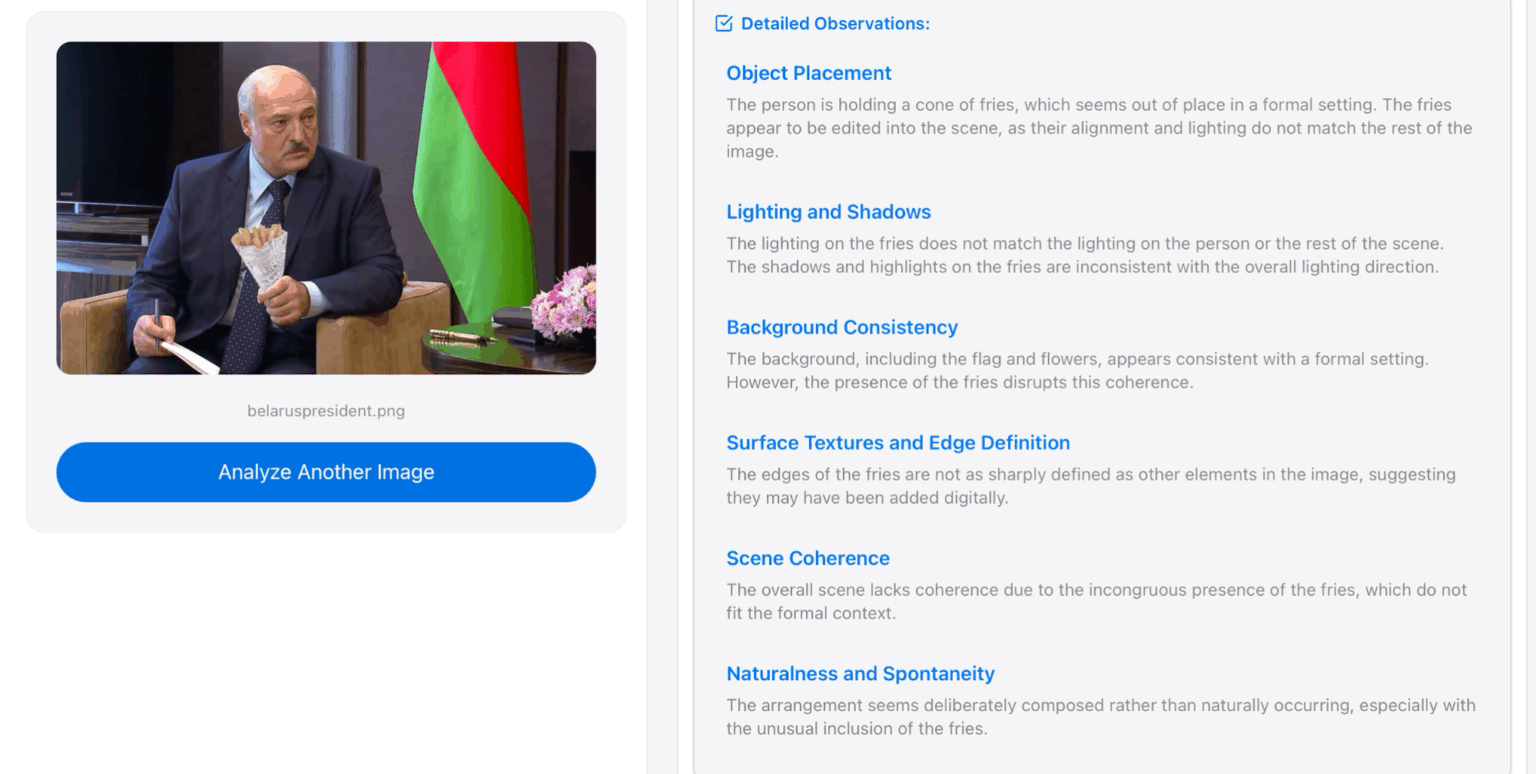

Análise de uma imagem gerada por IA que supostamente mostra o presidente bielorrusso segurando um cone de batatas fritas. Imagem: Henk van Ess

O Image Whisperer (inicialmente chamado Detectai.live) nasceu desse insight. A ferramenta executa análises paralelas de grandes modelos de linguagem juntamente com o processamento do Google Vision, aplicando os princípios da física que esses especialistas me ensinaram e aproveitando o poder computacional já disponível. Mais importante ainda, ao contrário da maioria das ferramentas de IA, ela avisa quando não sabe algo, em vez de adivinhar.

Não está tentando ser o melhor sistema que existe — trata-se de ser o mais honesto.

Sete categorias de detecção de IA

A corrida armamentista entre criadores e detectores de IA continua, com os criadores atualmente se beneficiando da vantagem da velocidade. Identificar o que é ou não um deepfake está se tornando um jogo de gato e rato, com os desenvolvedores aprimorando a tecnologia. Identificar deepfakes com sucesso exige a combinação de múltiplos métodos de detecção, vigilância constante e a aceitação de que a detecção perfeita pode ser impossível. Para jornalistas em busca de respostas precisas, o objetivo mudou da identificação definitiva para uma avaliação de probabilidade e um julgamento editorial fundamentado.

Mas o jornalismo sempre se adaptou às mudanças tecnológicas. Aprendemos a verificar fontes quando qualquer pessoa tinha as ferramentas para criar um site. Desenvolvemos protocolos de verificação em mídias sociais quando todos se tornaram potenciais repórteres. Agora, precisamos desenvolver padrões para uma era em que qualquer pessoa pode criar evidências audiovisuais convincentes.

Categoria 1: Falhas Anatômicas e de Objetos: Quando a Perfeição se Torna o Fator Denunciante

View this post on Instagram

Verificação rápida de 30 Segundos (Notícias de última hora): Quando o tempo é crucial e você precisa de uma avaliação instantânea de algo suspeito, concentre-se na intuição de que algo parece “bom demais para ser verdade“. Procure por uma estética de revista em contextos onde esse nível de cuidado pessoal seria impossível ou inadequado. Um líder de protesto com maquiagem impecável, uma vítima de desastre com o cabelo perfeito ou um momento político espontâneo onde todos parecem ter sido produzidos profissionalmente devem levantar suspeitas imediatas.

- Intuição sobre perfeição — Essa pessoa parece impecável/perfeita demais para a situação?

- Análise de inadequação ao contexto — Beleza de revista em uma cena de crise/conflito?

- Verificação da aparência — Pele excessivamente lisa onde deveria haver textura natural?

- Avaliação geral da apresentação pessoal — A aparência condiz com o cenário?

Verificação técnica de cinco minutos (Histórias padrão): Esta análise mais aprofundada concentra-se nos detalhes técnicos que denunciam a geração artificial. A IA moderna cria imagens anatomicamente corretas, mas elas frequentemente exibem uma perfeição estranha, não encontrada na fotografia real. Rostos reais têm assimetrias sutis, marcas de desgaste naturais e efeitos do ambiente que a IA tem dificuldade em replicar de forma autêntica.

- Amplie a imagem para 100% nos rostos — Observe a textura natural da pele, os poros e pequenas assimetrias.

- Avaliação da física das roupas — Dobras naturais, texturas do tecido e padrões de desgaste presentes?

- Análise dos fios de cabelo — Fios individuais visíveis versus aparência pintada/renderizada?

- Realismo de joias/acessórios — Aparência tridimensional versus planura de computação gráfica.

- Exame dos dentes — Existem imperfeições naturais versus perfeição uniforme?

- Avaliação geral de perfeição — O nível de cuidado pessoal corresponde ao contexto e cenário mencionados?

Investigação profunda (Reportagens de alto risco): Para matérias em que a precisão é fundamental, esta análise abrangente trata a imagem como prova que exige escrutínio forense. O objetivo é construir uma avaliação de probabilidade com base em múltiplos pontos de verificação, compreendendo que, embora a prova definitiva possa ser impossível, um julgamento fundamentado é possível.

- Análise comparativa — Encontre outras fotos da mesma pessoa para comparar os níveis de perfeição natural versus artificial.

- Ampliação técnica — Use ferramentas profissionais para examinar a textura da pele em nível de pixel em busca de padrões matemáticos.

- Verificação de contexto — Pesquise e compare com outras imagens para determinar se a pessoa normalmente apresenta essa aparência impecável em situações semelhantes.

- Consultoria profissional — Contate especialistas em perícia digital, como Farid Hany, para análises avançadas.

- Verificação de múltiplos ângulos — Busque fotos/vídeos adicionais do mesmo evento para verificar a consistência.

- Comparação histórica — Compare com fotos verificadas da pessoa de um período e contexto semelhantes.

Categoria 2: Violações da Física Geométrica — Quando a IA Ignora as Leis Naturais

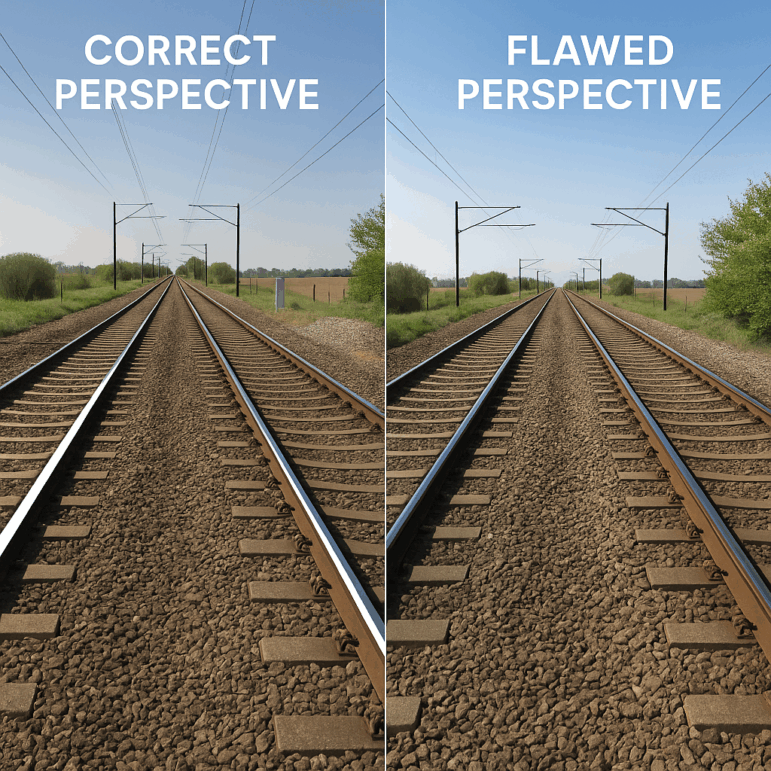

Imagem gerada por IA de trilhos de trem se afastando na distância, ao lado de uma imagem com perspectiva correta da vida real. Imagens: Henk van Ess

A narrativa: a IA monta imagens como um artista de colagens, não como um fotógrafo. Ela entende elementos visuais, mas não as regras geométricas e físicas que governam como a luz, a perspectiva e as sombras funcionam no mundo real. Essas falhas fundamentais da física são mais difíceis de serem corrigidas pela IA porque exigem uma compreensão do espaço tridimensional e do comportamento da luz.

Problemas de física do mundo real em imagens geradas por IA: Embora ainda estejamos no início da era da IA generativa, as imagens geradas por IA atualmente corrigem sombras e reflexos em perspectiva. Um exemplo típico gerado usando o DALL-E 2 da OpenAI mostra sombras inconsistentes, reflexos impossivelmente desalinhados ou ausentes e sombras no reflexo orientadas exatamente na direção errada.

Análise do Ponto de Fuga: Edifícios reais seguem as leis da perspectiva — linhas paralelas convergem para um único ponto no horizonte. A IA frequentemente cria edifícios onde as linhas do telhado apontam para a esquerda enquanto as linhas das janelas apontam para a direita, uma impossibilidade física que revela uma montagem algorítmica em vez de uma captura fotográfica. Os pontos de fuga são fundamentais para capturar a essência da perspectiva em imagens reais, e as imagens geradas frequentemente exibem inconsistências onde as linhas não se encontram no ponto de fuga correto.

Verificação da Consistência das Sombras: Onde há luz, há sombras. A relação entre um objeto, sua sombra e a(s) fonte(s) de luz que o iluminam é geometricamente simples, mas enganosamente difícil de reproduzir com precisão em uma imagem manipulada ou sintetizada. Em cenas com uma única fonte de luz (como a luz solar), todas as sombras devem apontar para longe dessa fonte. A IA frequentemente mostra pessoas projetando sombras em várias direções, apesar de haver apenas um sol, violando as leis básicas da física.

Validação por meio de pesquisa: Pesquisas acadêmicas confirmaram essas falhas geométricas. Estudos que utilizaram a análise GradCam em imagens externas revelam direções de sombras variadas projetadas por veículos e distorções estruturais próximas aos pontos de fuga, enquanto cenas internas mostram discrepâncias entre objetos e sombras, além de linhas desalinhadas na geometria do ambiente.

Esse tipo de detecção sutil não é para os fracos. Acostume-se com a ideia de primeiro observar as linhas.

Verificação rápida de 30 segundos para alerta de risco:

- Encontre qualquer foto de trilhos de trem retos (pesquise no Google “perspectiva de trilhos de trem”).

- Abra o MS Paint ou qualquer editor de imagens básico.

- Use a ferramenta de linha para traçar os dois trilhos, estendendo-os em direção ao horizonte.

- Verifique se eles convergem para um único ponto – é isso que DEVERIA acontecer.

Agora você tem o modelo visual de como deve ser uma perspectiva correta.

Verificação técnica de cinco minutos (Histórias padrão):

Teste de Perspectiva:

- Escolha UM edifício na imagem.

- Use qualquer editor de imagens para desenhar linhas de telhado e fileiras de janelas estendidas.

- Verifique se as linhas do mesmo edifício convergem em um único ponto.

- Múltiplos pontos de fuga para uma mesma estrutura = erro de montagem da IA.

Análise de sombra:

- Identifique a principal fonte de luz (os pontos de luz mais brilhantes).

- Desenhe linhas da fonte de luz até as extremidades das sombras, passando pelo topo dos objetos.

- Verifique se todas as sombras apontam na mesma direção.

- Sombras com direções conflitantes = violam as leis da física.

Investigação profunda (Reportagens de alto risco):

Verificação do Reflexo: Quando objetos são refletidos em uma superfície plana, as linhas que conectam um ponto no objeto ao ponto correspondente na reflexão devem convergir para um único ponto de fuga.

- Encontre superfícies refletoras na imagem (água, vidro, espelhos)

- Desenhe linhas conectando os objetos aos seus reflexos

- Verifique se as linhas encontram a superfície refletora em ângulos retos

- Posições de reflexão impossíveis = falha geométrica

Categoria 3: Impressões digitais técnicas e análise de pixels — O DNA matemático

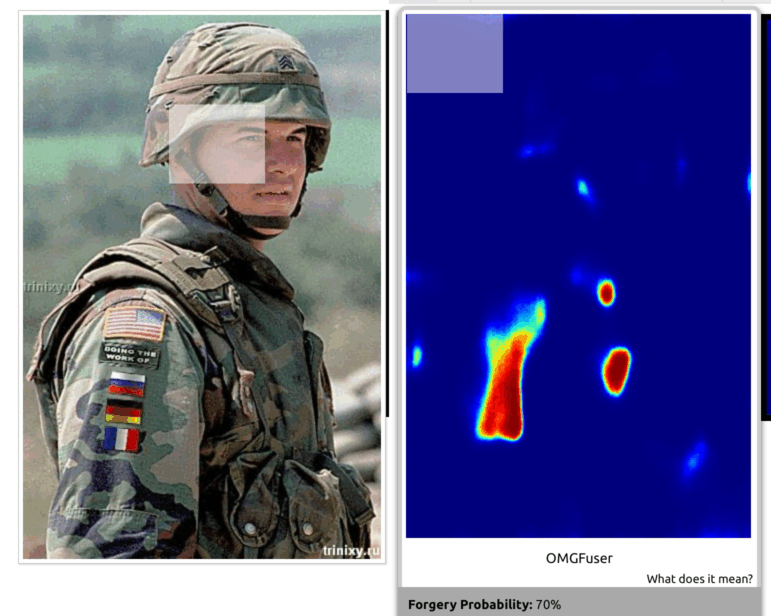

Uma foto viral, alterada digitalmente, de um soldado americano de 2004. O emblema “DOING THE WORK OF” (fazendo o trabalho de), além das bandeiras russa, alemã e francesa, foram adicionados à imagem. A ferramenta mostra a possível área alterada e a probabilidade de ter sido alterada. Imagens: Henk van Ess

A narrativa: Quando a IA cria uma imagem, ela deixa pistas ocultas no arquivo — uma assinatura matemática que funciona como impressões digitais invisíveis, detectáveis por ferramentas especiais. Essas pistas estão na forma como os pixels são organizados e como o arquivo é comprimido. Pense nisso como uma evidência de DNA que comprova que algo foi criado por IA e não capturado por uma câmera real.

Detecção de padrões de ruído: Câmeras reais capturam imagens com imperfeições naturais e irregulares — como minúsculos pontos aleatórios provenientes do sensor da câmera. Imagens geradas por IA, por outro lado, apresentam padrões artificialmente perfeitos. Quando especialistas analisam esses padrões com softwares específicos, eles identificam formas distintas, semelhantes a estrelas, que jamais apareceriam em uma foto real. É como a diferença entre a estática verdadeira de uma TV antiga e uma simulação feita por computador — a versão falsa possui uma ordem oculta que a denuncia, caso se tenha as ferramentas adequadas.

Detecção de copiar e colar: Quando a IA ou humanos duplicam regiões de uma imagem, isso cria correlações incomuns entre pixels. Diferentes áreas tornam-se suspeitosamente semelhantes, além da redundância espacial natural, criando padrões detectáveis ou assinaturas matemáticas.

Análise da compressão de artefatos: O conteúdo gerado por IA frequentemente apresenta padrões de compressão não naturais que diferem dos arquivos brutos originados pela câmera, revelando origens algorítmicas em vez de ópticas.

Ferramentas de detecção profissionais: A tecnologia da TrueMedia.org tem a capacidade de analisar mídias suspeitas e identificar deepfakes em áudio, imagens e vídeos. Exemplos de deepfakes recentes sinalizados pela TrueMedia.org incluem uma suposta foto da prisão de Donald Trump e uma suposta foto do presidente Biden com funcionários militares de alto escalão.

Verificação rápida de 30 segundos para alerta de risco:

Antes de analisar imagens suspeitas, pratique em algo infalível:

- Faça o upload da sua foto para o Image Verification Assistant (Assistente de Verificação de Imagem).

- A tecnologia fornecerá uma taxa de probabilidade de falsificação.

- Investigue a imagem mais a fundo se a probabilidade de falsificação for de 70% ou superior.

Verificação técnica de cinco minutos (Histórias padrão):

- Verificação visual da textura: Aumente o zoom para 100% em áreas como a pele ou o céu. Observe atentamente a textura — ela apresenta a qualidade aleatória e irregular da vida real, ou parece muito lisa e matematicamente perfeita? Fotos reais têm um caos natural; a IA geralmente cria padrões suspeitosamente uniformes.

- Ferramenta de detecção automatizada: Faça o upload da imagem para TrueMedia.org (um site gratuito). Essa ferramenta utiliza um software de detecção por IA que analisa as assinaturas matemáticas ocultas que mencionamos anteriormente. Ela fornece uma porcentagem de probabilidade de a imagem ter sido gerada por IA.

- Verifique as informações ocultas do arquivo: Clique com o botão direito do mouse no arquivo de imagem e selecione “Propriedades” (no PC) ou “Obter Informações” (no Mac). Observe os metadados — eles mostram qual software criou o arquivo e quando. Imagens geradas por IA frequentemente exibem registros de data e hora de softwares de edição ou ferramentas de criação que não correspondem à história presumida de quando/como a foto foi tirada.

- Análise de suavidade da superfície: Esta etapa é diferente da verificação de textura. Aqui, você analisa superfícies que naturalmente deveriam ser imperfeitas — como paredes, tecidos ou água. A IA tende a “suavizar” essas superfícies, tornando-as artificialmente lisas onde uma foto real mostraria pequenas saliências, variações ou desgaste.

Cada etapa detecta diferentes tipos de erros de IA — pense nisso como usar vários testes diferentes para ter certeza da sua conclusão.

Investigação aprofundada (reportagens de alto risco):

Análise Forense — Este é um conjunto de ferramentas gratuitas e abrangentes para análise de ruído com visualização no domínio da frequência.

Análise no domínio da frequência — Detecção técnica de padrões matemáticos exclusivos da IA.

Categoria 4: Artefatos de Voz e Áudio — Quando o discurso sintético se trai

A narrativa: A tecnologia de clonagem de voz pode replicar a voz de qualquer pessoa a partir de segundos de áudio, mas deixa vestígios detectáveis de geração artificial nos padrões de fala, na autenticidade emocional e nas características acústicas. Embora alcance uma precisão impressionante, as vozes sintéticas ainda têm dificuldade em replicar os elementos humanos sutis que tornam a fala verdadeiramente autêntica.

Casos reais de enganação por áudio: Em março de 2019, o CEO de uma empresa de energia do Reino Unido recebeu uma ligação de seu “chefe” com um sotaque alemão perfeito, solicitando uma grande transferência de dinheiro. Somente uma segunda ligação suspeita, de um número austríaco, revelou o enganação por meio de inteligência artificial. Mais recentemente, o consultor político Steven Kramer pagou US$ 150 para criar uma gravação de áudio automatizada (robocall) em deepfake, imitando o então presidente dos EUA, Joe Biden, que incentivava as pessoas a não votarem nas primárias democratas de New Hampshire em 2024.

Velocidade e custo das falsificações de áudio: De acordo com o processo contra Kramer, a falsificação de áudio levou menos de 20 minutos para ser criada e custou apenas US$ 1. Kramer disse à CBS News que obteve “exposição no valor de US$ 5 milhões” por seus esforços.

Sinais de alerta no padrão de fala: Lindsay Gorman, que estuda tecnologias emergentes e desinformação, disse à NBC News que geralmente existem indícios em deepfakes: “A cadência, principalmente no final, pareceu artificial, robótica. Esse é um dos sinais que indicam uma possível falsificação de conteúdo de áudio”.

- Ritmo anormal, sem hesitações ou respiração normais.

- Pronúncia impecável, sem as imperfeições da fala natural.

- Entonação robótica em certas palavras ou frases.

- Ausência de ruído ambiente de fundo.

- Frases ou terminologia que a pessoa jamais usaria na vida real.

Falhas na lógica linguística: Um caso anterior de deepfake revelou uma IA dizendo “libras 35.000” — colocando o tipo de moeda antes dos números de uma forma não natural que expôs a geração sintética.

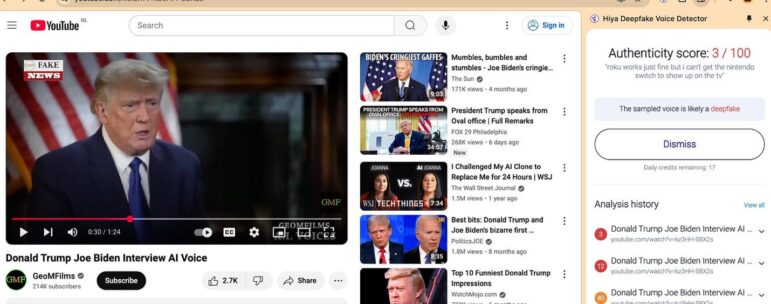

Verificação rápida de 30 segundos para alerta de risco:

Dê uma olhada no Hiya Deepfake Voice Detector, um plugin simples para o Chrome (você pode usá-lo 20 vezes por mês). Ele passou no teste do vídeo Trump-Biden:

É uma extensão do Chrome que analisa o áudio em tempo real para determinar se o que você está ouvindo é uma voz humana real ou algo criado por IA.

Eis o que ele realmente faz:

- Analisa vozes em vídeos e áudios reproduzidos no seu navegador Chrome.

- Funciona instantaneamente, exigindo apenas um segundo de áudio para fazer uma análise.

- Funciona em qualquer site – plataformas de mídia social, sites de notícias, plataformas de vídeo.

- Detecta fala semelhante à humana criada por todas as principais ferramentas de síntese de voz por IA.

- Suporta vários idiomas.

- Funciona em tempo real enquanto você navega.

Atenção: Como o plugin utiliza algoritmos probabilísticos, ele não será 100% preciso em todos os casos.

Verificação técnica de cinco minutos (Histórias padrão):

- Preste atenção à naturalidade da fala — O ritmo e a pronúncia soam humanos?

- Verifique a disponibilidade — Essa pessoa realmente poderia ter feito essa declaração quando está sendo alegado?

- Verifique a autenticidade emocional — A emoção corresponde ao conteúdo e ao contexto?

- Ligue de volta para o número oficial para confirmar quaisquer solicitações de áudio urgentes.

- Faça perguntas contextuais que somente a pessoa em questão saberia responder.

Investigação aprofundada (Reportagens de alto risco):

- Baixe o fragmento de áudio completo.

- Envie-o para o Notta.ai e deixe-o gerar uma transcrição.

- Enquanto espera, envie para o Claude de cinco a seis fragmentos de áudio verificados da mesma pessoa ou transcrições.

- Peça para ele fazer uma análise semântica e categorizar os temas, os padrões de fala, o uso da gramática, o estilo e o tom de voz.

- Em seguida, envie a transcrição do áudio que você não confia e peça para o Claude compará-la em busca de anomalias.

Categoria 5: Lógica temporal e contextual — Quando a IA não consegue enxergar o panorama geral

Imagem gerada por IA que supostamente mostra uma cena de um noticiário sobre um protesto climático em Paris. Imagem: Henk van Ess

A narrativa: A IA gera conteúdo com base em padrões visuais sem compreender o contexto do mundo real, a lógica temporal ou a adequação situacional. Isso cria conteúdo que parece convincente isoladamente, mas que se desfaz sob uma análise criteriosa.

A farsa do vídeo da prisão iraniana: Um sofisticado vídeo gerado por inteligência artificial alegava mostrar um ataque de míssil israelense à prisão de Evin, no Irã, mas foi criado a partir de uma fotografia de 2023. Entre as principais pistas para a detecção estão inconsistências sazonais (arbustos sem folhas em supostas imagens de verão), correspondência perfeita de detalhes que iam contra a probabilidade e um timing impossível.

Verificação rápida de 30 Segundos: A IA cria conteúdo visualmente convincente, mas frequentemente ignora relações lógicas fundamentais entre tempo, lugar e circunstância. Em situações de notícias de última hora, confie no seu conhecimento do mundo para identificar impossibilidades que exigiriam análises sofisticadas para serem verificadas posteriormente.

- Verificação de consistência sazonal/climática — A vegetação, as roupas ou a iluminação correspondem à data e ao local alegados?

- Análise da linha do tempo tecnológica — Há algum dispositivo, veículo ou infraestrutura que não pertença a esse período?

- Verificação geográfica — A arquitetura, a sinalização e a paisagem correspondem ao local declarado?

- Avaliação rápida da credibilidade da fonte — A origem do conteúdo está alinhada com sua sofisticação e requisitos de acesso?

Verificação técnica de cinco minutos (Histórias padrão): Esta análise mais aprofundada utiliza suas habilidades de pesquisa para comparar afirmações com fatos verificáveis. A IA tem dificuldades com a natureza interconectada dos eventos do mundo real, criando conteúdo que passa pela inspeção visual, mas falha no escrutínio lógico quando comparado a fontes de dados externas.

- Verificação histórica do clima — Compare as condições visíveis com os dados meteorológicos arquivados para a data e local declarados.

- Referência cruzada de marcos arquitetônicos — Verifique se os edifícios, placas e infraestrutura visíveis existem no local declarado.

- Auditoria de elementos culturais — Confirme se os estilos de vestimenta, comportamentos e dinâmicas sociais correspondem ao contexto geográfico/cultural.

- Avaliação da probabilidade da linha do tempo — Pesquise se os eventos declarados poderiam ocorrer simultaneamente de forma lógica.

- Análise de padrões de fontes — Mapeie como o conteúdo se espalha em comparação com os padrões de distribuição típicos para eventos semelhantes.

- Busca por múltiplos ângulos — Procure outras documentações do mesmo evento em fontes independentes.

Investigação profunda (Reportagens de alto risco): Para matérias críticas, trate as pistas contextuais como peças de um quebra-cabeça forense, cada uma exigindo verificação sistemática em relação a fatos estabelecidos. Essa abordagem abrangente constrói uma matriz de probabilidades baseada em múltiplas inconsistências lógicas, em vez de provas definitivas isoladas.

- Reconstrução abrangente da linha do tempo — Elabore uma cronologia detalhada dos eventos declarados e compare todos os elementos visuais.

- Verificação de inteligência geográfica — Utilize imagens de satélite, Street View e conhecimento local para confirmar os detalhes da localização.

- Análise forense sazonal/ambiental — Consulte especialistas em botânica, meteorologistas e fontes locais sobre as condições ambientais.

- Avaliação da autenticidade cultural — Entreviste especialistas regionais sobre normas de comportamento, códigos de vestimenta e costumes sociais visíveis no conteúdo.

- Análise de anacronismo tecnológico — Verifique se todos os dispositivos, veículos e infraestrutura visíveis existiam no local e horário alegados.

- Investigação da cadeia de fontes — Rastreie todo o histórico de distribuição e compare com padrões conhecidos de eventos autênticos semelhantes.

- Rede de consulta a especialistas — Envolva jornalistas, acadêmicos e autoridades locais familiarizados com o local ou situação alegada.

- Construção da matriz de probabilidade — Avalie cada elemento lógico e construa uma avaliação abrangente da autenticidade do conteúdo.

Categoria 6: Reconhecimento de padrões comportamentais — Quando a IA interpreta mal os humanos

Imagem gerada por IA que supostamente mostra manifestantes marchando em uma rua da cidade. Imagem: Henk van Ess

A narrativa: A IA consegue replicar a aparência humana, mas tem dificuldades com o comportamento humano autêntico, dinâmicas sociais e os padrões de interação natural. Isso cria inconsistências detectáveis em cenas com multidões, dinâmicas de grupo e comportamentos individuais, que observadores treinados conseguem identificar.

Verificação rápida de 30 segundos (Notícias de última hora): A IA cria multidões que parecem realistas à primeira vista, mas revelam sua falta de autenticidade por meio de padrões de comportamento artificiais. Em situações de notícias de última hora, concentre-se em verificar se as pessoas estão agindo como seres humanos reais agiriam nessas circunstâncias, e não como atores digitais seguindo comportamentos programados.

- Análise da uniformidade da multidão — Há muitas pessoas com idade, aparência ou estilo de vestimenta semelhantes?

- Verificação do padrão de atenção — Todos estão olhando na mesma direção ou para a câmera, ou há variações naturais na atenção?

- Análise da autenticidade emocional — As expressões faciais correspondem ao clima e à intensidade esperados para o evento?

- Avaliação do realismo dos movimentos — O espaçamento e a linguagem corporal são naturais, em vez de posicionamentos artificiais?

Verificação técnica de cinco minutos (Histórias padrão): Esta análise utiliza seu conhecimento da dinâmica social humana para identificar as limitações da IA na replicação do comportamento autêntico de grupos. Multidões reais exibem padrões sociais complexos que os dados de treinamento da IA não conseguem capturar completamente, criando uma uniformidade artificial detectável em encontros supostamente espontâneos.

- Auditoria de diversidade demográfica — Contabilize faixas etárias, estilos de vestimenta e representação étnica, em contraste com a uniformidade artificial.

- Mapeamento da interação social — Identifique conversas genuínas, relacionamentos e dinâmicas de grupo, em contraste com posicionamentos encenados.

- Verificação da resposta ambiental — Como as pessoas reagem adequadamente ao clima, à iluminação e aos níveis de ruído?

- Verificação cruzada do comportamento cultural — As normas sociais, o espaço pessoal e os estilos de interação correspondem ao ambiente declarado?

- Análise da expressão individual — Observe expressões faciais únicas e emoções genuínas, em contraste com respostas uniformes ou genéricas.

- Avaliação do padrão de movimento — Existem assimetrias naturais e peculiaridades pessoais, em contraste com movimentos artificialmente suaves?

Investigação aprofundada (reportagens de alto risco): Para reportagens críticas, trate o comportamento humano como evidência antropológica que exige uma análise sistemática dos padrões sociais. Essa abordagem abrangente examina se a complexa rede de interações humanas poderia de fato ocorrer nas circunstâncias alegadas.

- Análise sociológica de multidões — Consulte especialistas em psicologia de multidões para verificar a dinâmica realista de grupos para o tipo de evento em questão.

- Verificação de autenticidade cultural — Entreviste especialistas regionais sobre comportamentos sociais apropriados, códigos de vestimenta e padrões de interação.

- Avaliação de probabilidade demográfica — Pesquise se a composição da multidão corresponde aos padrões típicos de público em eventos semelhantes.

- Análise forense do comportamento individual — Analise indivíduos específicos em busca de personalidades e relacionamentos consistentes e respostas emocionais autênticas.

- Estudo de adaptação ambiental — Verifique se as respostas da multidão ao clima, à acústica e à logística correspondem a padrões do mundo real.

- Pesquisa comparativa histórica — Compare com filmagens ou fotos verificadas de eventos autênticos semelhantes na mesma região ou contexto cultural.

- Rede de consultores especializados — Contrate antropólogos, sociólogos e jornalistas locais familiarizados com a dinâmica social regional.

- Análise de microexpressões — Consulte especialistas para examinar expressões faciais e identificar respostas emocionais autênticas em vez de respostas geradas artificialmente.

- Mapeamento de redes sociais — Rastreie as relações entre indivíduos para verificar a autenticidade da formação de grupos em comparação com a formação artificial.

Categoria 7: Reconhecimento intuitivo de padrões — O sistema de detecção ancestral

Imagem gerada por IA que supostamente mostra o presidente bielorrusso segurando, de forma incongruente, um cone de batatas fritas em uma reunião oficial. Imagem: Henk van Ess

A narrativa: Nossos cérebros desenvolveram o reconhecimento de padrões ao longo de milhões de anos. Os padrões da IA provêm de dados de treinamento e processos algorítmicos. Quando algo viola as expectativas naturais inerentes à percepção humana, essa intuição costuma ser o detector inicial mais rápido e confiável, antes mesmo da análise técnica.

Histórias de sucesso no mundo real: Em 2019, usuários de redes sociais imediatamente denunciaram uma imagem viral de um “tubarão na rua” durante o furacão Florence. Embora tecnicamente competente, os espectadores sentiram que a imagem parecia inadequada para a situação. Seus instintos se provaram corretos — buscas reversas revelaram uma inserção digital. Da mesma forma, jornalistas experientes conseguem perceber quando uma filmagem amadora parece suspeitosamente cinematográfica ou quando existe uma documentação perfeita para eventos supostamente espontâneos.

Curiosidade: Parece que os supostos encontros ocorreram por mais de uma década em diversos furacões, mas houve um exemplo que foi comprovado.

Verificação rápida de 30 segundos para alerta de risco: Confie no seu padrão evolutivo de reconhecimento quando o tempo é crucial. Procure pelo paradoxo da qualidade de produção, onde fontes amadoras produzem conteúdo com qualidade de Hollywood, ou pela conveniência temporal, onde eventos caóticos são perfeitamente documentados. Seu sistema de detecção ancestral frequentemente identifica essas violações antes que análises técnicas possam confirmá-las.

- Reação à primeira impressão — Isso parece autêntico ou “produzido”? (Confie na sua sensação de desconforto em relação a representações artificiais de seres humanos, também conhecida como sensação do “vale da estranheza”).

- Paradoxo do custo de produção — A fonte amadora está alinhada com a qualidade cinematográfica (com US$ 8 agora é possível produzir escândalos políticos com aparência profissional)?

- Verificação de conveniência temporal — A documentação perfeita dos eventos acontece rápido demais para uma gravação normal?

- Teste de manipulação emocional — O conteúdo foi projetado para provocar uma reação emocional e compartilhamento rápido, em vez de informar o leitor?

Verificação técnica de cinco minutos (Histórias padrão): Transforme suas intuições em verificações sistemáticas, examinando elementos específicos que ativaram sua capacidade de reconhecer padrões. Quando seu instinto lhe diz que algo está errado, identifique o que especificamente viola as expectativas naturais para construir uma argumentação lógica.

- Análise detalhada da lógica contextual — O cenário faz sentido na prática, considerando o conhecimento do mundo real?

- Investigação da credibilidade da fonte — A origem corresponde à sofisticação do conteúdo e aos requisitos de acesso?

- Análise de conveniência narrativa — As histórias se alinham perfeitamente com as tensões políticas ou sociais atuais?

- Auditoria de inconsistências técnicas — A qualidade, a iluminação ou o áudio correspondem às circunstâncias alegadas?

- Catálogo de violações de padrões — Documente elementos específicos que geram suspeitas ou impossibilidade contextual.

- Avaliação de incompatibilidade entre fonte e conteúdo — Sinalize conteúdo sofisticado de fontes amadoras ou anônimas sem explicação.

Investigação aprofundada (reportagens de alto risco): Para matérias críticas, considere a detecção intuitiva como ponto de partida para uma verificação completa. Seu reconhecimento de padrões identificou anomalias; agora, examine sistematicamente cada elemento que despertou suspeitas para construir uma avaliação baseada em evidências.

- Análise forense intuitiva — Catalogue cada elemento que pareça “fora do normal” e pesquise por que cada um viola as expectativas naturais.

- Investigação do paradoxo de produção — Calcule os recursos reais necessários em comparação com as capacidades presumidas de um amador.

- Análise de impossibilidade contextual — Compare cenários com o conhecimento do mundo real e insights de consultas a especialistas.

- Avaliação da manipulação emocional — Analise a estrutura do conteúdo em busca de gatilhos virais planejados versus compartilhamento orgânico de informações.

- Análise detalhada de inconsistências técnicas — Analise as discrepâncias de qualidade, iluminação e áudio quadro a quadro.

- Verificação da autenticidade da fonte — Investigue se as origens alegadas poderiam, de fato, produzir esse conteúdo.

- Detecção de engenharia narrativa — Examine a construção da história em busca de conveniência artificial versus desenvolvimento natural de eventos.

- Consulta com especialista em violação de padrões — Engaje investigadores experientes para avaliações independentes e intuitivas.

- Análise de limiar de confiança — Documente quando múltiplos elementos parecem “fora do padrão” e justifique a rejeição de conteúdo, apesar da competência técnica.

Quando confiar na sua intuição:

- Se vários elementos parecerem “estranhos”, mesmo que você não consiga identificar problemas específicos.

- Quando o conteúdo desencadeia uma resposta emocional imediata, isso significa que ele foi projetado para impedir a análise.

- Se a fonte, o momento ou o contexto levantarem questões lógicas.

- Quando a qualidade técnica não corresponder ao nível de experiência do produtor.

- Se o seu cérebro detectar um paradoxo de qualidade de produção ou uma conveniência de tempo que o seu experimento demonstrou.

A realidade: não existem soluções perfeitas.

Em resumo: Essas sete categorias de detecção por IA e a nova ferramenta — falhas anatômicas, violações das leis da física, impressões digitais técnicas, artefatos de voz, lógica contextual, padrões comportamentais e reconhecimento intuitivo — oferecem aos jornalistas um conjunto abrangente de ferramentas para avaliar a autenticidade de conteúdos sob pressão de deadlines. Combinadas com ferramentas de detecção profissionais e padrões editoriais atualizados, podemos manter a credibilidade. Combater fogo com fogo. Usar IA para detectar IA. E ajudar a preservar o que resta da nossa realidade compartilhada.

O holandês Henk van Ess está desvendando os segredos da inteligência artificial (IA) para encontrar histórias em dados. Ele aplica esse conhecimento em pesquisas investigativas e desenvolve ferramentas de uso público, como o SearchWhisperer e o AI Researcher. Como instrutor em redações do mundo todo, incluindo o Washington Post, Axel Springer, BBC e DPG, ele dirige a Digital Digging, plataforma onde a inteligência de código aberto encontra a IA. Ele também atua como avaliador da Rede Internacional de Checagem de Fatos (IFCN) do Poynter e da Rede Europeia de Padrões de Checagem de Fatos (EFCSN).

O holandês Henk van Ess está desvendando os segredos da inteligência artificial (IA) para encontrar histórias em dados. Ele aplica esse conhecimento em pesquisas investigativas e desenvolve ferramentas de uso público, como o SearchWhisperer e o AI Researcher. Como instrutor em redações do mundo todo, incluindo o Washington Post, Axel Springer, BBC e DPG, ele dirige a Digital Digging, plataforma onde a inteligência de código aberto encontra a IA. Ele também atua como avaliador da Rede Internacional de Checagem de Fatos (IFCN) do Poynter e da Rede Europeia de Padrões de Checagem de Fatos (EFCSN).